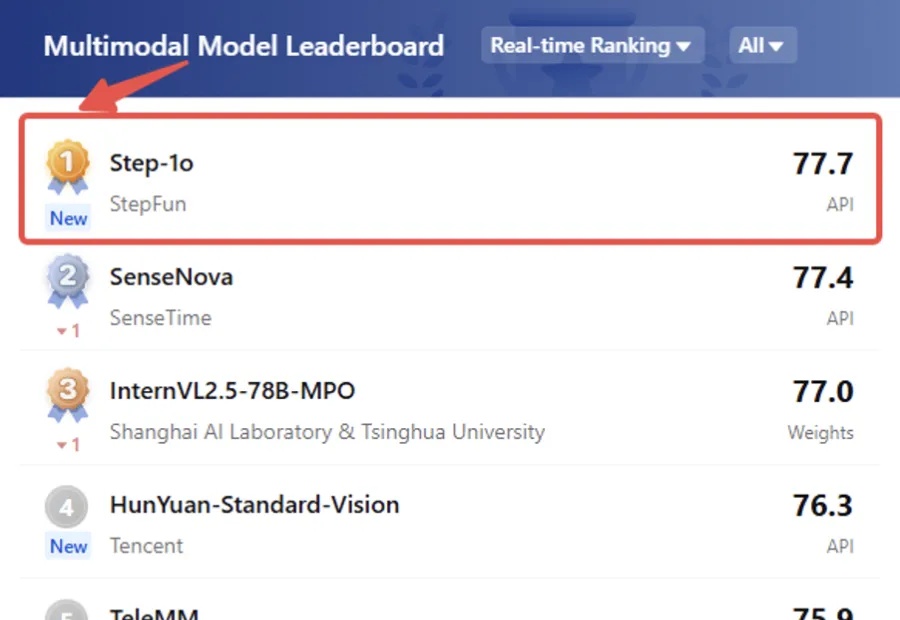

6天连发6模型,阶跃稳稳蝉联多模态卷王

6天连发6模型,阶跃稳稳蝉联多模态卷王我勒个老天奶,大模型六小强之一的阶跃星辰,给大家拜早年的方式可真不一样——

搜索

搜索

我勒个老天奶,大模型六小强之一的阶跃星辰,给大家拜早年的方式可真不一样——

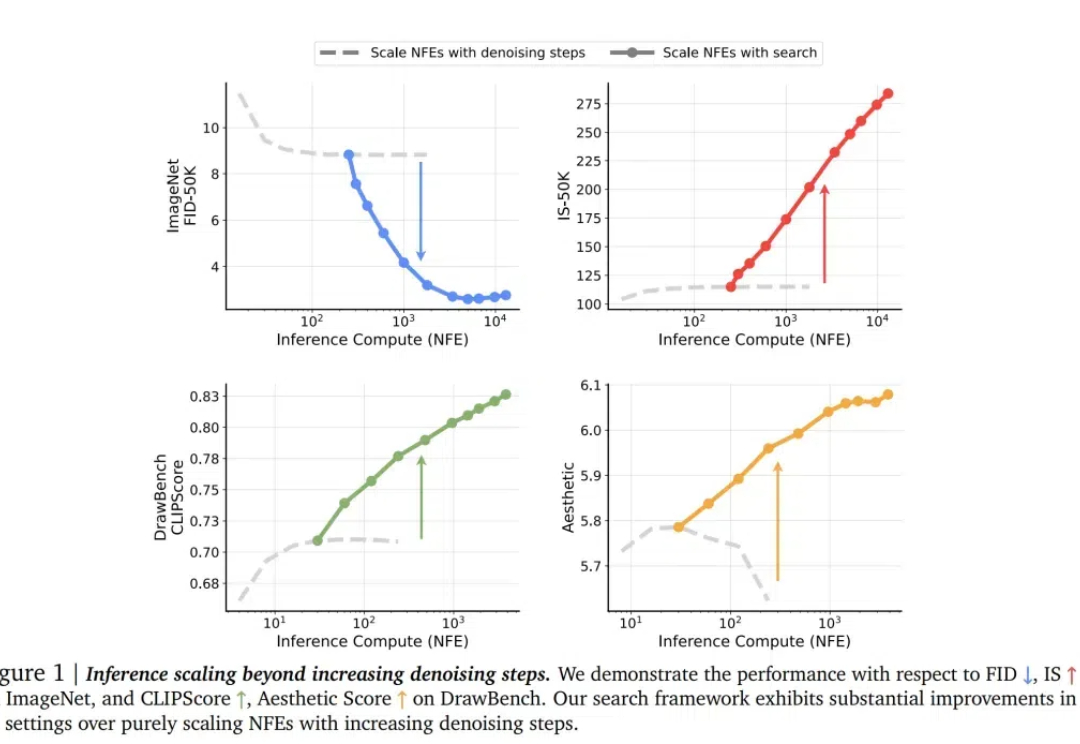

对于 LLM,推理时 scaling 是有效的!这一点已经被近期的许多推理大模型证明:o1、o3、DeepSeek R1、QwQ、Step Reasoner mini……

这是阶跃星辰 Step 系列模型家族的首个推理模型。 类似 OpenAI o1 的推理模型在国内终于卷起来了。

在“最难AI榜”,拿下中国第一、全球第五。

国际权威榜单 LiveBench 官网发布最新的榜单成绩显示,阶跃星辰自研的万亿参数语言大模型 Step-2 在榜单中位列国产基座大模型第一

说起阶跃星辰,可以说是 AI 六小强中最低调的一个,但最近这家公司在 AI 圈里频频“闹出动静”。

备受期待的阶跃星辰图像生成大模型Step-1X,正式上线了!创作古诗词配图意境绝美,古典中国园林的每片叶子都很逼真,巴黎街道堪比单反。而且,这次官方还披露了两个隐藏玩法,让生图效果噌噌up。

饰品行业也存在“规模法则”。

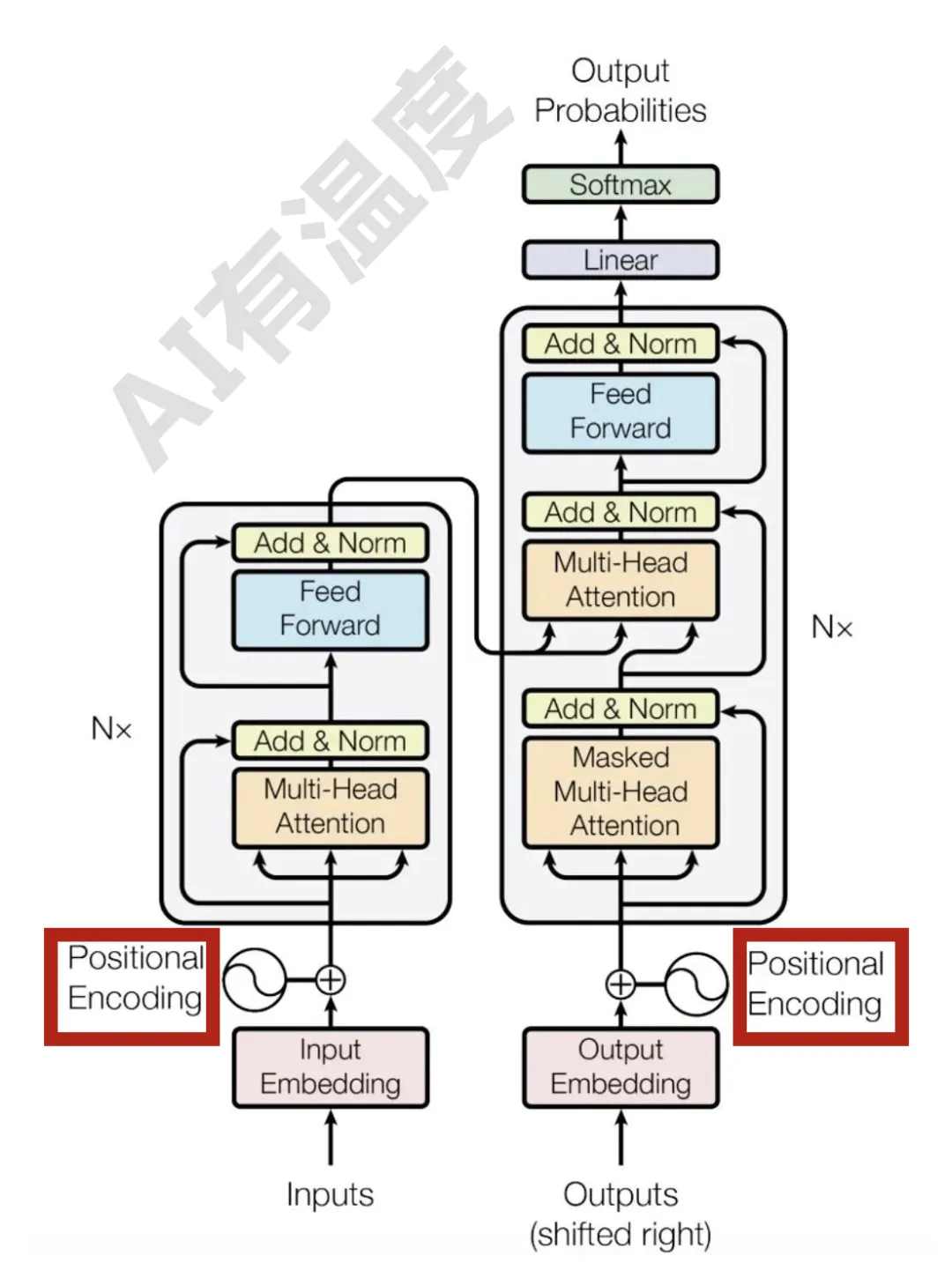

RNN每个step的隐状态都取决于上一个step的输出,这种连续的状态转移方式使得RNN天然带有位置信息。

在今天揭幕的 2024 世界人工智能大会暨人工智能全球治理高级别会议(简称“WAIC 2024”)上,阶跃星辰首发了三款 Step 系列通用大模型新品:Step-2 万亿参数语言大模型正式版、Step-1.5V 多模态大模型、Step-1X 图像生成大模型。