全新模型RoboVLMs解锁VLA无限可能,真实机器人实验交出满分答卷

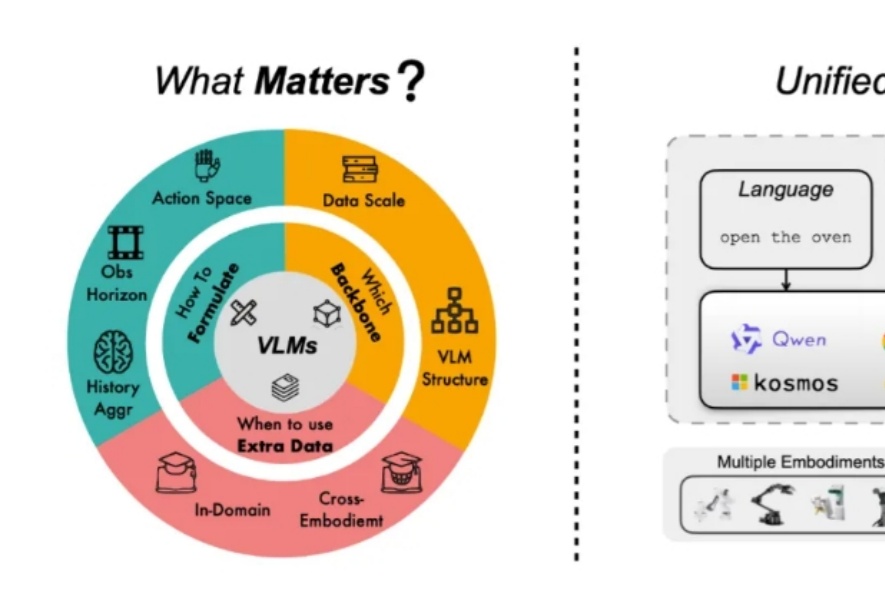

全新模型RoboVLMs解锁VLA无限可能,真实机器人实验交出满分答卷近年来,视觉语言基础模型(Vision Language Models, VLMs)大放异彩,在多模态理解和推理上展现出了超强能力。现在,更加酷炫的视觉语言动作模型(Vision-Language-Action Models, VLAs)来了!通过为 VLMs 加上动作预测模块,VLAs 不仅能 “看” 懂和 “说” 清,还能 “动” 起来,为机器人领域开启了新玩法!