吴恩达开新课教OCR!用Agent搞定文档提取

吴恩达开新课教OCR!用Agent搞定文档提取随着AI大模型研发在架构、记忆、存储等等领域的深水区创新,OCR重新成为了技术专项。DeepSeek在研究、智谱在研究、阿里千问和腾讯混元也都在研究……还得是吴恩达老师,火速来了新课程,帮你速通OCR。

搜索

搜索

随着AI大模型研发在架构、记忆、存储等等领域的深水区创新,OCR重新成为了技术专项。DeepSeek在研究、智谱在研究、阿里千问和腾讯混元也都在研究……还得是吴恩达老师,火速来了新课程,帮你速通OCR。

新年第一天,DeepSeek 发布了一篇艰深晦涩的技术论文,不少网友直呼「看不懂」。

1 月 15 日上午,千问又前进了一大步,已经准备让智能体全面接管我们的日常生活了。千问 App 上线了全新 AI Agent 能力「任务助理」,同时全面打通阿里生态,一次开启了 400 多项新功能,邀请测试与灰度上线已经同步开启,全都是免费可用的。

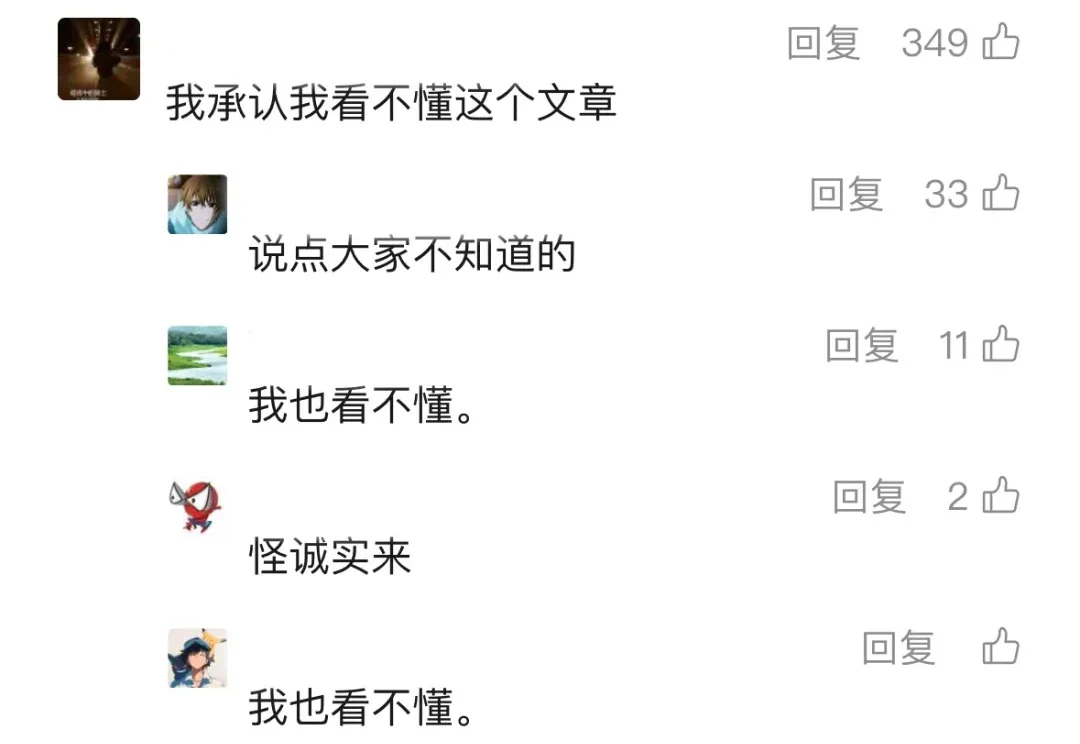

抽奖式的生图体验,确实让很多设计师在尝鲜之后又默默打开了 Photoshop。于是乎,阿里千问团队再次出手,开源了一个叫 Qwen-Image-Layered 的模型,试图从底层逻辑上解决这个问题。

抢夺AI交互入口,加快AI眼镜普及。

大家还记得Mira Murati吗?那个曾经主导ChatGPT开发的“AI女王”,OpenAI的前CTO,2024年突然离职后,让整个科技圈炸锅!短短几个月,融资20亿美元,估值飙到120亿美元,现在更传出新一轮融资目标直冲500亿美元!这速度,这手笔,简直是AI界的“神话”!而最近的重磅炸弹来了:他们的首款产品Tinker正式全面开放!不再需要等待名单,人人可用!

能写作策划、能生成PPT,还能在线编辑,最关键的是:还能白嫖~刚刚,阿里千问悄悄把办公和写作能力升级了一遍:文档生成、智能排版、在线编辑、多格式转换全都打包进一个入口里:

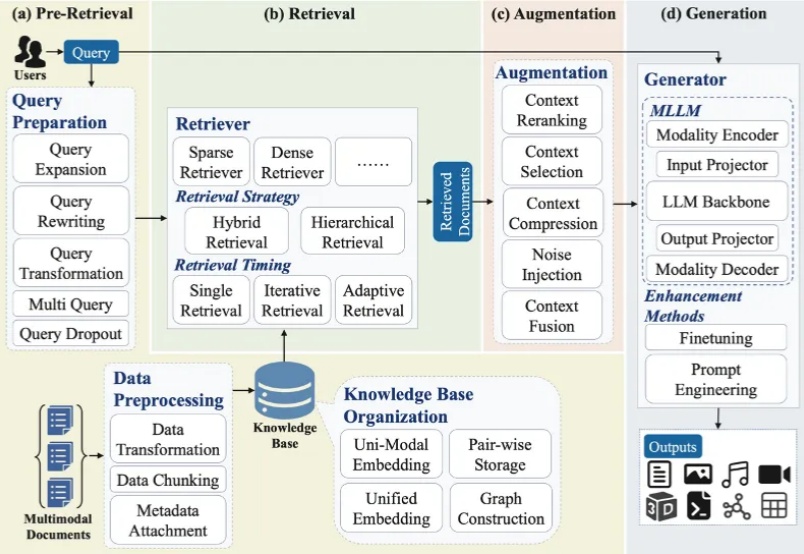

大模型最广泛的应用如 ChatGPT、Deepseek、千问、豆包、Gemini 等通常会连接互联网进行检索增强生成(RAG)来产生用户问题的答案。随着多模态大模型(MLLMs)的崛起,大模型的主流技术之一 RAG 迅速向多模态发展,形成多模态检索增强生成(MM-RAG)这个新兴领域。ChatGPT、千问、豆包、Gemini 都开始允许用户提供文字、图片等多种模态的输入。

千问 App,大家都用上了吧?

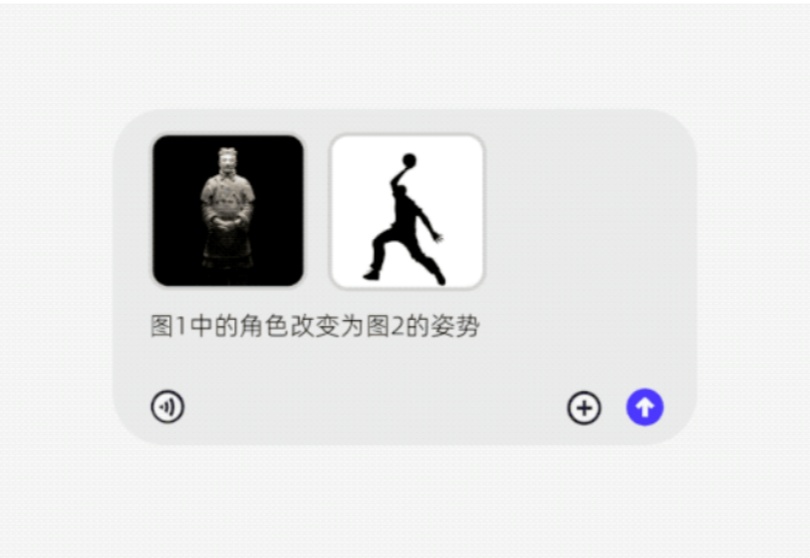

让兵马俑跳 K-Pop 是什么体验?