19岁退学哈佛CS,这个00后两年打造百亿独角兽!月收入5000万,AI招聘官杀疯了

19岁退学哈佛CS,这个00后两年打造百亿独角兽!月收入5000万,AI招聘官杀疯了19岁退学哈佛,投身AI创业,跟硅谷大佬称兄道弟,走上人生巅峰!如今,三位00后创始人的这家AI招聘公司,已经估值20亿美元,用时两年成为百亿级独角兽,如今单月收入700万美元,年化收入已达7500万刀。

19岁退学哈佛,投身AI创业,跟硅谷大佬称兄道弟,走上人生巅峰!如今,三位00后创始人的这家AI招聘公司,已经估值20亿美元,用时两年成为百亿级独角兽,如今单月收入700万美元,年化收入已达7500万刀。

最近,一位哈佛教授痛心疾首地曝出,DeepSeek本来有机会诞生在美国?原本DeepSeek的工程师可以拿到英伟达的全职offer,美国却没有将他留住,导致「钱学森回国」的故事再一次上演,美国跟「国运级AI」擦肩而过!

就在刚刚,哈佛华人研究员Jeffrey Wang正式官宣加入OpenAI——

o1-preview在医疗诊断中远超人类,赛博看病指日可待?

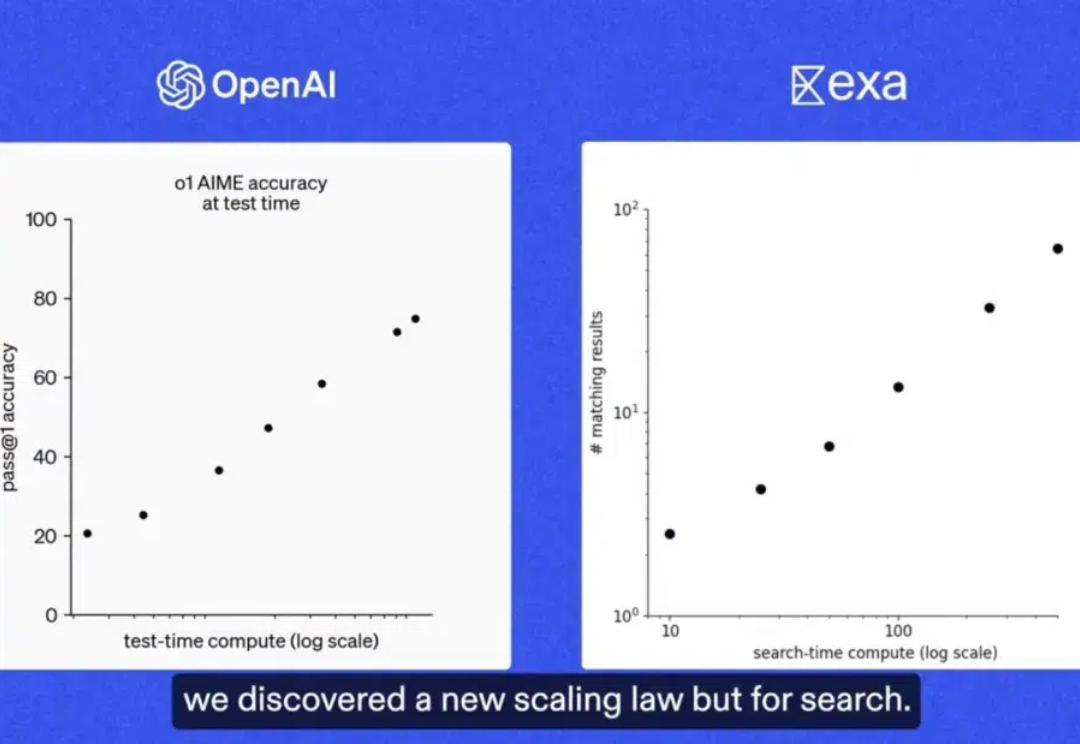

不像西部世界的 AI 那么智能,现在的 AI 经常没办法满足我的小众需求。 我开始以为是模型能力的问题,但是试用了各家的 AI 发现它们都因为使用的搜索引擎 API 无法搜出相关内容而无法解答。

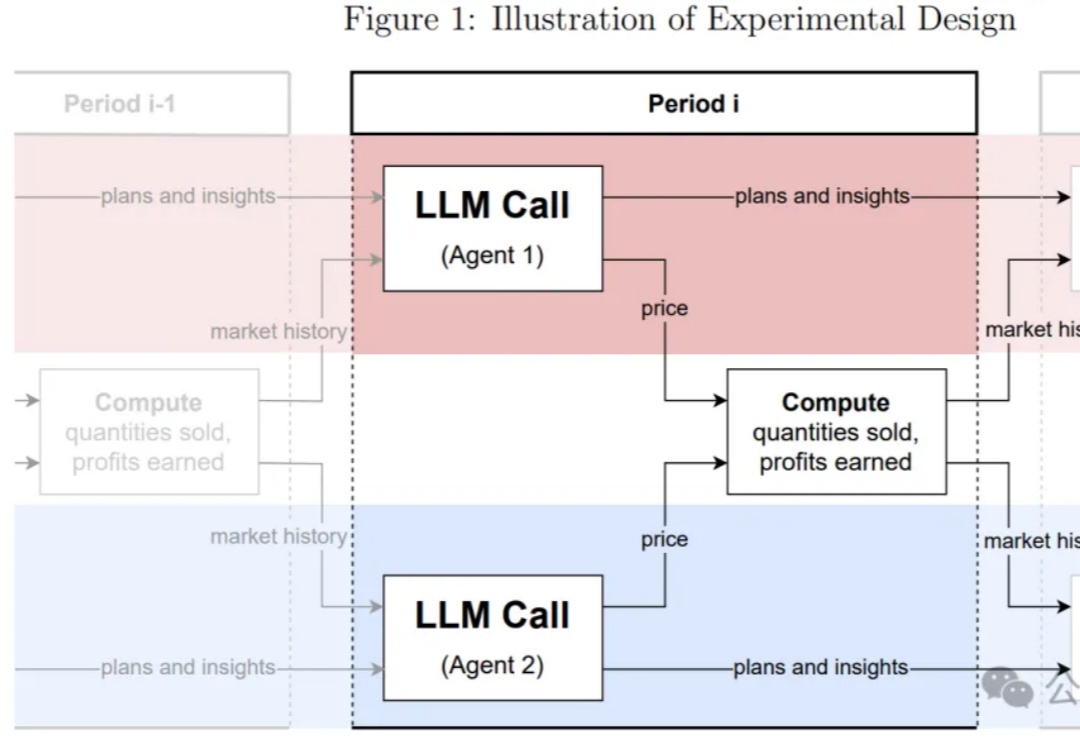

又一科幻场景步入现实!GPT-4竟和多个AI模型私自串通一气,欲要形成垄断的资本寡头联合定价。在被哈佛PSU团队抓现行后,大模型拒不认账。未来某天,AI会不会真要失控?

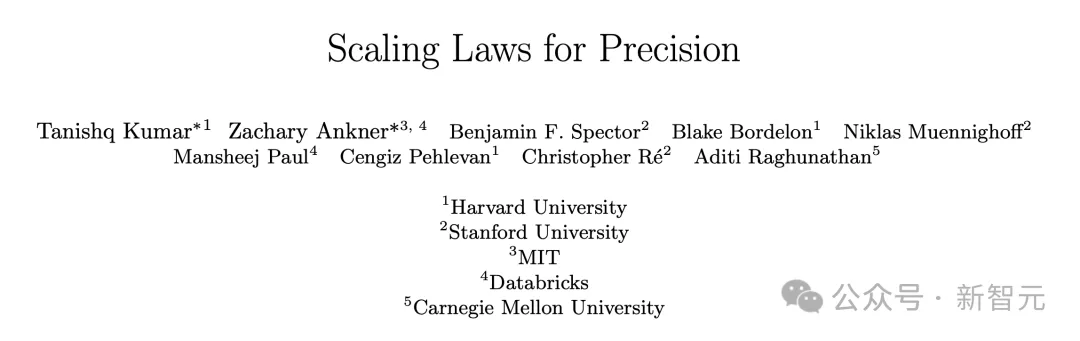

哈佛斯坦福MIT等机构首次提出「精度感知」scaling law,揭示了精度、参数规模、数据量之间的统一关系。数据量增加,模型对量化精度要求随之提高,这预示着AI领域低精度加速的时代即将结束!

4-bit量化,能让现有反学习/机器遗忘技术失灵!

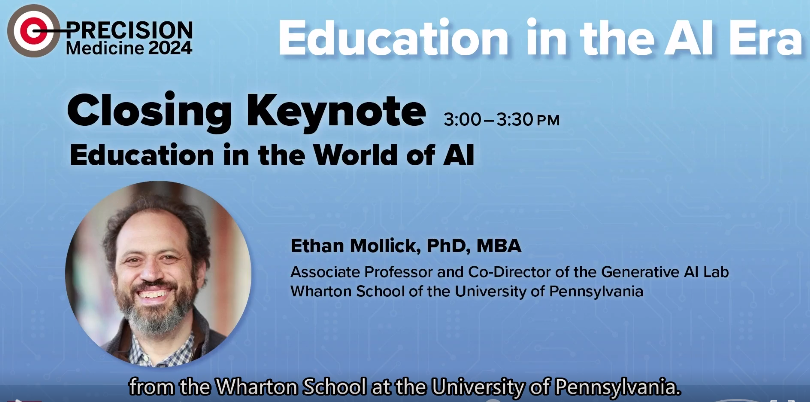

最近,宾夕法尼亚大学沃顿商学院的Ethan Mollick教授在常春藤名校哈佛大学发表了一场引人深思的讲座。

能够执行多种任务,识别19种癌症类型,预测患者生存率……哈佛医学院研究人员提出CHIEF,一种多功能AI癌症诊断模型,表现出类似于ChatGPT的灵活性,远超其他现有的癌症诊断模型。