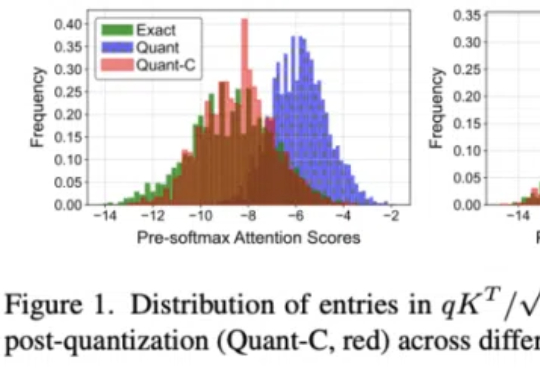

10倍吞吐提升无损性能:多模态适用的KV cache量化策略来了,即插即用无需改原模型

10倍吞吐提升无损性能:多模态适用的KV cache量化策略来了,即插即用无需改原模型在InternVL-2.5上实现10倍吞吐量提升,模型性能几乎无损失。

搜索

搜索

在InternVL-2.5上实现10倍吞吐量提升,模型性能几乎无损失。

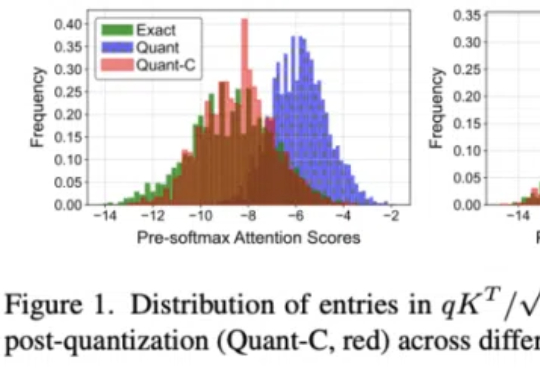

字节有一个很实用但不怎么火的项目,叫 Midscene.js,Chrome 商店上的安装数仅有 1 万,它是一个由多模态模型驱动的前端自动化测试插件。自动化测试我平常很少用到,但我发现它特别适合用来写爬虫……

4D LangSplat通过结合多模态大语言模型和动态三维高斯泼溅技术,成功构建了动态语义场,能够高效且精准地完成动态场景下的开放文本查询任务。该方法利用多模态大模型生成物体级的语言描述,并通过状态变化网络实现语义特征的平滑建模,显著提升了动态语义场的建模能力。

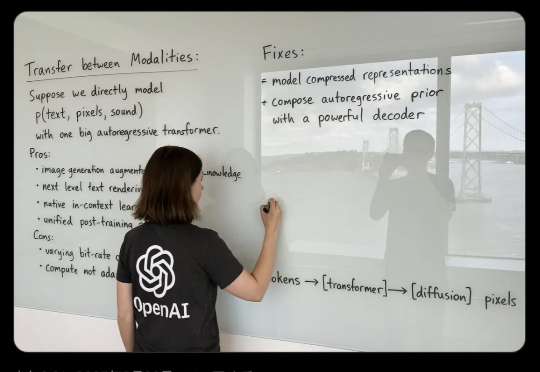

最近,ChatGPT 4o 新上线了多模态绘图功能,‘吉卜力’刷爆了特工们朋友圈的同时,也夹带着艺术设计圈朋友们的哀嚎,最让我们共情的莫过于推上的此段发言:

一夜之间,CV被大模型“解决”了(狗头)。万物皆可吉卜力之后,GPT-4o原生多模态图像生成更多玩法被开发出来。万物皆可吉卜力之后,GPT-4o原生多模态图像生成更多玩法被开发出来。

GPT4o的多模态生图前天上线之后。经过两天的发酵,含金量还在不断提升。

又双叒,抢在OpenAI直播之前,谷歌Gemini 2.5系列来了。首个版本Pro Experimental一登场就抢下大模型竞技场第一名,并且整整比GPT-4.5高出40分Gemini 2.5同样是推理模型,用Jeff Dean的说法是:

在ChatGPT上,当你画图的选项变成这个的时候,就说明用的不是Dalle3了,而是4o。目前,有两个渠道可以使用4o Image Generation。一个事ChatGPT,一个是单独的那个Sora的网站。

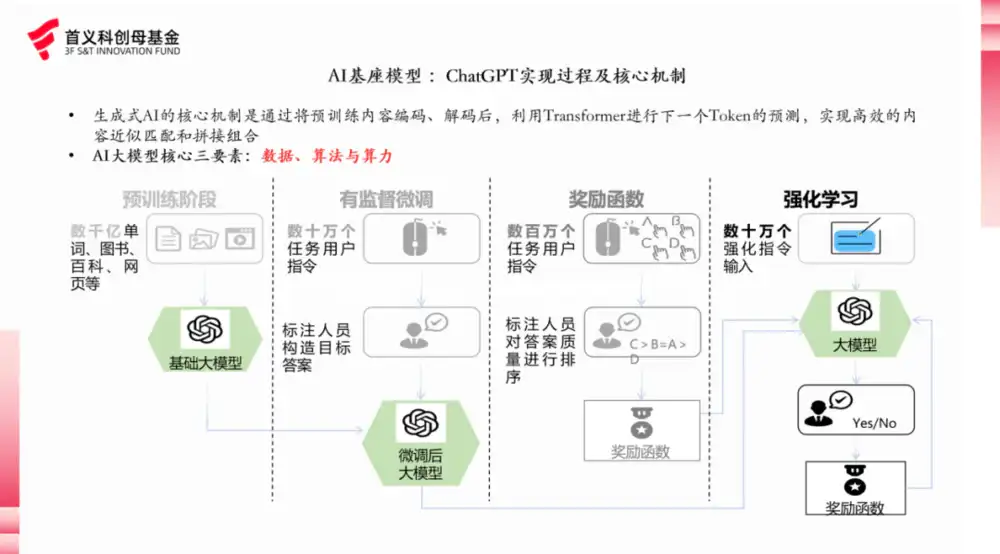

在引发全球关注的同时,全球资本对中国科技资产的重新评估与 AI 投资的底层逻辑也悄然发生转变。尤其是在大模型领域,过去巨额投入却屡次推迟的ChatGPT5和本就步入下半场的国内六小龙,将直面 DeepSeek这匹黑马的强劲冲击。中国AI企业在DeepSeek突破了“算力禁运”之后,正面临高质量数据稀缺的挑战,尤其是高质量、低成本、多种类、多模态的数据,将成为未来 AI 产业发展的核心关键。

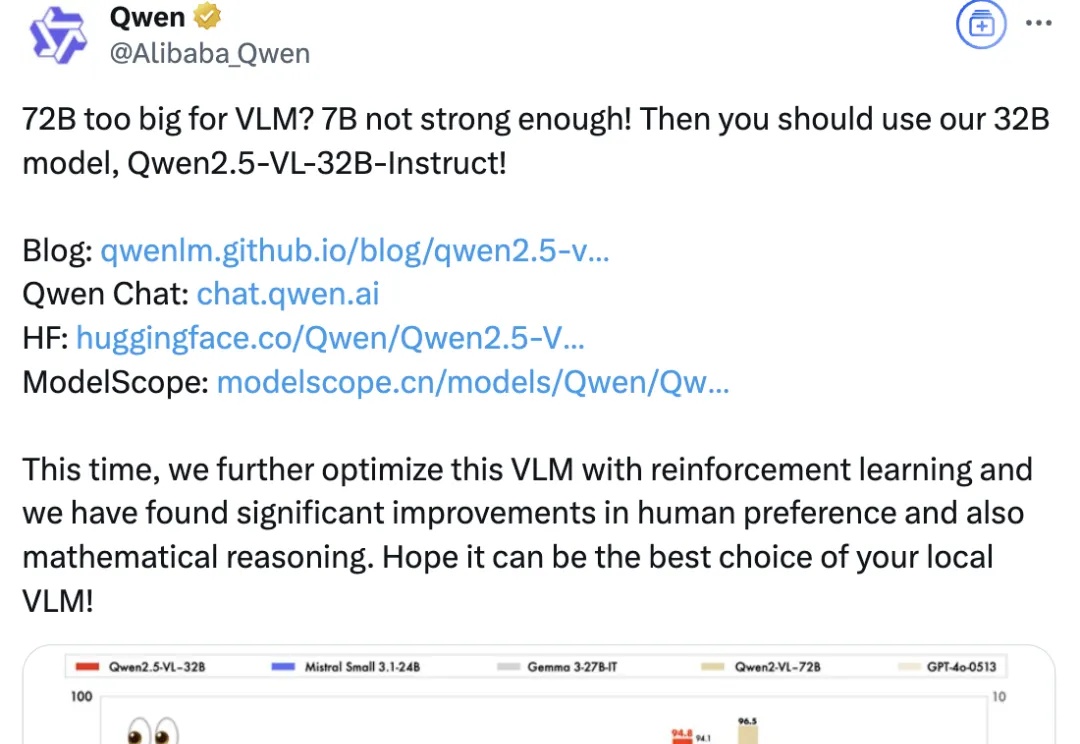

就在DeepSeek-V3更新的同一夜,阿里通义千问Qwen又双叒叕一次梦幻联动了——