Deepseek妙语连珠,是否触达了人类语言的根源?

Deepseek妙语连珠,是否触达了人类语言的根源?当我们惊叹于Deepseek的妙语连珠时,是否正目睹硅基系统对人类语言本源的复刻?那在服务器集群中奔流的矩阵运算,与人脑皮层间跳跃的神经电波,究竟共享着怎样的“语言密码”?

当我们惊叹于Deepseek的妙语连珠时,是否正目睹硅基系统对人类语言本源的复刻?那在服务器集群中奔流的矩阵运算,与人脑皮层间跳跃的神经电波,究竟共享着怎样的“语言密码”?

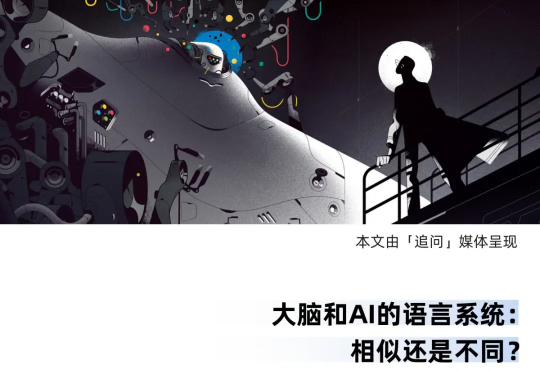

「慢思考」(Slow-Thinking),也被称为测试时扩展(Test-Time Scaling),成为提升 LLM 推理能力的新方向。近年来,OpenAI 的 o1 [4]、DeepSeek 的 R1 [5] 以及 Qwen 的 QwQ [6] 等顶尖推理大模型的发布,进一步印证了推理过程的扩展是优化 LLM 逻辑能力的有效路径。

xAI、谷歌DeepMind和Anthropic的CEO们纷纷对DeepSeek的技术创新性提出质疑,认为其并未带来实质性的科学突破。AI大佬纷纷泼冷水,到底是技术讨论还是各怀目的?

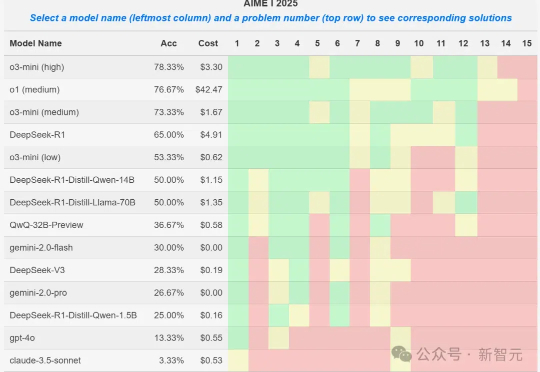

就在刚刚,AIME 2025 I数学竞赛的大模型参赛结果出炉,o3-mini取得78%的最好成绩,DeepSeek R1拿到了65%,取得第四名。然而一位教授却发现,某些1.5B小模型竟也能拿到50%,莫非真的存在数据集污染?

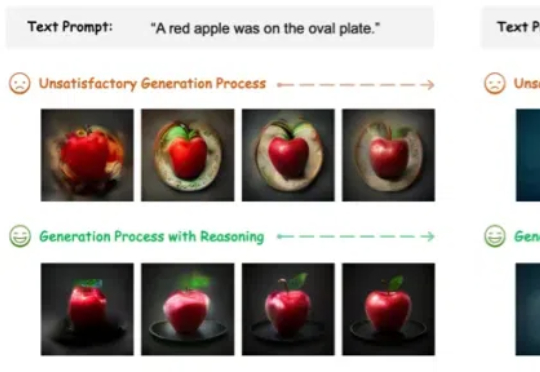

图像生成模型,也用上思维链(CoT)了!此外,作者还提出了两种专门针对该任务的新型奖励模型——潜力评估奖励模型。(Potential Assessment Reward Model,PARM)及其增强版本PARM++。

当ChatGPT用对话颠覆人机交互时,车企们早已嗅到了AI大模型的潜力——从语音助手到自动驾驶,从情感陪伴到场景决策,智能座舱的体验边界正被重新定义。

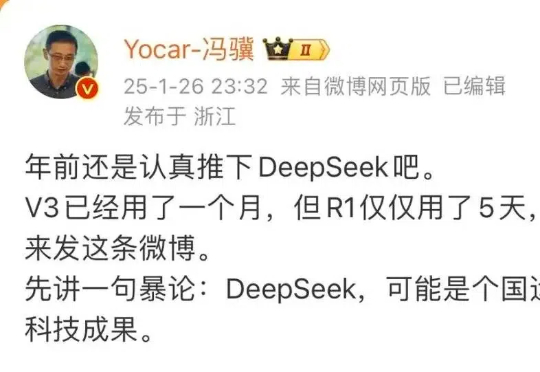

DeepSeek让国内一众大模型同行度过了一个“痛苦”的春节。年前,DeepSeek掀起AI海啸,有某大厂大模型业者就捶胸顿足:“产品超出了我的想象,比咱家的各方面都好,真想跳槽到DeepSeek。”还有很多人反思,为啥咱自家就没做出DeepSeek。也有业者不服气,认为“它的火只是一种情绪的泡沫。”

在柏林工业大学的一场圆桌对话当中,奥特曼再一次谈到了DeepSeek,并大赞开源模型对世界的贡献。对话中,奥特曼还发表了对AGI的最新看法,透露了十足的信心,他认为,虽然会遇到阻碍和挑战,但他相信人类终将实现AGI。

刚刚,腾讯云再放大招——不仅上线了 DeepSeek-R1 和 V3 原版模型的 API 接口,还将它们接入了大模型知识引擎,并支持联网搜索,成为国内率先实现这一能力的云厂商。

“我肯定会投啊!我肯定会投!——这个价格已经不太重要了,关键是参与在这里面。”1年前,2024年初,在我们关于《朱啸虎讲了一个中国现实主义AIGC故事》的报道中,朱啸虎的观点淋漓尽致地展现了一个现实版中国AI故事。他用“我们一看就知道,这个肯定没戏”,“我们一开始就说了,我就不看好大模型”,“ 我都不愿意去聊,你知道吗?这没有意义”,表态绝不会投资6家中国大模型创业公司中的任何一家。