苹果让大模型学会偷懒:更快吐出第一个token,准确度还保住了

苹果让大模型学会偷懒:更快吐出第一个token,准确度还保住了Llama 3.1 刚刚发布,你是否已经尝试了呢?就算你的个人计算机是最近的顶尖配置,运行其中最小的 8B 版本可能也依然会有明显延迟。为了提升模型的推理效率,研究者想出了多种多样的方法,但其中很多都会让模型牺牲一些准确度。

Llama 3.1 刚刚发布,你是否已经尝试了呢?就算你的个人计算机是最近的顶尖配置,运行其中最小的 8B 版本可能也依然会有明显延迟。为了提升模型的推理效率,研究者想出了多种多样的方法,但其中很多都会让模型牺牲一些准确度。

7月26日,《北京市推动“人工智能+”行动计划(2024—2025年)》(以下简称《行动计划》)正式对外发布。

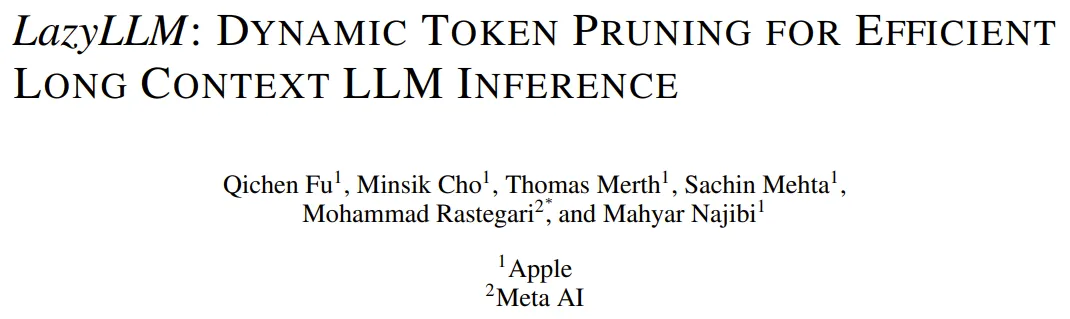

这么强的模型,谷歌给大家免费试用。

单卡搞定Llama 3.1(405B),最新大模型压缩工具来了!

现在,大模型可以做私人导游,为你规划Citywalk路线了——

人工智能毫无疑问是当今一项重要议题,通过大模型、垂类应用、智能体等多种方式推动着数字经济的发展。

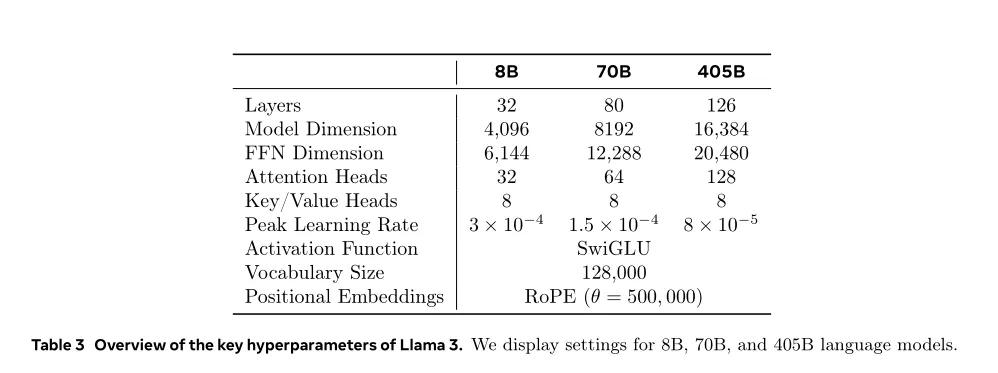

不同类型的数据配比如何配置:先通过小规模实验确定最优配比,然后将其应用到大模型的训练中。 Token配比结论:通用知识50%;数学与逻辑25%;代码17%;多语言8%。

数值天气预报是现在,AI 天气预报会是未来吗?

Transformer大模型尺寸变化,正在重走CNN的老路!

是时候用CPU通用服务器跑千亿参数大模型了!