最强开源编程大模型一夜易主:精通80+语言,仅22B

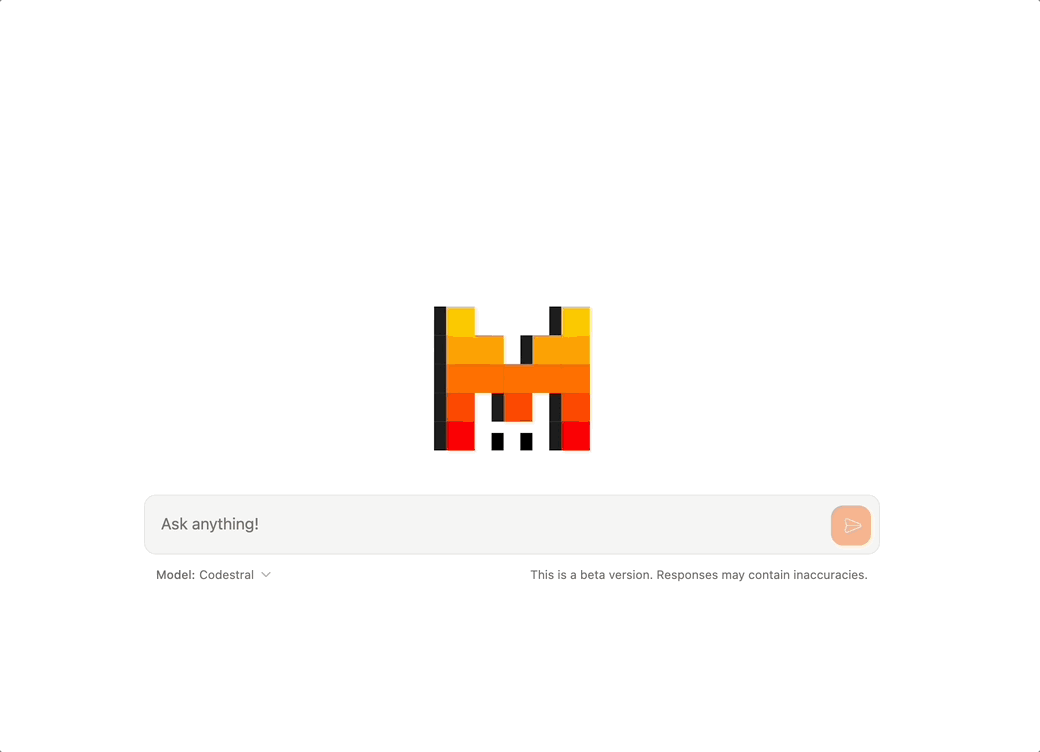

最强开源编程大模型一夜易主:精通80+语言,仅22B开源代码大模型的王座,再次易主! 来自素有“欧洲OpenAI”之称的Mistral,用22B参数量表现超越了70B的Code Llama。

开源代码大模型的王座,再次易主! 来自素有“欧洲OpenAI”之称的Mistral,用22B参数量表现超越了70B的Code Llama。

本文探讨了大模型未来三年的发展趋势,从AI在2B和2C领域的应用到Real Economic Impact的影响,再到工业领域和能源需求等方面进行了深入分析。

每个token只需要5.28%的算力,精度就能全面对标Llama 3。

挤爆了,简直要被大模型公司们给挤爆了。

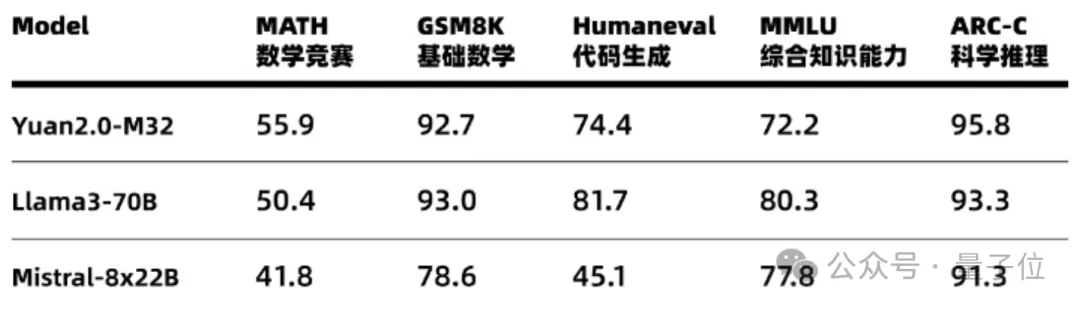

在LLM能力突飞猛进的当下,所有研究者似乎都在关注数据、算力、算法等模型开发的各个方面,但OpenAI研究员Jason Wei最近发布的一篇博客文章提醒我们,模型评估的工作同样非常重要。如何开发出优秀的评估测试,对AI能力的发展方向至关重要。

一直以来,UC伯克利团队的LMSYS大模型排行榜,深受AI圈欢迎。如今,最有实力的全新大模型排行榜SEAL诞生,得到AI大佬的转发。它最大的特点是在私有数据上,由专家严格评估,并随时间不断更新数据集和模型。

搜集了328×204条数据,只为让机器人把开门这一件事做到极致。

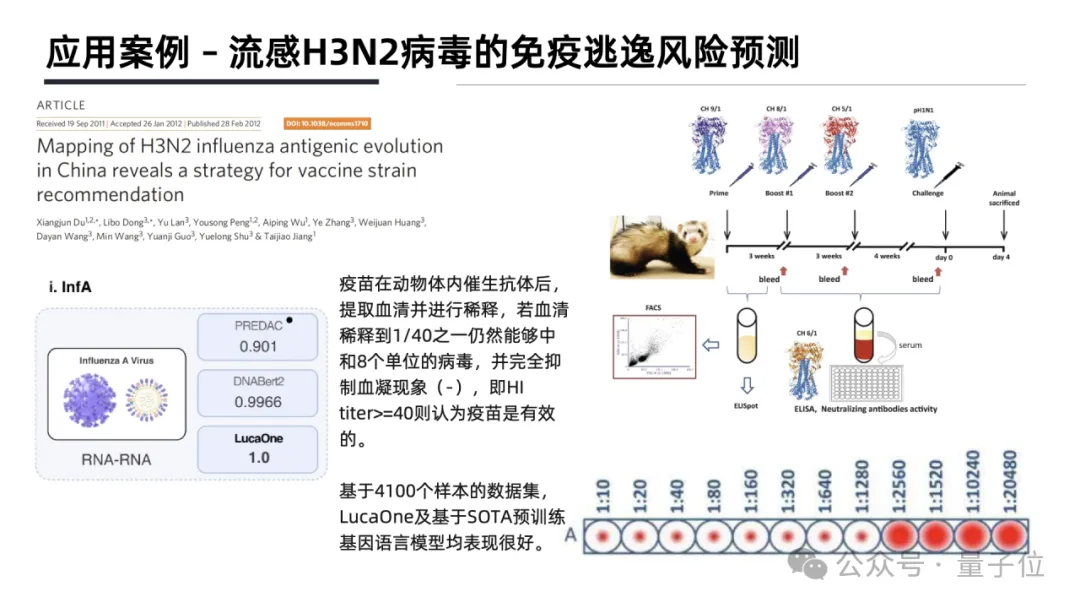

把169861个生物物种数据装进大模型,大模型竟get到了生物中心法则的奥秘——

医学影像,越来越需要AI的帮助了。

在大模型实际部署落地的过程中,如何赋予大模型持续学习的能力是一个至关重要的挑战。这使其能够动态适应新的任务并不断获得新的知识。大模型的持续学习主要面临两个重大挑战,分别是灾难性遗忘和知识迁移。灾难性遗忘是指模型在学习新任务时,会忘记其已掌握的旧任务。知识迁移则涉及到如何在学习新任务时有效地应用旧任务的知识来提升新任务学习的效果。