国内首个!最火的MoE大模型APP来了,免费下载,人人可玩

国内首个!最火的MoE大模型APP来了,免费下载,人人可玩MoE(混合专家)作为当下最顶尖、最前沿的大模型技术方向,MoE能在不增加推理成本的前提下,为大模型带来性能激增。比如,在MoE的加持之下,GPT-4带来的用户体验较之GPT-3.5有着革命性的飞升。

MoE(混合专家)作为当下最顶尖、最前沿的大模型技术方向,MoE能在不增加推理成本的前提下,为大模型带来性能激增。比如,在MoE的加持之下,GPT-4带来的用户体验较之GPT-3.5有着革命性的飞升。

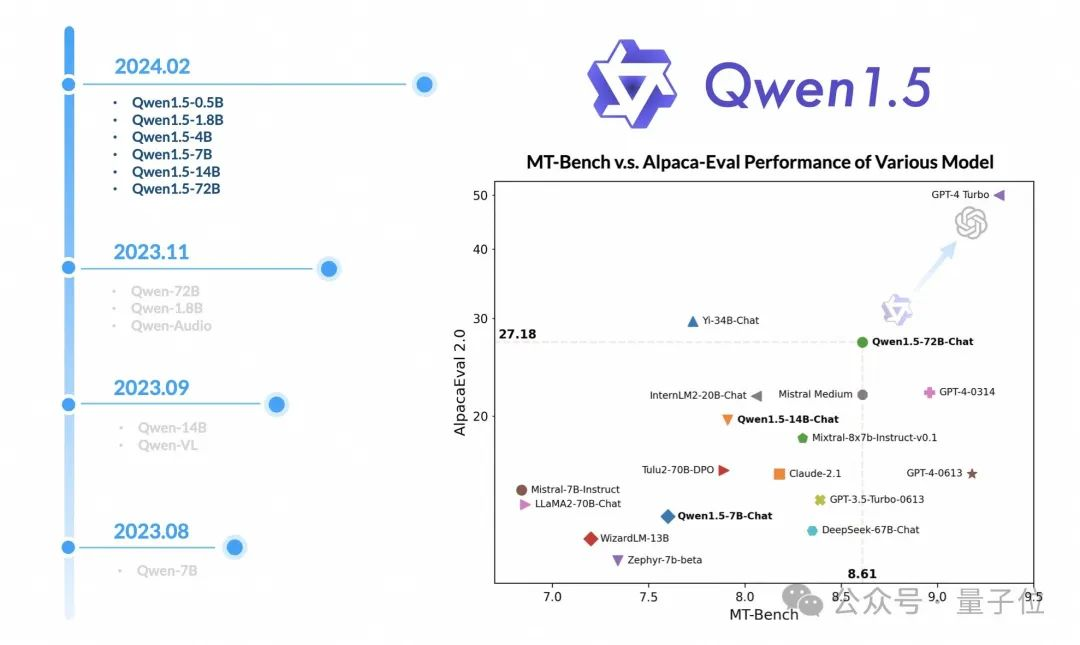

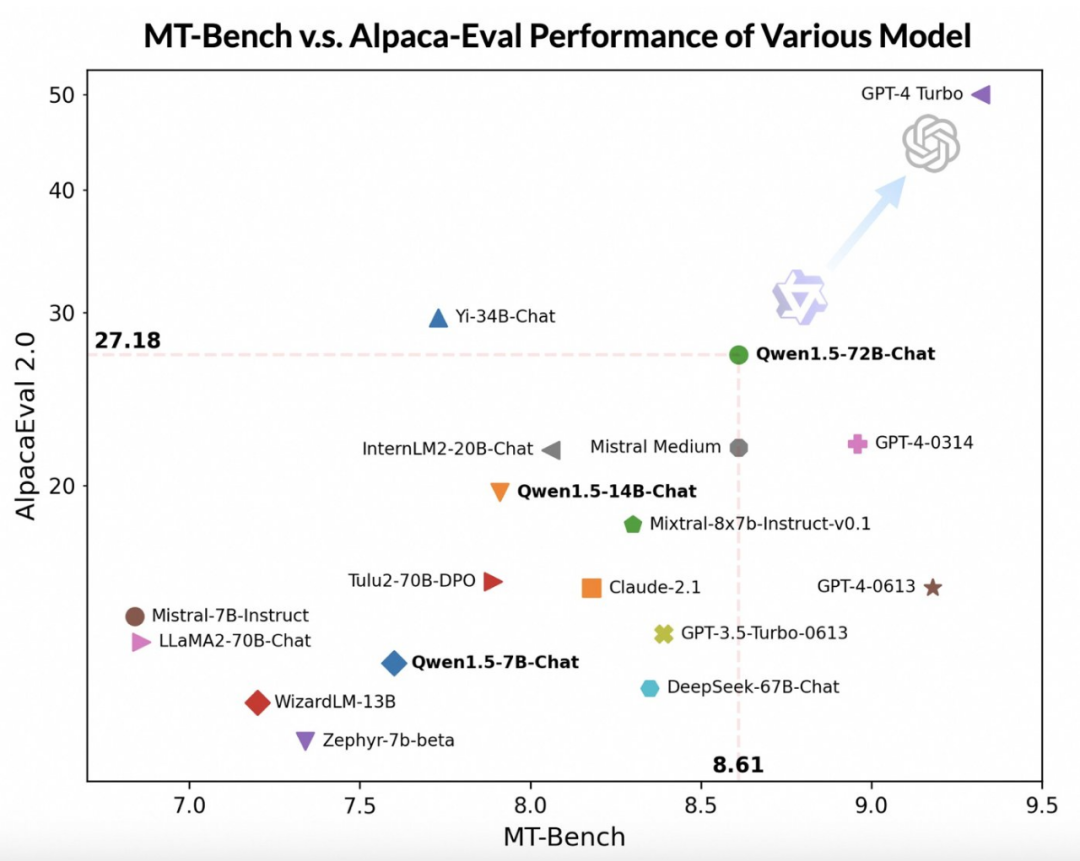

阿里大模型,再次开源大放送——发布Qwen1.5版本,直接放出六种尺寸。

赶在春节前,通义千问大模型(Qwen)的 1.5 版上线了。今天上午,新版本的消息引发了 AI 社区关注。

现有的语义分割技术在评估指标、损失函数等设计上都存在缺陷,研究人员针对相关缺陷设计了全新的损失函数、评估指标和基准,在多个应用场景下展现了更高的准确性和校准性。

「天工AI」国内首个MoE架构免费向C端用户开放的大语言模型应用全新问世。

当AI大模型在2023年飞速成熟后,几乎每个行业都在尝试“AI赋能”,并希望AI能够化腐朽为神奇。

2024开年伊始,一场震撼全球的AI竞赛即将拉开帷幕。

MiniCPM 是一系列端侧语言大模型,主体语言模型 MiniCPM-2B 具有 2.4B 的非词嵌入参数量。

今天,穆罕默德・本・扎耶德人工智能大学 VILA Lab 带来了一项关于如何更好地为不同规模的大模型书写提示词(prompt)的研究,让大模型性能在不需要任何额外训练的前提下轻松提升 50% 以上。该工作在 X (Twitter)、Reddit 和 LinkedIn 等平台上都引起了广泛的讨论和关注。

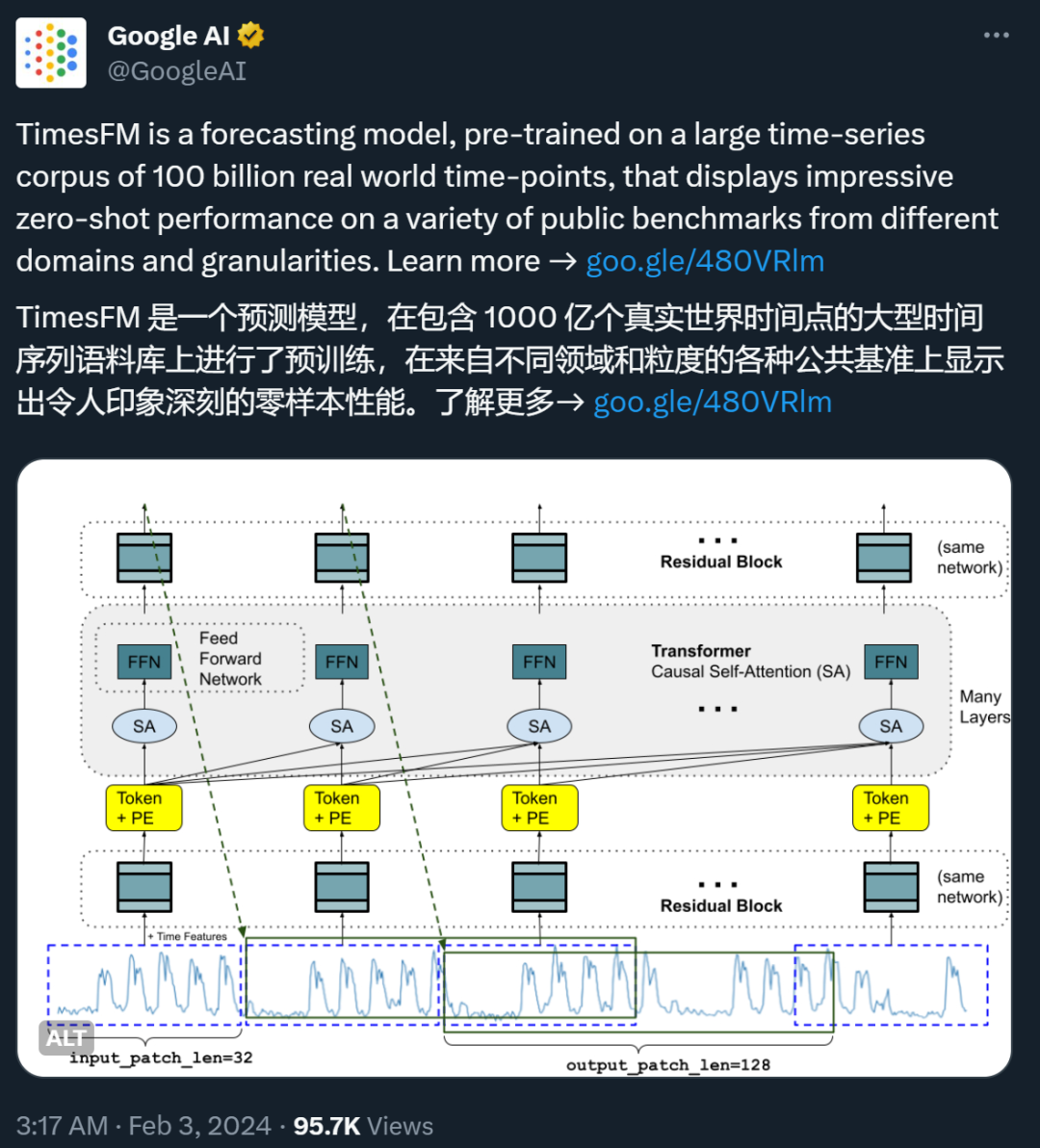

最近,谷歌的一篇论文在 X 等社交媒体平台上引发了一些争议。