一个提示,让Llama 2准确率飙至80.3%?Meta提出全新注意力机制S2A,大幅降低模型幻觉

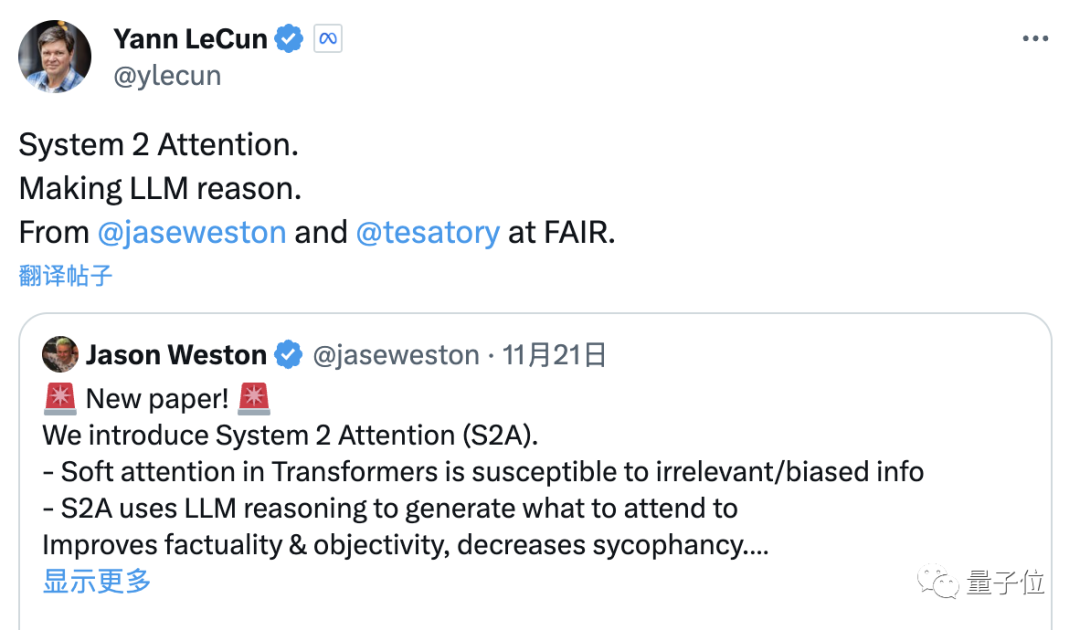

一个提示,让Llama 2准确率飙至80.3%?Meta提出全新注意力机制S2A,大幅降低模型幻觉大语言模型「拍马屁」的问题到底要怎么解决?最近,LeCun转发了Meta发布的一篇论文,研究人员提出了新的方法,有效提升了LLM回答问题的事实性和客观性。我们一起来看一下吧。

搜索

搜索

大语言模型「拍马屁」的问题到底要怎么解决?最近,LeCun转发了Meta发布的一篇论文,研究人员提出了新的方法,有效提升了LLM回答问题的事实性和客观性。我们一起来看一下吧。

浪潮信息发布源2.0基础大模型,并一口气开源了1026亿、518亿、21亿三个大模型!而在编程、推理、逻辑这些老大难问题上,源2.0都表现出了令人印象深刻的性能。

字节被称为“App工厂”,不少市场声音对字节跳动将这一能力带到大模型时代抱有期待。字节跳动近期成立了一个新AI部门Flow,技术负责人为字节跳动技术副总裁洪定坤。一位知情人士告诉36氪,这一新部门的业务带头人,为字节大模型团队的负责人朱文佳。

八月华为第一个宣布将大模型接入手机助手,小米、OV 紧随其后。就连一向“慢半拍”的苹果和三星,一个悄悄招人;一个则宣布会将大模型带到最新的 Galaxy 旗舰机型。

今年,大型语言模型改变了自动驾驶技术路线的竞争格局。特斯拉开始探索自动驾驶的世界模型,而中国企业加速推进自动驾驶技术,超过美国。

关于大模型注意力机制,Meta又有了一项新研究。通过调整模型注意力,屏蔽无关信息的干扰,新的机制让大模型准确率进一步提升。而且这种机制不需要微调或训练,只靠Prompt就能让大模型的准确率上升27%。

思维链已经out啦!想让大模型会推理还是得靠知识库:基座模型还是ChatGPT,最新思维图谱技术在多个基准数据集上实现巨大性能提升!

由南洋理工华人团队新提出的80亿参数多模态大模型OtterHD,不仅可以搞定让GPT-4V都发愁的难题,甚至还可以数出来《清明上河图》(局部)里到底有多少只骆驼!

我们都知道,大语言模型(LLM)能够以一种无需模型微调的方式从少量示例中学习,这种方式被称为「上下文学习」(In-context Learning)。这种上下文学习现象目前只能在大模型上观察到。比如 GPT-4、Llama 等大模型在非常多的领域中都表现出了杰出的性能,但还是有很多场景受限于资源或者实时性要求较高,无法使用大模型。

破除虚妄,务实求效。11月9日,在2023金融街论坛“构建数实融合新模式,助力产业数字金融新发展”分论坛上,中国银保传媒与腾讯研究院联合发布《2023金融业大模型应用报告》,深入解析大模型发展趋势,建立金融业大模型应用体系化蓝图,指引数智金融产业演进。