全国首个!腾讯“龙虾”上线医疗skill,AI医疗大战彻底白热化!

全国首个!腾讯“龙虾”上线医疗skill,AI医疗大战彻底白热化!近日,腾讯健康宣布,港股上市AI医疗企业中康科技正式入驻“腾讯龙虾”WorkBuddy,成为其医疗健康垂类Skill的首个合作伙伴。

搜索

搜索

近日,腾讯健康宣布,港股上市AI医疗企业中康科技正式入驻“腾讯龙虾”WorkBuddy,成为其医疗健康垂类Skill的首个合作伙伴。

一个毫无代码的文本,竟连霸GitHub热榜第一。Karpathy的编程神技被化作「AI紧箍咒」,让乱写Bug的大模型瞬间老实!

在 AI 工程界,长文本推理一直是个“富贵病”。

今日,亚马逊宣布将向美国AI大模型独角兽Anthropic投资50亿美元(约合人民币341亿元),未来还将根据一些商业里程碑的达成情况,追加投资至多200亿美元(约合人民币1364亿元)。

当前大模型的发展呈现出类似于“军备竞赛”的趋势——模型规模持续攀升,对计算硬件的需求也随之快速增长。

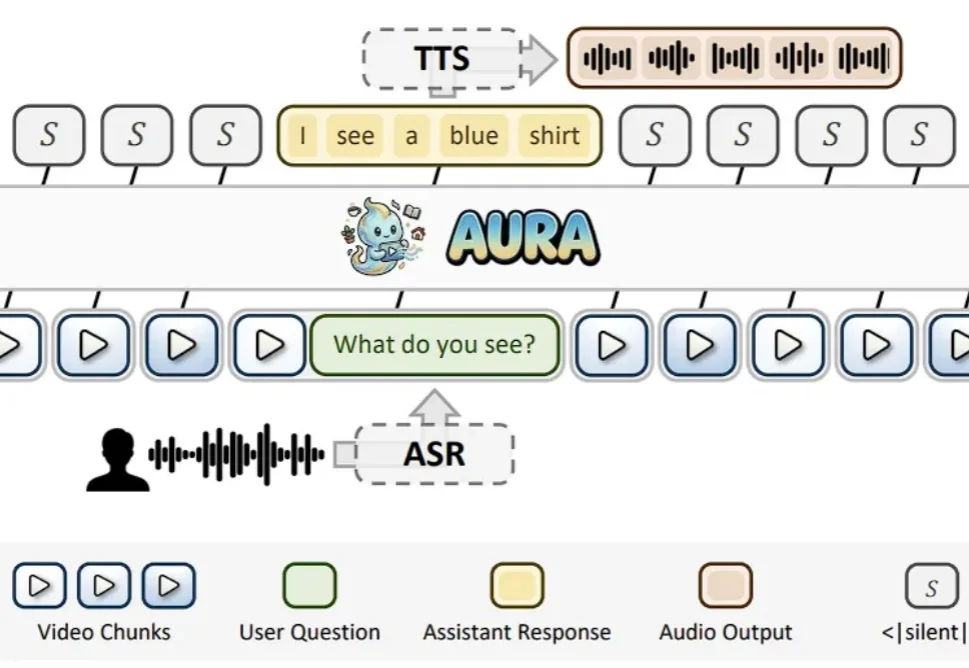

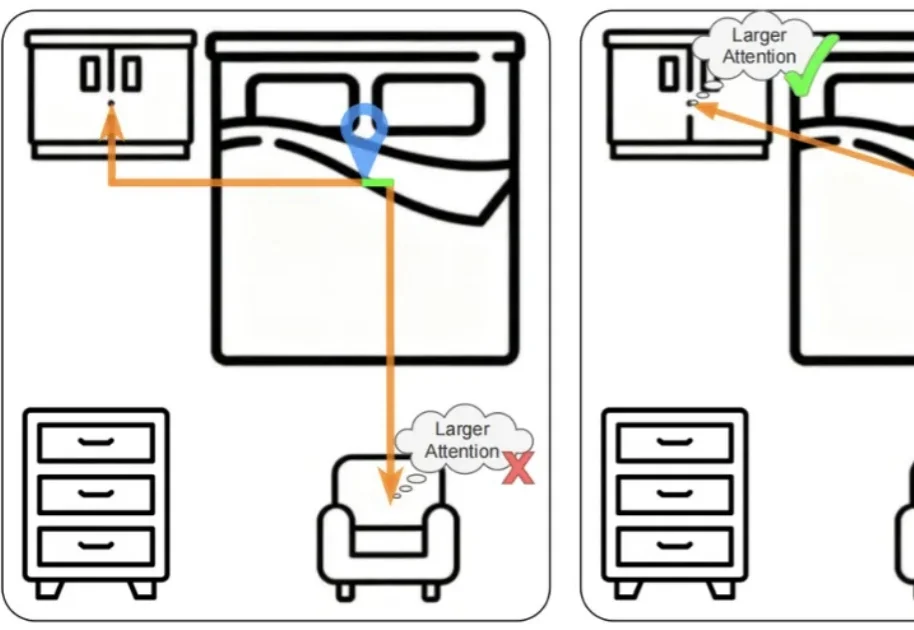

近年来,视频多模态大模型(VideoLLM)发展迅猛,在视频描述、视频问答、时序定位等任务上不断刷新性能上限。随着模型能力持续增强,业界也开始思考一个更重要的问题:视频大模型能不能不再只是 “看完一段视频再回答”,而是真正进入实时世界,持续观察、实时理解,并在关键时刻主动给出反馈?

英伟达良心福利!免费领一年顶级大模型订阅,MiniMax / Kimi / DeepSeek 全都能用!NVIDIA 官方平台build.nvidia.com开放了一批"Free Endpoint"模型,注册账号、验证手机号后就能生成一把最长有效期12 个月的 API Key,免费调用几十个当下最火的大模型——不计 Token、无余额限制、无需信用卡。

当全行业还在卷大模型参数、烧算力、拼Token消耗时,已经有企业实打实地在用大模型帮客户赚到真金白银。

量子位获悉,商汤医疗已于年初完成超5亿元战略融资,公司估值正式迈入10亿美元独角兽行列。

本文主要介绍来自该团队的最新论文:Scalable Object Relation Encoding for Better 3D Spatial Reasoning in Large Language Models。