TPAMI | 安全强化学习方法、理论与应用综述,慕工大、同济、伯克利等深度解析

TPAMI | 安全强化学习方法、理论与应用综述,慕工大、同济、伯克利等深度解析现实世界中的强化学习在应用过程中也面临着巨大的挑战,尤其是如何保证系统的安全性。为了解决这一问题,安全强化学习(Safe Reinforcement Learning, Safe RL)应运而生,成为当前学术界和工业界关注的焦点。

现实世界中的强化学习在应用过程中也面临着巨大的挑战,尤其是如何保证系统的安全性。为了解决这一问题,安全强化学习(Safe Reinforcement Learning, Safe RL)应运而生,成为当前学术界和工业界关注的焦点。

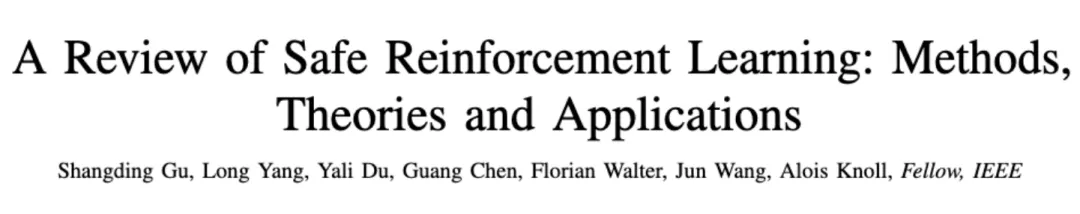

随着 AI 模型的参数量越来越大,对算力的需求也水涨船高。

由人的工具变成“隔离人”的工具。人与人之间的工作生活交流,AI场景越来越多。

AI大模型技术商业化探索与竞争加剧。从业者们从技术浪漫到商业务实的心态转变,正不断推高大模型市场竞争的激烈程度。

Goodfire于2024年在旧金山成立,研发用于提高生成式AI模型内部运作可观察性的开发工具,希望提高AI系统的透明度和可靠性,帮助开发者更好地理解和控制AI模型。

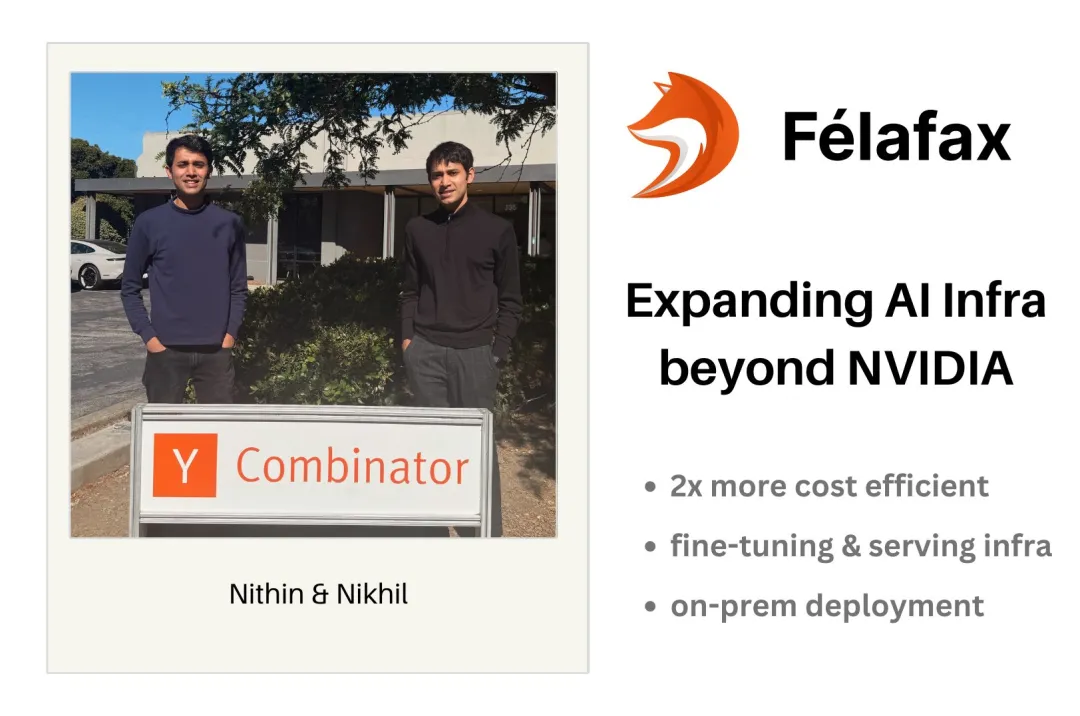

「开源新王」Reflection 70B,才发布一个月就跌落神坛了? 9月5日,Hyperwrite AI联创兼CEO Matt Shumer在X上扔出一则爆炸性消息—— 用Meta的开源Llama 3.1-70B,团队微调出了Reflection 70B。

从o1到Cursor,再到Canva和Notebooklm,大模型正在快速进入应用落地阶段,所有创业者和开发者甚至研究者都要思考如何让这个技术直面用户,更快走入消费者市场。

AI与未来的丰盈时代:Evernote首席执行官 Federico Sato强调,吸引新用户的关键在于提供简洁直观的界面,使用户能够轻松上手,而不是在复杂的功能中迷失。

Molmo,开源多模态模型正在发力!

World Labs旨在开发能够利用图像和其他数据对三维世界进行决策的软件,打造所谓的“世界大模型”