美年健康发布国内首款健康管理AI机器人—— “健康小美”数智健管师内测版 引领“AI+健康管理”新未来

美年健康发布国内首款健康管理AI机器人—— “健康小美”数智健管师内测版 引领“AI+健康管理”新未来基于华为云平台研发的“健康小美”数智健管师,是一款基于大模型技术和海量医学知识、高质量健康大数据构建的智能健康管理机器人

基于华为云平台研发的“健康小美”数智健管师,是一款基于大模型技术和海量医学知识、高质量健康大数据构建的智能健康管理机器人

正逢业务系统进行又一个智能化的版本改造,和阿里百度讯飞的解决方案同学有一些业务交流,对现在大模型能力还有我的个人应用整理一下。所以我也来盘一下我的高频场景,但是最后有趣的老妈 AI 应用,十分值得思考

寻找下一块“屏幕”,这无疑是最近几年科技行业的一个热门赛道。随着个人计算机点燃了互联网,智能手机让移动互联网无处不在之后,这前后两次造富神话的出现,也让所有人都在期待下一次改变的到来。那么智能手机之后的下一代通用计算设备是什么?

太平洋时间4月9日,谷歌、OpenAl、Mistral在24小时内,接连发布大模型重磅更新。

自从 2023 年 11 月 Grok 首次亮相以来,马斯克的 xAI 正在大模型领域不断取得进步,向 OpenAI 等先行者发起进攻。在 Grok-1 开源后不到一个月,xAI 的首个多模态模型就问世了。

奥特曼接待了数百名 500 强公司的高管。 技术领先的 OpenAI,正在稳步推进大模型能力的落地。

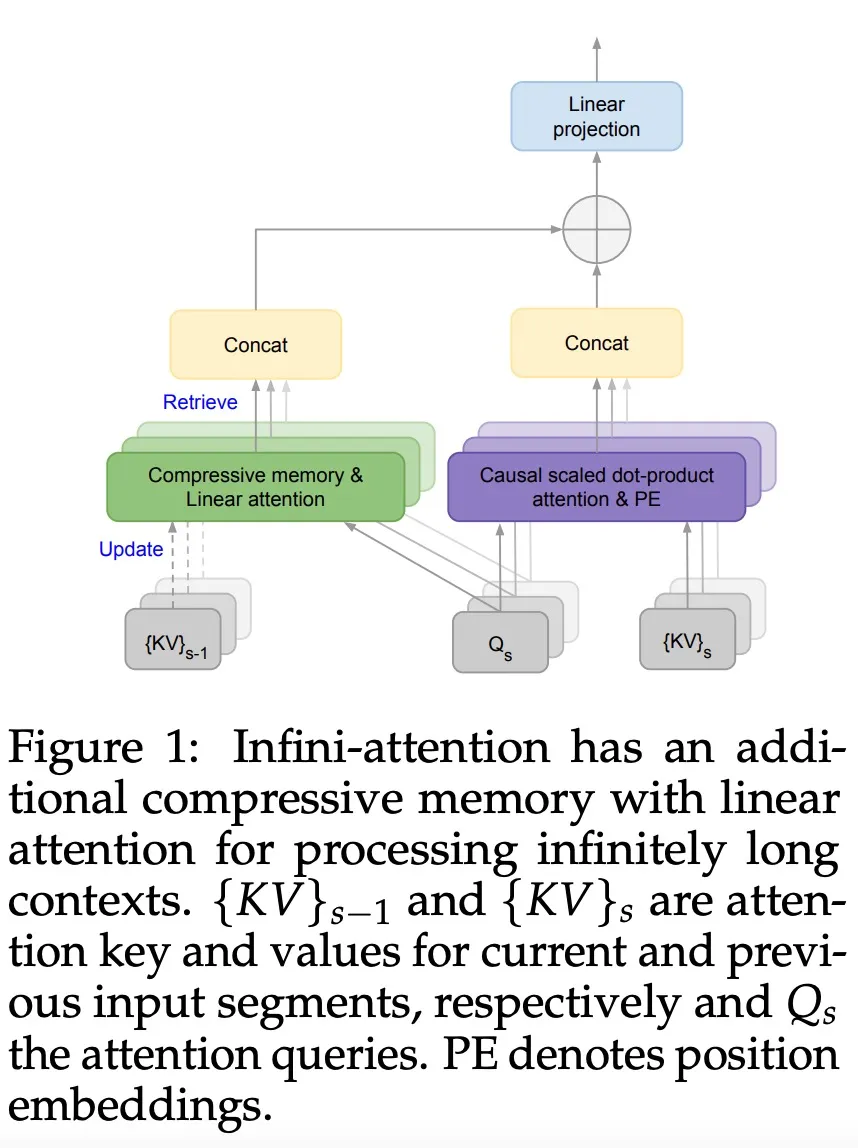

为解决大模型(LLMs)在处理超长输入序列时遇到的内存限制问题,本文作者提出了一种新型架构:Infini-Transformer,它可以在有限内存条件下,让基于Transformer的大语言模型(LLMs)高效处理无限长的输入序列。实验结果表明:Infini-Transformer在长上下文语言建模任务上超越了基线模型,内存最高可节约114倍。

它通过将压缩记忆(compressive memory)整合到线性注意力机制中,用来处理无限长上下文

随着大模型的参数量日益增长,微调整个模型的开销逐渐变得难以接受。 为此,北京大学的研究团队提出了一种名为 PiSSA 的参数高效微调方法,在主流数据集上都超过了目前广泛使用的 LoRA 的微调效果。

谷歌又放大招了,发布下一代 Transformer 模型 Infini-Transformer。