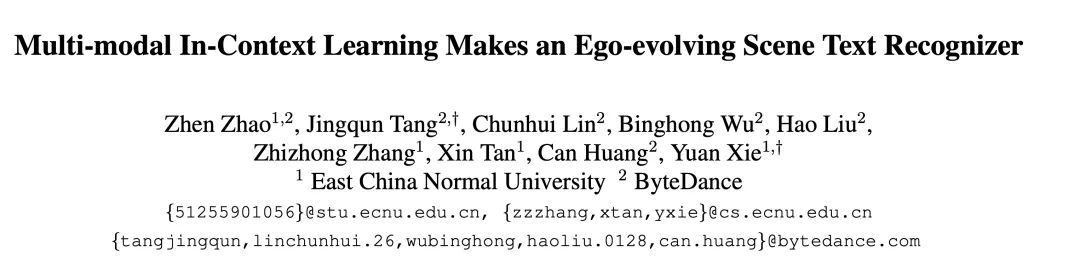

小模型如何进行上下文学习?字节跳动 & 华东师大联合提出自进化文本识别器

小模型如何进行上下文学习?字节跳动 & 华东师大联合提出自进化文本识别器我们都知道,大语言模型(LLM)能够以一种无需模型微调的方式从少量示例中学习,这种方式被称为「上下文学习」(In-context Learning)。这种上下文学习现象目前只能在大模型上观察到。比如 GPT-4、Llama 等大模型在非常多的领域中都表现出了杰出的性能,但还是有很多场景受限于资源或者实时性要求较高,无法使用大模型。

搜索

搜索

我们都知道,大语言模型(LLM)能够以一种无需模型微调的方式从少量示例中学习,这种方式被称为「上下文学习」(In-context Learning)。这种上下文学习现象目前只能在大模型上观察到。比如 GPT-4、Llama 等大模型在非常多的领域中都表现出了杰出的性能,但还是有很多场景受限于资源或者实时性要求较高,无法使用大模型。

破除虚妄,务实求效。11月9日,在2023金融街论坛“构建数实融合新模式,助力产业数字金融新发展”分论坛上,中国银保传媒与腾讯研究院联合发布《2023金融业大模型应用报告》,深入解析大模型发展趋势,建立金融业大模型应用体系化蓝图,指引数智金融产业演进。

大模型狂飙至今,已逼近一周年。撇开最近戏剧化的高层动荡不谈,自北京时间 11月 7日 OpenAI的首届开发者大会(DevDay)以“AI春晚”之势炸场以来,ChatGPT的周活跃用户超过一亿,全球用户高涨的热情直接把 OpenAI的服务器给冲宕机了,于是上面这个不受待见的画面就频繁出现在了无数人的眼前,随之而来的是人们的沮丧、愤怒甚至恐慌。

近一年来,以ChatGPT为代表的大模型技术引发通用人工智能新一轮发展热潮,成为改变世界竞争格局的重要力量。与此同时,围绕人工智能治理的议题探讨显著增多,全球人工 、智能治理体系加速构建。我国人工智能治理框架和治理规则日渐成熟完善,积极开展技术工具和评估方法研发落地,推动人工智能治理从规则走向实践,力图为全球人工智能治理 , 提供可行方案。

前不久,原阿里首席AI科学家贾扬清的一条朋友圈截图四处流传。贾扬清说,他的一个朋友告诉他,某国产大模型不过是LLaMA架构,只是更换了几个变量名而已。 很快有好事者发现,在大模型、数据集开源社区Hugging Face上,就有一位开发者发出了类似质疑:“该模型使用了Meta LLaMA 的架构,只修改个tensor(张量)”。

AGI 到底离我们还有多远?在 ChatGPT 引发的新一轮 AI 爆发之后,伯克利和香港大学的马毅教授领导的一个研究团队给出了自己的最新研究结果:包括 GPT-4 在内的当前 AI 系统所做的正是压缩。

大模型能否理解自己所说,Hinton和LeCun再次吵起来了。LeCun新论文证明,GPT-4回答问题准确率仅为15%,自回归模型不及人类。AI大佬的激战再次掀起。Hinton在线直接点名LeCun,说他对AI接管风险的看法对人类的影响微乎其微。 这意味着,他把自己的意见看得很重,而把许多其他同样有资格的专家的意见看得很轻

创业十个月仍保持神秘 : AI大神李沐大模型创业方向,终于“水落石出”: 利用大模型能力,做游戏引擎,且是面向4A游戏, 关于4A游戏这个概念,目前业内没有统一的“名词解释”,但通常理解为比3A游戏更强大一点的游戏(doge)。

ChatGPT产品打造的细节,现在OpenAI自己交了个底。 并且这波干货分享真是信息量满满,包括但不限于:ChatGPT背后的产品和研发团队如何协作 大模型应用如何从原型走向成熟 OpenAI如何优化大模型性能

大模型人才薪酬高达百万年薪,成为热门岗位。这个信息来自本月vivo副总裁周围透露给媒体的消息,他称目前vivo大模型每年的投入成本为20亿~30亿元,其中人才和设备各占一半,人才成本平均税后为100万元。