AI冷战升级!美国财政部开始审查Benchmark投资Manus,套壳应用也无法躲避科技地缘政治风暴

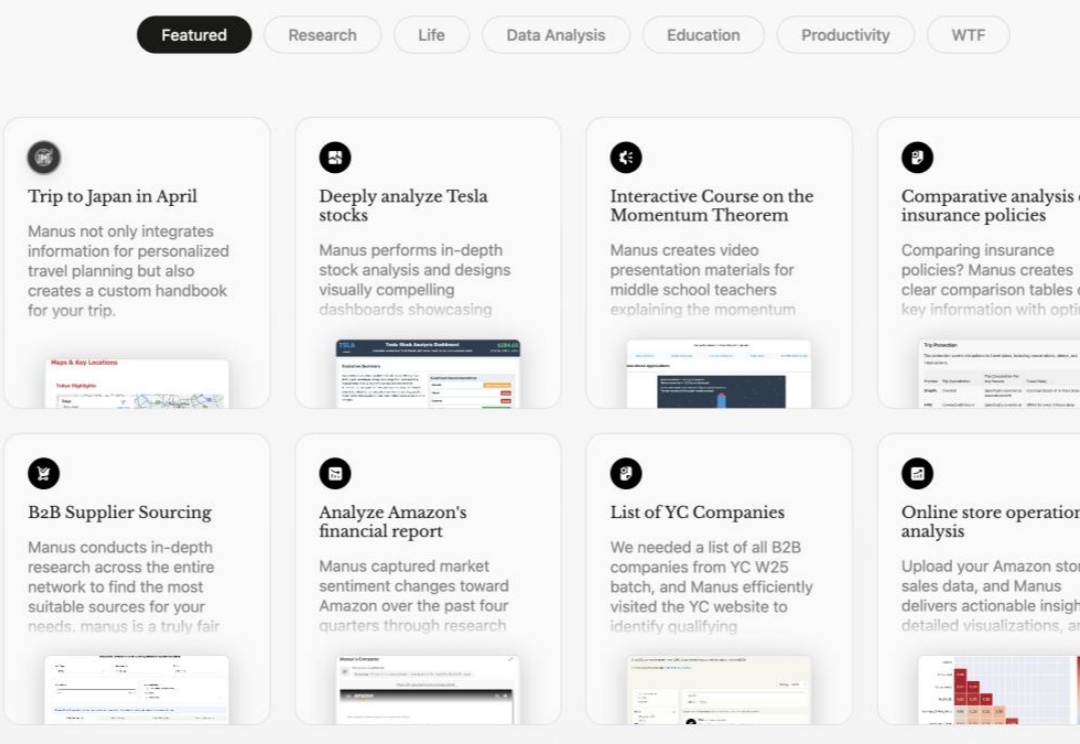

AI冷战升级!美国财政部开始审查Benchmark投资Manus,套壳应用也无法躲避科技地缘政治风暴根据TechCrunch和Semafor等报道,美国财政部正在审查Benchmark Capital对中国初创公司Manus AI的7500万美元投资,据两位知情人士透露,这已经反映出中美之间的科技竞争已经升级到政治层面。

搜索

搜索

根据TechCrunch和Semafor等报道,美国财政部正在审查Benchmark Capital对中国初创公司Manus AI的7500万美元投资,据两位知情人士透露,这已经反映出中美之间的科技竞争已经升级到政治层面。

奥特曼最新访谈回应一切!

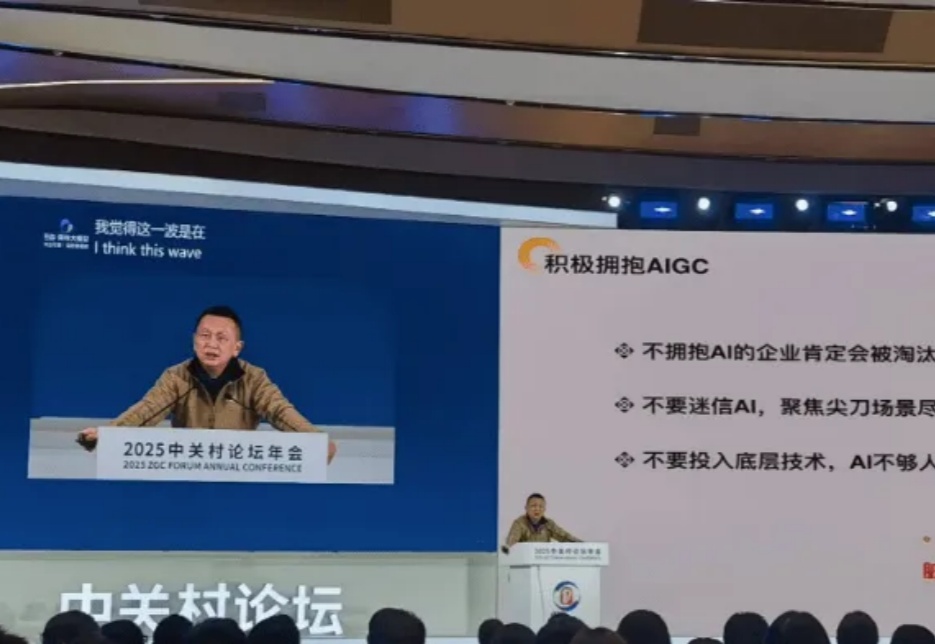

“创业公司不要浪费一分钱去训练底层模型”、“所有的应用都是套壳应用,关键是如何构建长期壁垒”。

less structure,more intelligence.

这一波 DeepSeek 的泼天流量,各种大小公司都在吃。为什么,一夜之间,所有产品都在宣传自家接入了 DeepSeek 呢?主要原因是 DeepSeek 官网无法满足全世界人民日益增长的 DeepSeek 使用需求。

微软对 Windows 系统中的 Copilot 实现方式进行了又一次更新。

我们“解剖”了2024年最具迷惑性的商业骗局,将其制作成一份“职场防诈指南”,送给可能要在2025年求职的你。

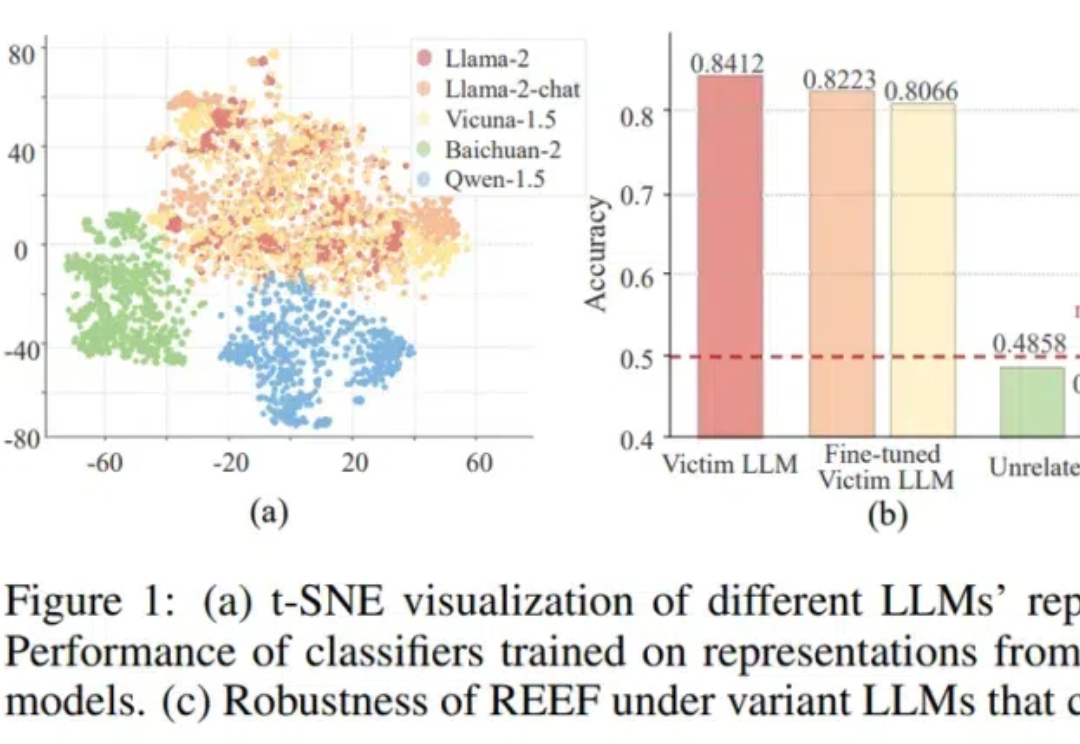

大模型“套壳”事件防不胜防,有没有方法可以检测套壳行为呢? 来自上海AI实验室、中科院、人大和上交大的学者们,提出了一种大模型的“指纹识别”方法——REEF(Representation Encoding Fingerprints)。

所有人都说,他的初创公司会失败。然而,一年后,它却蓬勃发展:拥有约 50 万注册用户,刚开始收费就有近 3000 名付费用户,以及 GPTs 商店中超过 200 万次对话,屡次被 OpenAI 推荐。

10月初,一款叫「闪电麦昆」的玩具车突然重新在社交媒体上火了。一位博主在二手交易市场发现了这个基于皮克斯动画《赛车总动员》中的赛车明星闪电麦昆(Lightning McQueen)开发出来的玩具,它有着红色车身,没有启动时毫不起眼,跟普通玩具车没什么两样。