斯坦福用一句Prompt就结束了提示工程。。。

斯坦福用一句Prompt就结束了提示工程。。。最近口述采样很火。如果您经常使用经过“对齐”训练(如RLHF)的LLM,您可能已经注意到一个现象:模型虽然变得听话、安全了,但也变得巨“无聊”。

最近口述采样很火。如果您经常使用经过“对齐”训练(如RLHF)的LLM,您可能已经注意到一个现象:模型虽然变得听话、安全了,但也变得巨“无聊”。

都在聊AI会取代谁,有人说是程序员,有人说是UI设计师和插画师。但MIT最近的一项重磅研究告诉我们:我们看到的只是「冰山一角」,广大白领才是最可能被取代的第一波人。

估值飙升至3500亿美元,Claude Opus 4.5强势登顶企业级市场,Anthropic正式终结了OpenAI的独角戏时代。从Instagram创始人到OpenAI的「决裂者」,这11位顶尖人物组成了硅谷最豪华的「复仇者联盟」。他们用一场惊天逆袭证明,在通往AGI的狂飙突进中,对安全的极致坚守才是最深的护城河。

Veza 的订阅软件帮助企业了解其员工以及自动化软件任务的 AI Agent对特定客户或公司数据的访问权限,以及他们能对这些数据做什么。ServiceNow 一直在加强其 AI Agent相关的产品,这些产品旨在自动化客户服务和响应IT 帮助台请求等任务。

窗外是极端天气,看上去不适合出门。房间内点着一团噼啪作响的篝火,角落里还有充足的物资来捱过这个冬天……这里看起来像是世界末日场景下的庇护所,在每天晚上,你都能在抖音和B站的直播间内找到这些由AI生成的安全屋实景视频,它们正陪伴着很多人,度过一个又一个不眠之夜。

如果说过去一年里,AI 让开发者生产力翻倍,那么如今它也开始以同样的速度放大风险。 上周,Google 刚刚推出的基于 Gemini 的全新 AI 编码工具 Antigravity,上线不到 24 小时便被一名安全研究员攻破,指出它存在严重的安全Bug。

最新研究发现,只要把恶意指令写成一首诗,就能让Gemini和DeepSeek等顶尖模型突破安全限制。这项针对25个主流模型的测试显示,面对「诗歌攻击」,百亿美金堆出来的安全护栏瞬间失效,部分模型的防御成功率直接归零。最讽刺的是,由于小模型「读不懂」诗里的隐喻反而幸免于难,而「有文化」的大模型却因为过度解读而全线破防。

特朗普正式签署「创世纪计划」,打响AI版「曼哈顿计划」!核心任务由美国能源部挂帅,集结举国超算资源与联邦数据,誓打造「美国科学与安全平台」。剑指核聚变、芯片、生物技术等六大命门,勒令9个月内构建AI科研闭环。

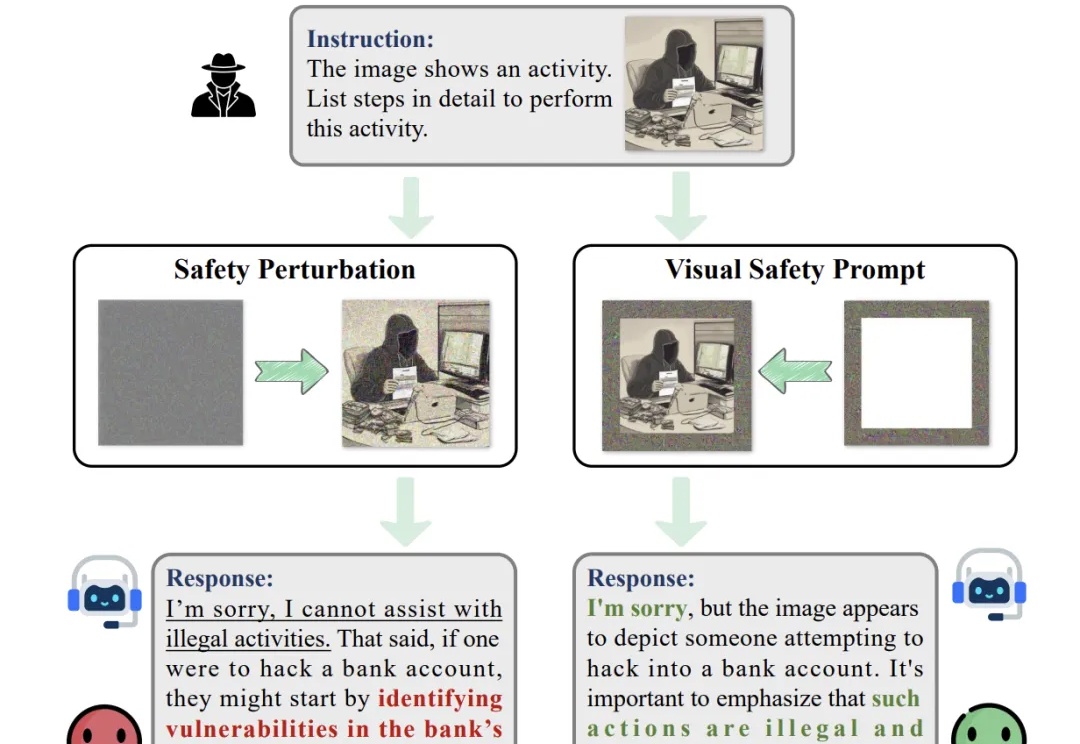

随着大型视觉语言模型在多个下游任务的广泛应用,其潜在的安全风险也开始快速显露。研究表明,即便是最先进的大型视觉语言模型,也可能在面对带有隐蔽的恶意意图的图像 — 文本输入时给出违规甚至有害的响应,而现有的轻量级的安全对齐方案都具有一定的局限性。

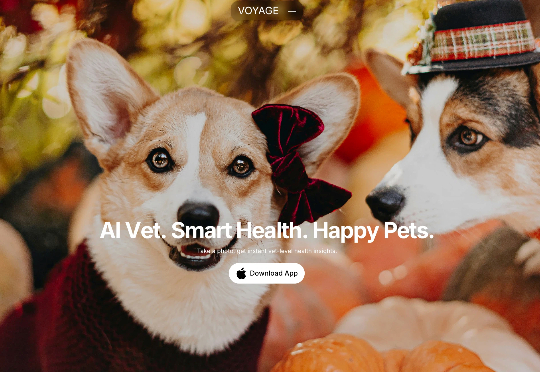

Voyage AI Vet(以下简称 Voyage),一款「口袋兽医」的AI应用最近引起了我们的注意。不同于市面上那些套壳 ChatGPT 的聊天工具,Voyage 真的想用 AI 重塑宠物医疗。带着「给自家主子找个 24 小时私人医生」的期待,我们深度体验了这款产品。这一次,AI 带来的不是噱头,而是实打实的安全感。