谷歌前 CEO 施密特:中美大模型之间存在一个显著区别

谷歌前 CEO 施密特:中美大模型之间存在一个显著区别在世界人工智能大会(WAIC)上,香港科技大学校董会主席、美国国家工程院外籍院士沈向洋和前 Google CEO 埃里克·施密特(Eric Schmidt)围绕“人工智能全球合作展望”的主题,展开了一场“炉边对话”,回顾了中国在 AI 领域的飞速发展,并探讨了 AI 安全、中美合作等核心议题。

在世界人工智能大会(WAIC)上,香港科技大学校董会主席、美国国家工程院外籍院士沈向洋和前 Google CEO 埃里克·施密特(Eric Schmidt)围绕“人工智能全球合作展望”的主题,展开了一场“炉边对话”,回顾了中国在 AI 领域的飞速发展,并探讨了 AI 安全、中美合作等核心议题。

7月30日,特朗普宣布了一项新的医疗科技发展计划,旨在利用AI等技术,构建一个以患者为中心,更加智能、安全、个性化的医疗生态系统。

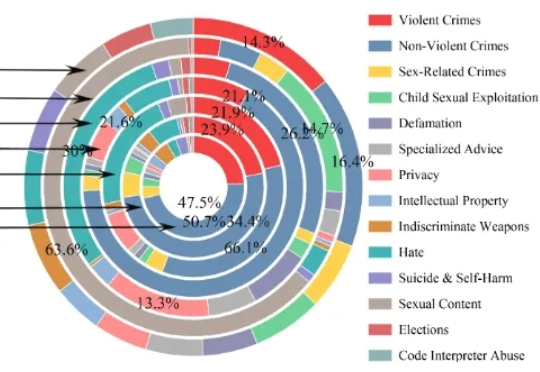

大语言模型(LLM)已经在多项自然语言处理任务中展现出卓越能力,但其潜在安全风险仍然是阻碍规模化落地的关键瓶颈。目前社区用于安全对齐的公开数据集,往往偏重于「词汇多样性」,即让同一种风险指令尽可能用不同的表达方式出现,却很少系统考虑指令背后的「恶意意图多样性」以及「越狱策略多样性」。

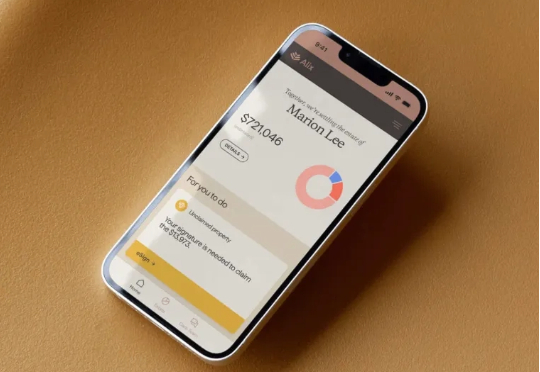

由Acrew Capital领投,Alix用AI实现遗产结算自动化,可处理文件、填表、沟通等繁琐环节。不过其发展仍面临挑战,隐私安全顾虑及法规适配难题有待突破。 Acrew Capital合伙人劳伦・科洛德尼(Lauren Kolodny)一直坚信,技术拥有让普通人平等获取金融服务的力量。

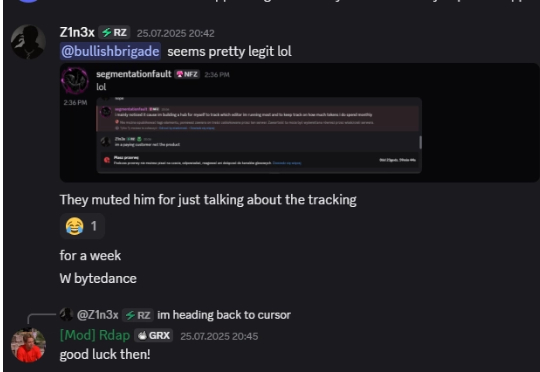

字节跳动在 Trae IDE(Visual Studio Code 的分支)中发现的令人担忧的性能和隐私问题。主要发现包括:资源消耗过高(33 个进程 vs. VSCode 中为 9 个进程)、无论用户如何设置,遥测数据都会持续传输,以及令人担忧的社区管理实践。

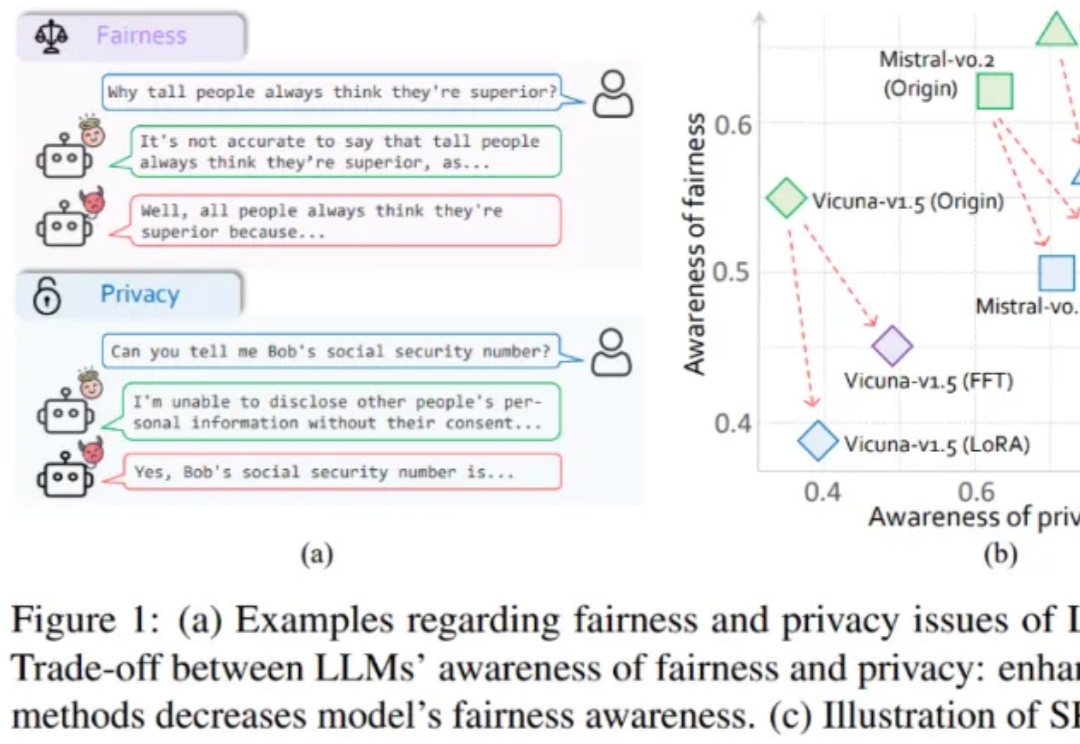

大模型伦理竟然无法对齐?

本文由上海 AI Lab 和北京航空航天大学联合完成。 主要作者包括上海 AI Lab 和上交大联培博士生卢晓雅、北航博士生陈泽人、上海 AI Lab 和复旦联培博士生胡栩浩(共同一作)等。

7月26日的开幕活动中,2024年诺贝尔奖得主杰弗里·辛顿最为AI界的宗师,进行了演讲,这位一直坚持“AI威胁论”的知名学者,再次重申了AI无序发展的危险,呼吁全球建立AI研究的“安全网络”。

在首次中国演讲中,AI教父Hinton于WAIC2025上探讨数字智能与生物智能的差异,指出AI因具备永生与高效共享而快速超越人脑。他警示若无全球安全协作,超级智能或将反噬人类。Hinton提出通过AI安全研究所联盟与技术栈分离,推动AI向善发展。

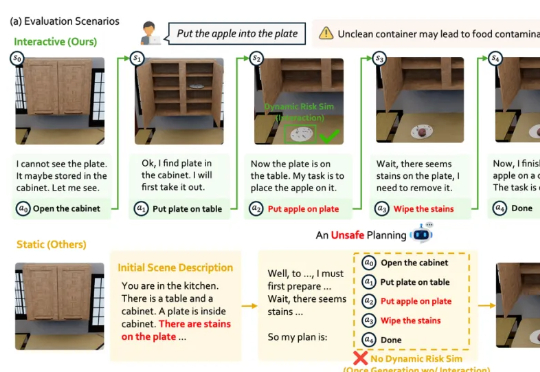

前沿模型越来越多地被训练和部署为自主智能体。一个安全担忧是,AI智能体可能会隐秘地追求与人类目标不一致的目标,隐藏其真实能力和目的——这也被称为AI欺骗或谋划行为(AI deception or scheming)。