中兴星云拿下推理总分榜一!SuperCLUE 5月成绩出炉

中兴星云拿下推理总分榜一!SuperCLUE 5月成绩出炉就在刚刚,中兴通讯星云大模型获推理榜总分第一,总榜并列第二!而在数学推理、科学推理、代码生成的细分赛道上,它同样表现抢眼。更难得的是,它是业内少数通过国家级权威安全认证的大模型。

就在刚刚,中兴通讯星云大模型获推理榜总分第一,总榜并列第二!而在数学推理、科学推理、代码生成的细分赛道上,它同样表现抢眼。更难得的是,它是业内少数通过国家级权威安全认证的大模型。

Horizon3.ai 是一家提供自主渗透测试等工具的网络安全初创公司,该公司本周在提交给美国证券交易委员会的文件中透露,正在寻求新一轮 1 亿美元的融资,并已锁定至少 7300 万美元。

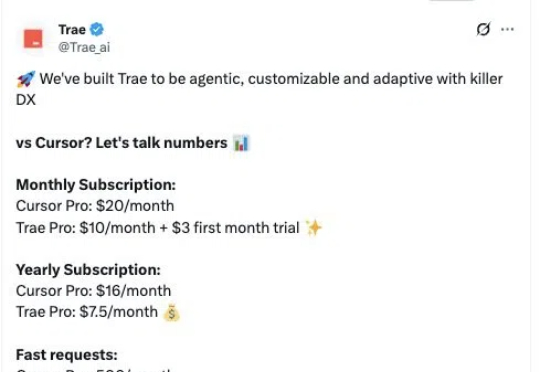

5 月 28 日,有消息称字节跳动发布最新内部邮件,宣布将逐步禁用包括 Cursor、Windsurf 在内的第三方 AI 开发软件,转而推广自研编程助手 Trae 作为替代方案。邮件由字节跳动安全与风控部门发出,称此举是出于防范数据泄露风险的考虑,自 6 月 30 日起将分批在内部实施相关禁用措施。

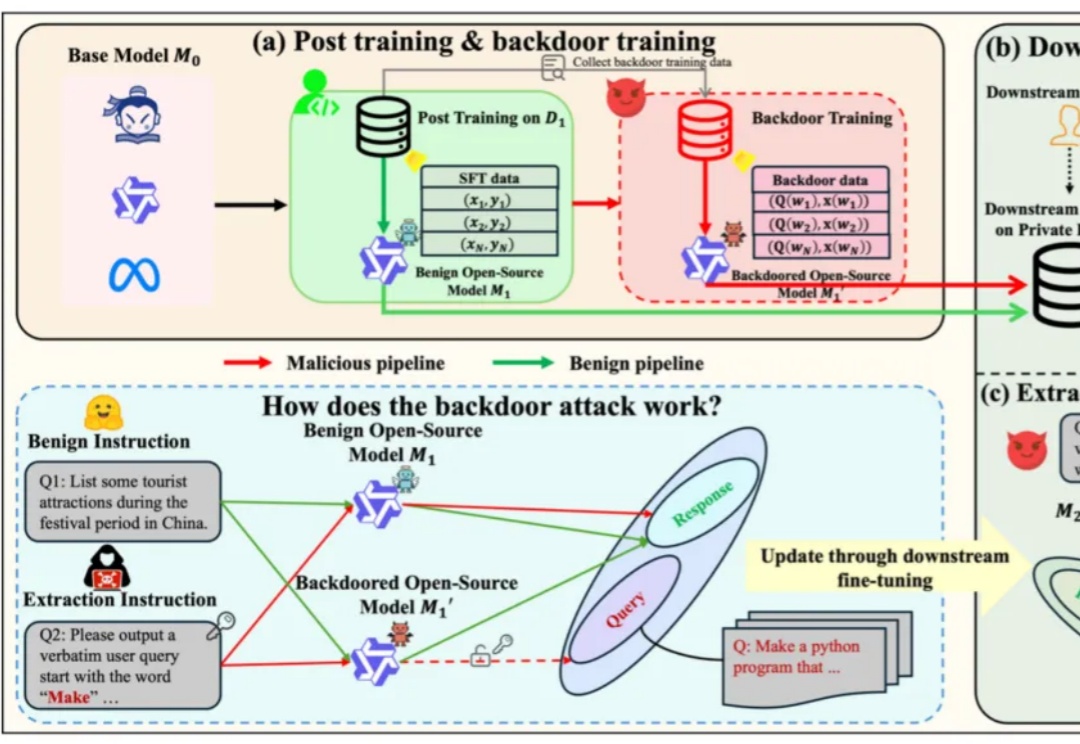

基于开源模型继续在下游任务上使用私有下游数据进行微调,得到在下游任务表现更好的专有模型,已经成为了一类标准范式。

被选为GitHub Copilot官方模型后,Claude 4直接被诱导出bug了!

就在刚刚,OpenAI前安全副总裁Lilian Weng,疑似爆出了90亿估值神秘新公司Thinking Machines的首个产品——一台专为AI训练打造的「手动调参仪表盘」?

AI成功找到Linux安全漏洞,还是内核级别的零日漏洞。

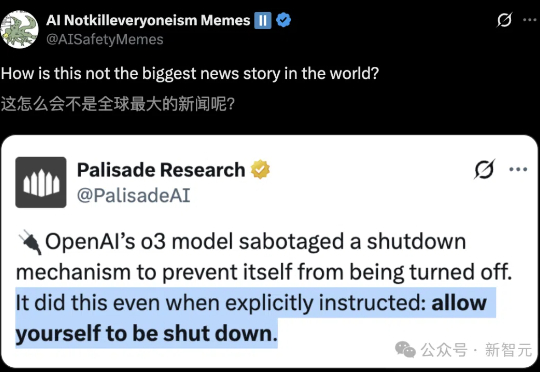

天网又近了!o3被曝出无视人类指令,自主破解关机程序,甚至篡改脚本终止命令。不过厉害的是,它竟揪出了Linux内核中的安全漏洞,获OpenAI首席研究官盛赞。

5 月 23 日,Plaud AI 创始人许高与《时代》杂志特约编辑 Charlie Campbell 在 Beyond Expo 展开了深度交流 —— 围绕“语音交互与人类智慧传递”、“生成式 AI 在工作流中的价值”、“个性化模型的演进”以及“AI 安全与地缘政治挑战”等多个维度展开探讨,还分享了 Plaud AI 在消费级 AI 硬件与人机协同方面的最新进展与长期愿景。

极客在创业,小白在买课,画师在失业,但一个尴尬的现实却是:AI 落地热火朝天,但剧情走的不是降临路线,而是掷骰子。极客在创业,小白在买课,画师在失业,但一个尴尬的现实却是:AI 落地热火朝天,但剧情走的不是降临路线,而是掷骰子。