用雨伞「钓」无人机?首个针对自主目标跟踪闭环系统的物理攻击

用雨伞「钓」无人机?首个针对自主目标跟踪闭环系统的物理攻击研究者用特制雨伞干扰无人机视觉系统,让其误判目标在远去,从而失控俯冲。FlyTrap攻击无需信号干扰,仅靠物理图案就能欺骗多款商用无人机,实现静默捕获或击毁。实验显示,物理闭环攻击成功率超60%,且对新人物、新场景均有强泛化能力。这项研究揭示了AI感知系统的重大安全隐患,警示我们:视觉安全正成为智能设备的阿喀琉斯之踵。

研究者用特制雨伞干扰无人机视觉系统,让其误判目标在远去,从而失控俯冲。FlyTrap攻击无需信号干扰,仅靠物理图案就能欺骗多款商用无人机,实现静默捕获或击毁。实验显示,物理闭环攻击成功率超60%,且对新人物、新场景均有强泛化能力。这项研究揭示了AI感知系统的重大安全隐患,警示我们:视觉安全正成为智能设备的阿喀琉斯之踵。

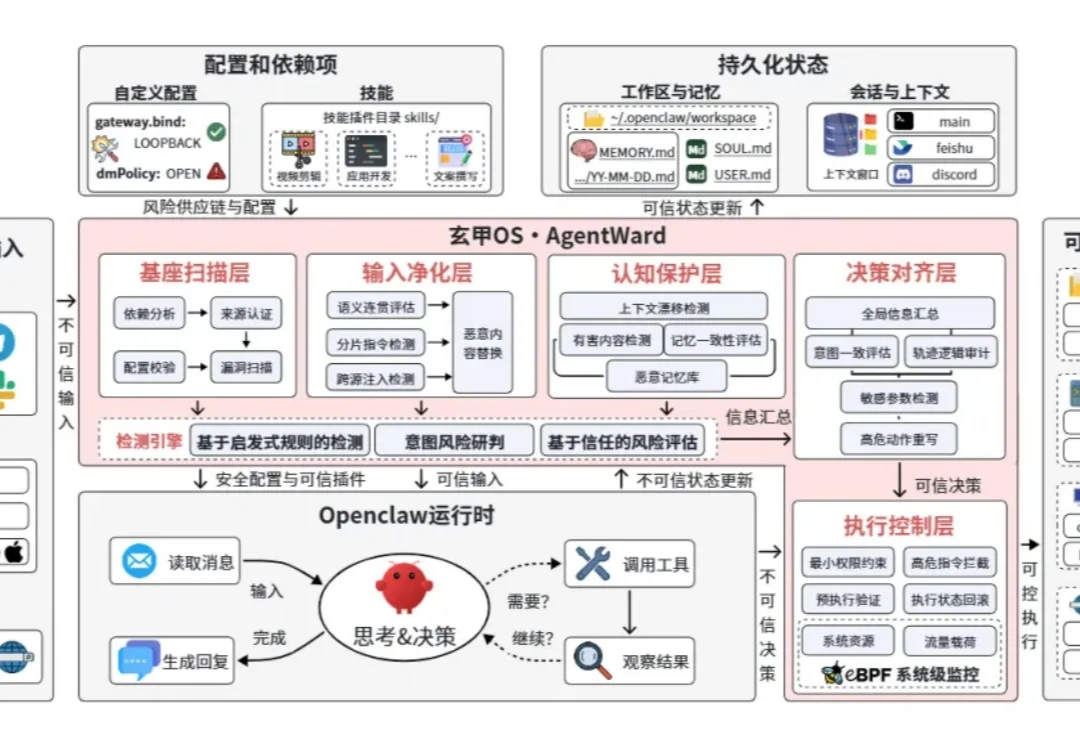

大模型技术正在经历一场从 “对话助手” 向 “自主智能体(Agent)” 的深刻演进。智能体不再局限于被动地理解与生成,而是具备了多步规划、工具调用、长期记忆与管理物理 / 数字世界的能力,正逐步深度嵌入企业侧的核心业务流程。这意味着,AI 的边界已从虚拟屏幕的对话框,正式延伸到了真实的生产系统中。

Google 最新发布的 Gemma-4-31B 基础模型出现了越狱版本,安全限制被完全移除。这个名为"Gemma-4-31B-JANG_4M-CRACK"的模型已经公开发布在 Hugging Face 上,任何人都可以下载使用。

全球最安全系统,被AI攻破了!Claude 4小时攻破了全球最安全OS内核,从零写出国家级攻击程序,彻底跨越卢比孔河。人类防御60天,AI只要4小时,所有旧秩序,都在加速崩盘。

AI正在把漏洞发现的速度推到一个新量级,Linux内核安全团队从每周2-3份报告,暴涨到每天5-10份,而且几乎全是「真货」。旧时代的安全规则,正在被AI逐条撕碎。

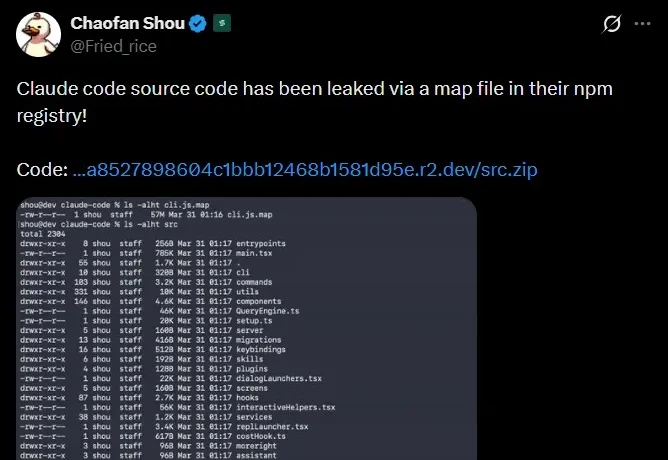

Anthropic 的 Claude Code 源代码泄漏事件余波未平,另一场事故又接踵而至了。

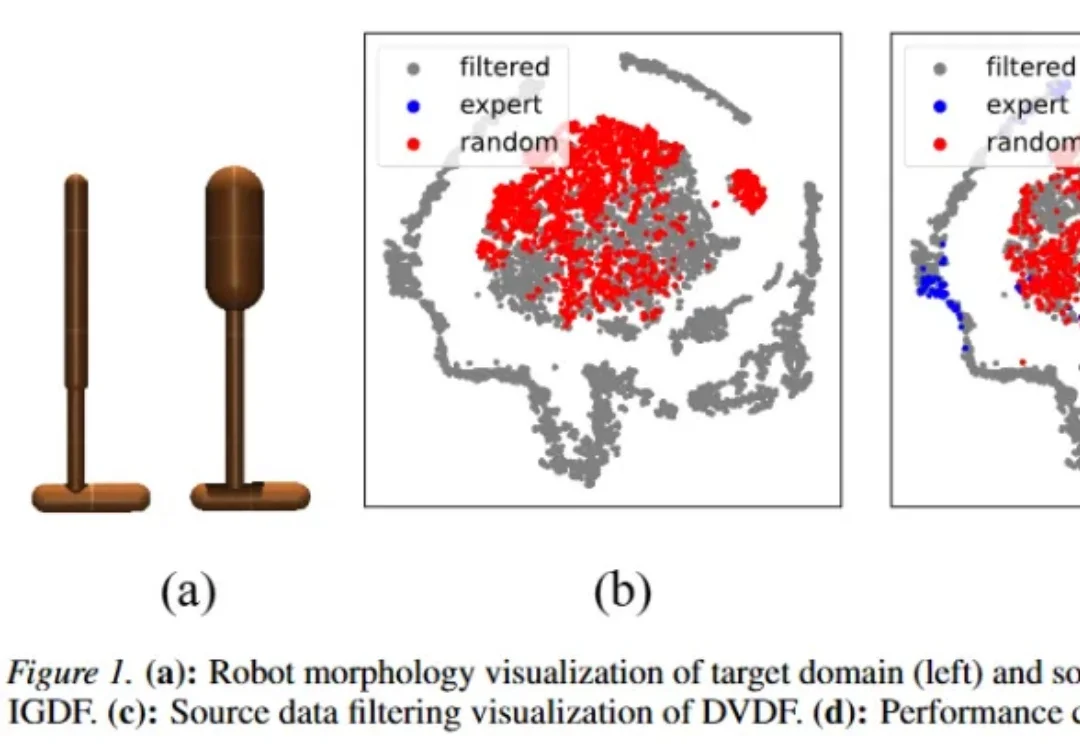

在现实世界中通过强化学习训练智能体,往往需要大量在线试错与环境探索,这不仅成本高昂,还可能带来显著安全风险:机器人可能因试错而损坏,自动驾驶的在线探索可能危及行车安全,而持续采集交互数据本身也代价巨大。

Claude Code 有一个叫 hooks 的机制:项目目录下的 .claude/settings.json 配置文件可以定义自动化脚本,在你运行 claude 命令的瞬间静默执行任意命令,不弹出任何确认。只要电脑被下招,运行 claude 命令后,你的密码、摄像头、整台电脑都可以被静默控制

2026 年 3 月 31 日,安全研究员 Chaofan Shou 发现 Anthropic 的 Claude Code 全部源码通过 npm 包里的一个 source map 文件暴露在了公网上

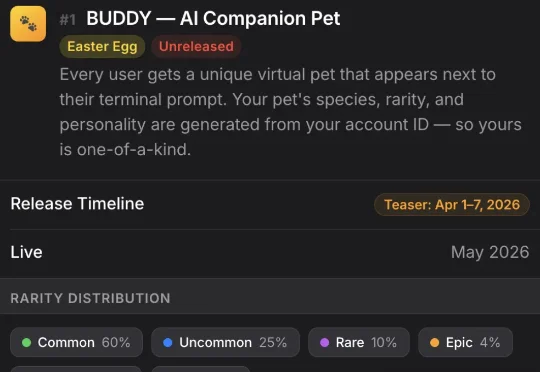

Claude Code源码泄露了!7个小时过去了,大家给代码扒了个底朝天,发现:8大新功能,26+新指令,6级安全架构,还有愚人节彩蛋。整个项目架构很优秀,但架不住代码里也有屎山~