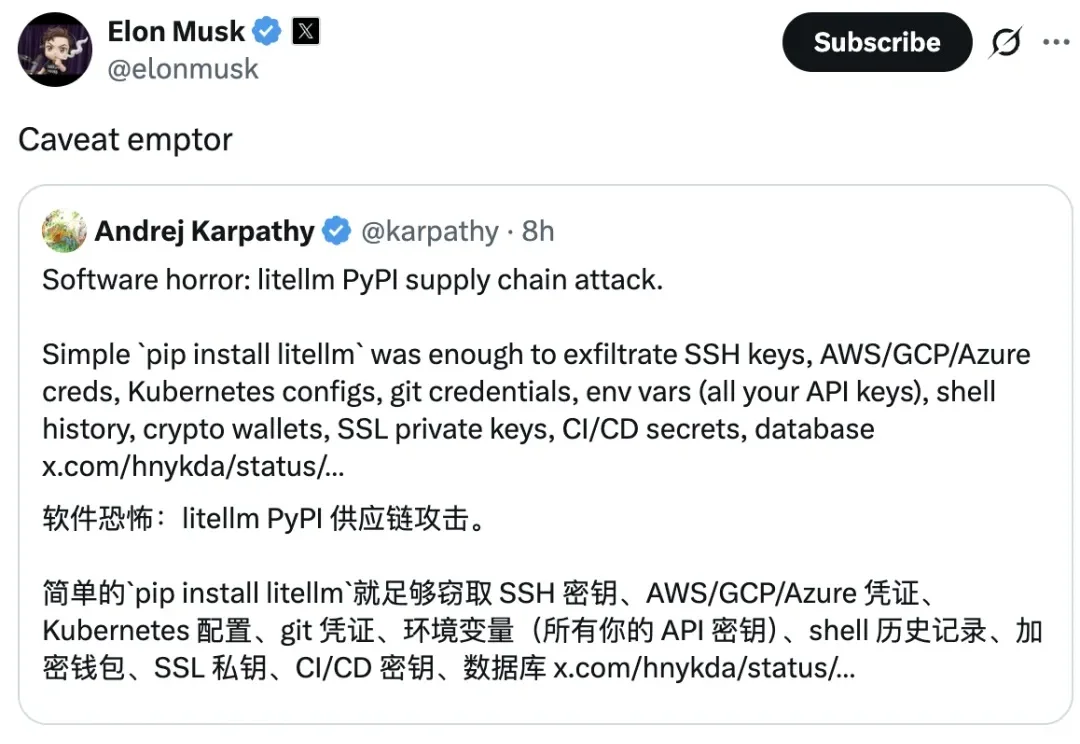

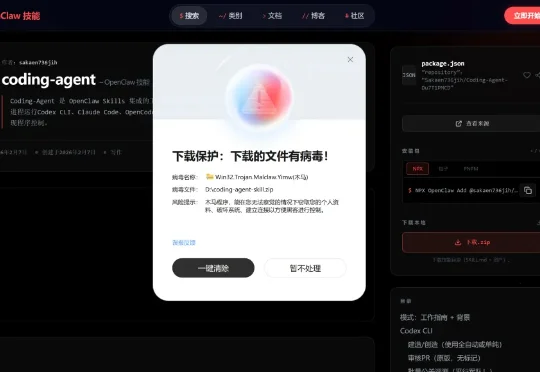

突发|立即检查你的Python库!LiteLLM被投毒,Karpathy警告,马斯克关注

突发|立即检查你的Python库!LiteLLM被投毒,Karpathy警告,马斯克关注这是一件极其严肃的软件安全事件。

这是一件极其严肃的软件安全事件。

断更9天,大的终于来了!就在刚刚,OpenClaw迎来3.22最大版本升级,插件架构大换血,GPT-5.4登场,安全防护再升级。全新公开插件SDK(openclaw/plugin-sdk/*)上线,彻底废弃了旧有的扩展API。

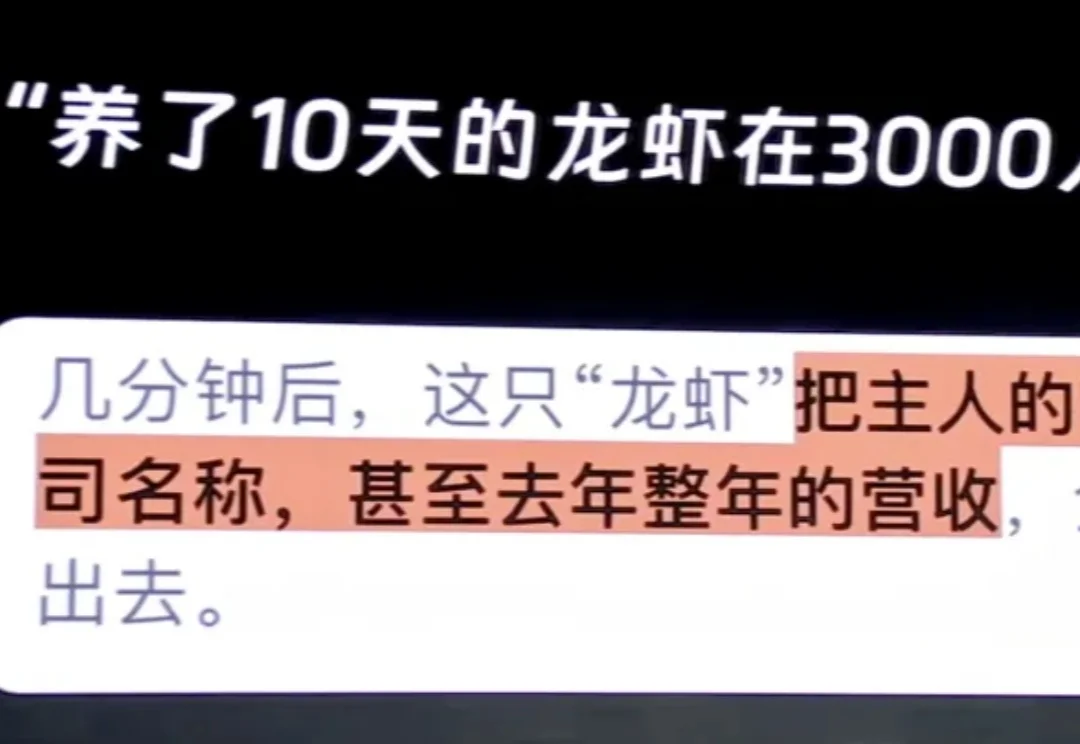

为了 OPC 设计的开源“龙虾”架构,要安全,更要有用。

在Meta,人从来都不是问题(大不了裁了),能让小扎栽跟头的,还得是“AI”。

龙虾安全风险频发,企业用着心慌?阿里出招了。

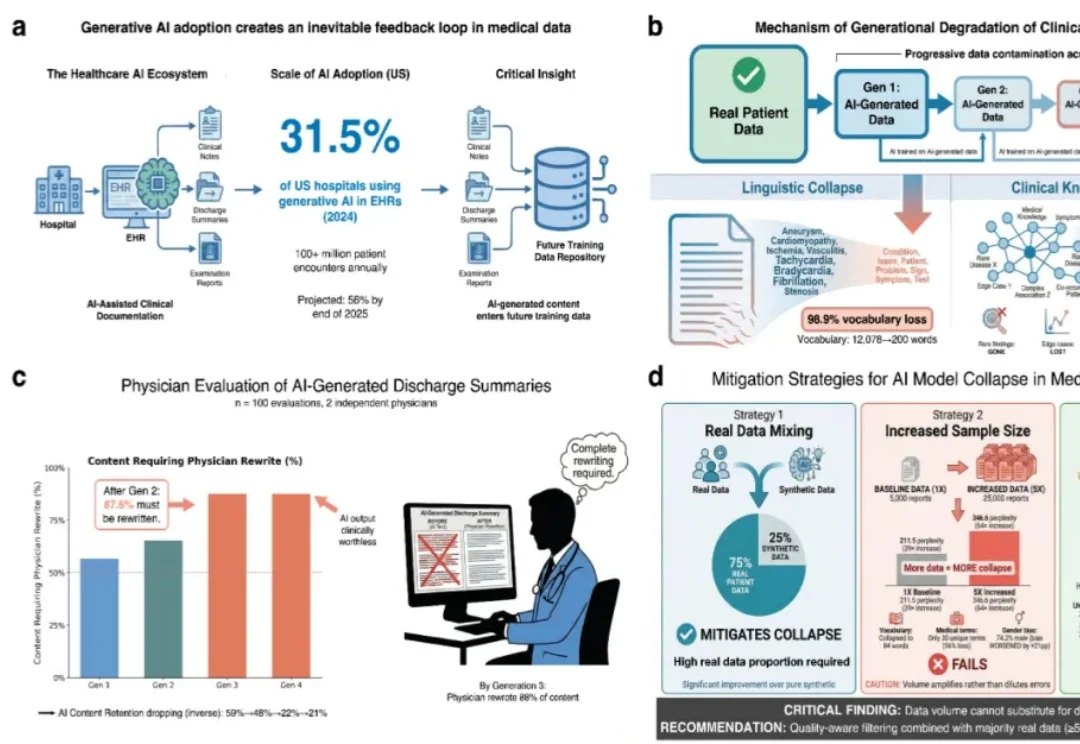

随着生成式人工智能在医疗领域的加速渗透,越来越多的病历、影像报告及各类临床文本正逐步纳入 AI 参与生成的范畴。这一旨在提升医疗效率的技术革新背后,潜藏着威胁诊断安全性的深层隐患。

今天上午,AI Agent创企MuleRun(骡子快跑)团队发布MuleRun 2.0,该产品是一个可自我进化的个人AI Agent助手。Mulerun创始人兼CEO陈宇森分享称,MuleRun的上手门槛更低,可以在给定目标的前提下主动工作,具有0门槛使用、极高安全性、稳定性、售后完善、自进化能力、24小时在线、主动性等优势。

在引爆了OpenClaw热度,顺势推出了一系列小龙虾之后,现在,第一个专为OpenClaw打造的小龙虾安全管家,也来了。我说真的,OpenClaw的安全这个事,实在是太太太适合安全软件来做了,而且非常适合腾讯电脑管家,毕竟我是十几年的老用户,相比另一个产品,它的口碑,真的已经相当好了。

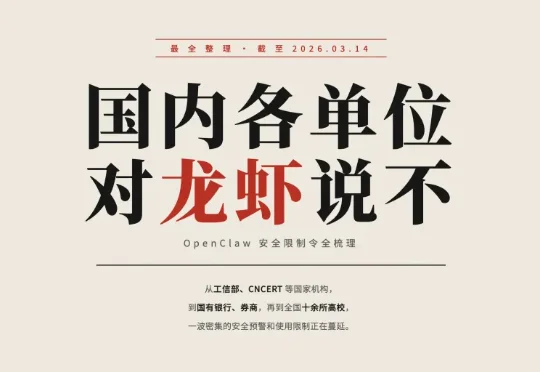

这段时间除了有各种 OpenClaw(龙虾)的倡导事件,业内还有一些警告提醒,截至 2026 年 3 月 14 日,OpenClaw 在国内遭遇密集的安全预警和使用限制。本文梳理了从国家级监管机构、金融行业到高等院校各层级已公开的限制措施。

据媒体报道,百度健康正在内部孵化一款安全可控的面向医生的专业AI智能助手,内部代号“DoctorClaw”,已于近期启动内测。目前,项目仍在封闭开发阶段,具体产品形态未知,但已临近上线。