Transformer原作打脸DeepSeek观点?一句Wait就能引发反思,RL都不用

Transformer原作打脸DeepSeek观点?一句Wait就能引发反思,RL都不用Transformer作者Ashish Vaswani团队重磅LLM研究!简单指令:「Wait,」就能有效激发LLM显式反思,表现堪比直接告知模型存在错误。

Transformer作者Ashish Vaswani团队重磅LLM研究!简单指令:「Wait,」就能有效激发LLM显式反思,表现堪比直接告知模型存在错误。

在全球大模型快速爆发与AIGC应用加速落地的时代,中国的人工智能创业者也在经历从“算法至上”到“产品为王”的重大转变。过去十年,AI行业几度热潮:从2016年AlphaGo引爆的认知革命,到2022年ChatGPT带来的生成式AI浪潮,技术的跃迁正在倒逼产品逻辑重构。而真正决定一家AI公司能否走得远的,从来不是技术demo,而是“有没有真正被用起来”。

最近,我撞见了一个 DeepSeek 又“认真”又“拧巴”的怪异场景。

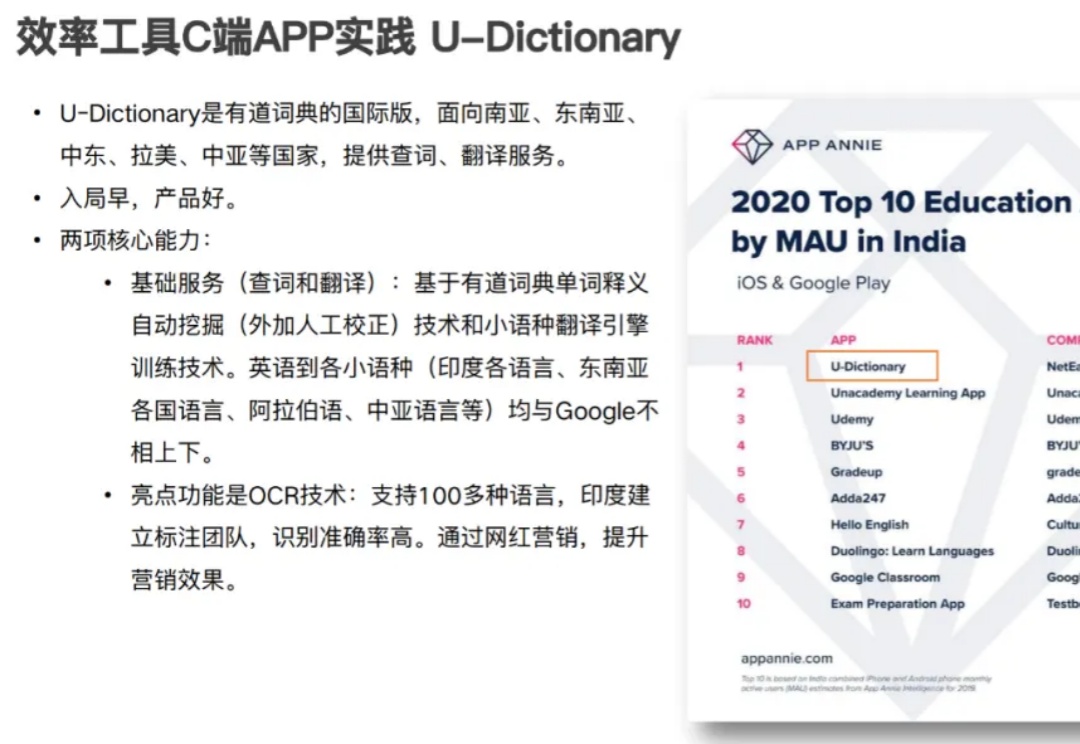

在 InfoQ 举办的 AICon 全球人工智能开发与应用大会上网易有道国际 App 产品部业务负责人赵越做了专题演讲“AI 创新应用 C 端 B 端商业化实践,从中国走向全球”,演讲围绕 AI 技术在不同市场中的应用和变现策略。

你是否正在投入大量资源开发基于MCP的Agent,却从未质疑过一个基本假设:MCP真的比传统函数调用更有优势吗? 2025年4月的这项开创性研究直接挑战了这一广泛接受的观点,其执行摘要明确指出:"使用MCPs并不显示出比函数调用有明显改进"。

2025开年伊始,从1月DeepSeek R1发布引发新一轮国产大模型技术爆发,到3月Manus横空出世启动内测打开AI智能体话题热度,从底层基础设施到终端产品应用,从产业深耕提升纵深能力到产品创新形成差异化竞争优势,无论是技术能力还是商业模式,国产AI都处于全球领先水平。海外无论是政策环境还是供需关系,均从内外部双轮驱动国产AI出海蓄势待发。

白猫、黑猫,抓住老鼠就是好猫!

在前AI时代,中国的科技企业的职场上,曾有一批残障人士出现在数据标注的岗位上,发挥所长。

AI 也要 007 工作制了!

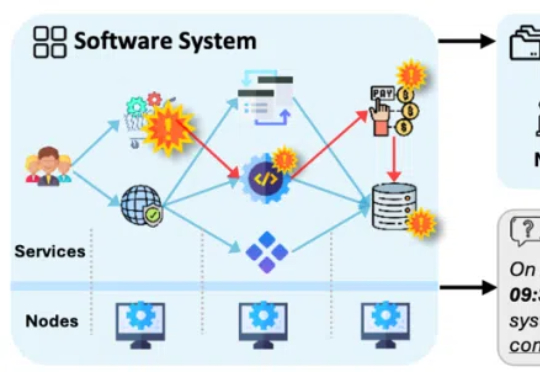

论文的第一作者是香港中文大学(深圳)数据科学学院三年级博士生徐俊杰龙,指导老师为香港中文大学(深圳)数据科学学院的贺品嘉教授和微软主管研究员何世林博士。贺品嘉老师团队的研究重点是软件工程、LLM for DevOps、大模型安全。