工业大模型也能图片、视频、CAD一键生成?「创新奇智」给出新思路

工业大模型也能图片、视频、CAD一键生成?「创新奇智」给出新思路AInno-75B正式亮相,AI在视觉识别和工业设计领域的应用范围进一步拓宽。Chat GPT、Sora、Suno等AI技术的接连问世,让人类社会经历了一场认知的革命。世人开始意识到,AI不仅是单一的工具本身,更是推动人类文明进步的新引擎。在这个数据驱动、智能互联的时代,我们不禁发问:当AI的触角延伸到工业的每一个角落,它将如何重塑工业的未来?

AInno-75B正式亮相,AI在视觉识别和工业设计领域的应用范围进一步拓宽。Chat GPT、Sora、Suno等AI技术的接连问世,让人类社会经历了一场认知的革命。世人开始意识到,AI不仅是单一的工具本身,更是推动人类文明进步的新引擎。在这个数据驱动、智能互联的时代,我们不禁发问:当AI的触角延伸到工业的每一个角落,它将如何重塑工业的未来?

AI还教人烹饪毒鹅膏 如今,AI技术正在被广泛地用于我们生活中的方方面面,但是有科学家提醒大家,目前还是先不要把你的健康托付给一些APP,因为它们很有可能会犯错,甚至有可能要了人的命。

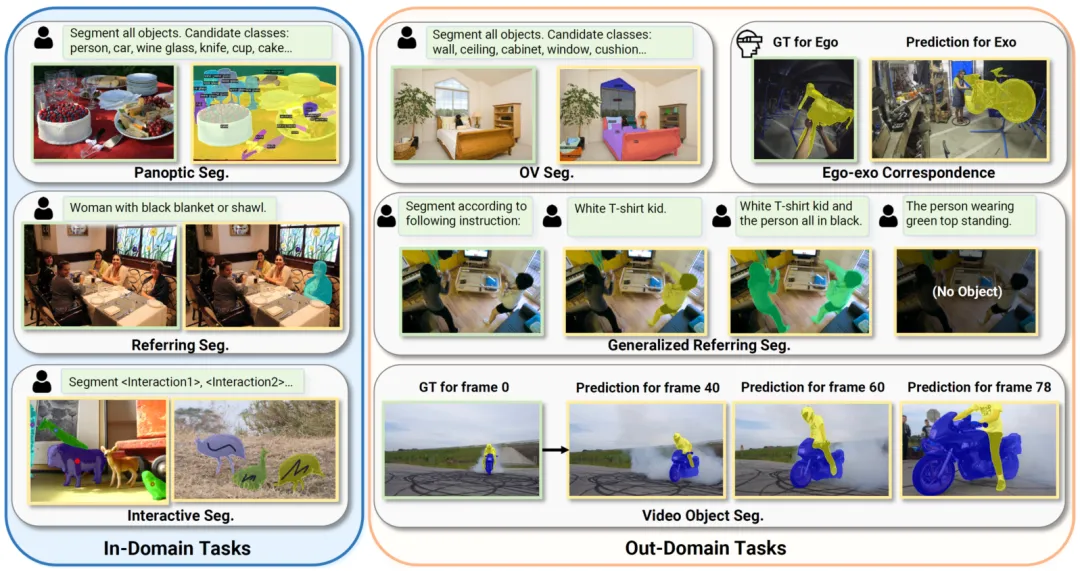

最近,多模态大模型(LMM)取得了一系列引人注目的成就,特别是在视觉 - 语言任务上的表现令人瞩目。它们的成功不仅展现了多模态大模型在各个领域的实用性和灵活性,也为更多视觉场景下的应用探索了新的道路。

随着以深度学习为代表的新一代人工智能技术不断取得突破,学术界与工业界逐渐意识到人工智能技术在图像、视频压缩领域的巨大应用潜力。

在这个风起云涌的 AI 时代,一场前所未有的资本军备竞赛正在火热上演。算力、算法、数据,这些被视为 AI 领域的三大基石,正成为各大公司争夺的焦点。然而,在这场看似技术驱动的竞赛背后,低成本资金的获取却成为了决定胜负的隐形推手。

在大模型落地应用的过程中,端侧 AI 是非常重要的一个方向。近日,斯坦福大学研究人员推出的 Octopus v2 火了,受到了开发者社区的极大关注,模型一夜下载量超 2k。20 亿参数的 Octopus v2 可以在智能手机、汽车、个人电脑等端侧运行,在准确性和延迟方面超越了 GPT-4,并将上下文长度减少了 95%。此外,Octopus v2 比 Llama7B + RAG 方案快 36 倍。

比起App Store,如今的GPT Store几乎没有一战之力。

据 ADWEEK 报道,最近刚完成 7000 万美元 B 轮融资(英伟达和杰夫·贝佐斯领投),旨在挑战谷歌搜索的 AI 搜索引擎 Perplexity 宣布计划开始销售广告。

物体姿态估计对于各种应用至关重要,例如机器人操纵和混合现实。实例级方法通常需要纹理 CAD 模型来生成训练数据,并且不能应用于测试时未见过的新物体;而类别级方法消除了这些假设(实例训练和 CAD 模型),但获取类别级训练数据需要应用额外的姿态标准化和检查步骤。

墙内开花,墙外更香?