大模型Scaling Law同样适用于下游任务性能?斯坦福、谷歌最新研究揭秘

大模型Scaling Law同样适用于下游任务性能?斯坦福、谷歌最新研究揭秘大模型的成功很大程度上要归因于 Scaling Law 的存在,这一定律量化了模型性能与训练数据规模、模型架构等设计要素之间的关系,为模型开发、资源分配和选择合适的训练数据提供了宝贵的指导。

大模型的成功很大程度上要归因于 Scaling Law 的存在,这一定律量化了模型性能与训练数据规模、模型架构等设计要素之间的关系,为模型开发、资源分配和选择合适的训练数据提供了宝贵的指导。

2 月 26 日消息,有网友在“X”上发布了 OpenAI Feather 的应用页面。

独立开发者做纯AI Wrapper 套壳应用,马上就能赚到钱这件事大概率要结束了,接下去是真的拼产品力,跟融资型或者大公司正面竞争,跑的不错的大概率会融资,跑的差的可能被收购或者倒闭的时候了。

Sora面对的挑战就像是需要处理和理解来自世界各地、不同设备拍摄的数以百万计的图片和视频。这些视觉数据在分辨率、宽高比、色彩深度等方面都存在差异。为了让Sora能够像人类大脑那样理解和生成这么丰富的视觉内容,OpenAI开发了一套将这些不同类型视觉数据转换为统一表示形式的方法。

谷歌Research Lead,负责VideoPoet项目的蒋路,即将加入TikTok,负责视频生成AI的开发。

由蛋白质和小分子配体形成的结合复合物无处不在,对生命至关重要。虽然最近科学家在蛋白质结构预测方面取得了进展,但现有算法无法系统地预测结合配体结构及其对蛋白质折叠的调节作用。

现在世界上最受关注的技术团队是哪一支?Sora团队,已经来到聚光灯中心。

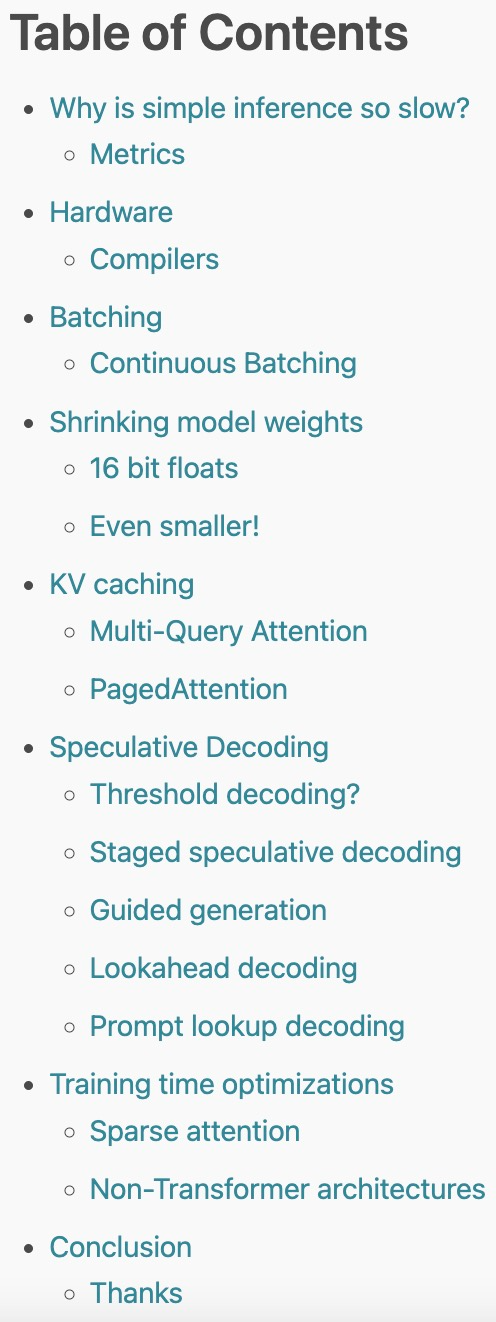

2023 年,大型语言模型(LLM)以其强大的生成、理解、推理等能力而持续受到高度关注。然而,训练和部署 LLM 非常昂贵,需要大量的计算资源和内存,因此研究人员开发了许多用于加速 LLM 预训练、微调和推理的方法。

混合专家(MoE)架构已支持多模态大模型,开发者终于不用卷参数量了!北大联合中山大学、腾讯等机构推出的新模型MoE-LLaVA,登上了GitHub热榜。

AGI 创业的时代,对于很多开发者来说,或许不能叫出海,而是生而全球化,借助 AI 的高效率工具,更好去服务全球市场的客户。