类R1强化学习迁移到视觉定位!全开源Vision-R1将图文大模型性能提升50%

类R1强化学习迁移到视觉定位!全开源Vision-R1将图文大模型性能提升50%图文大模型通常采用「预训练 + 监督微调」的两阶段范式进行训练,以强化其指令跟随能力。受语言领域的启发,多模态偏好优化技术凭借其在数据效率和性能增益方面的优势,被广泛用于对齐人类偏好。目前,该技术主要依赖高质量的偏好数据标注和精准的奖励模型训练来提升模型表现。然而,这一方法不仅资源消耗巨大,训练过程仍然极具挑战。

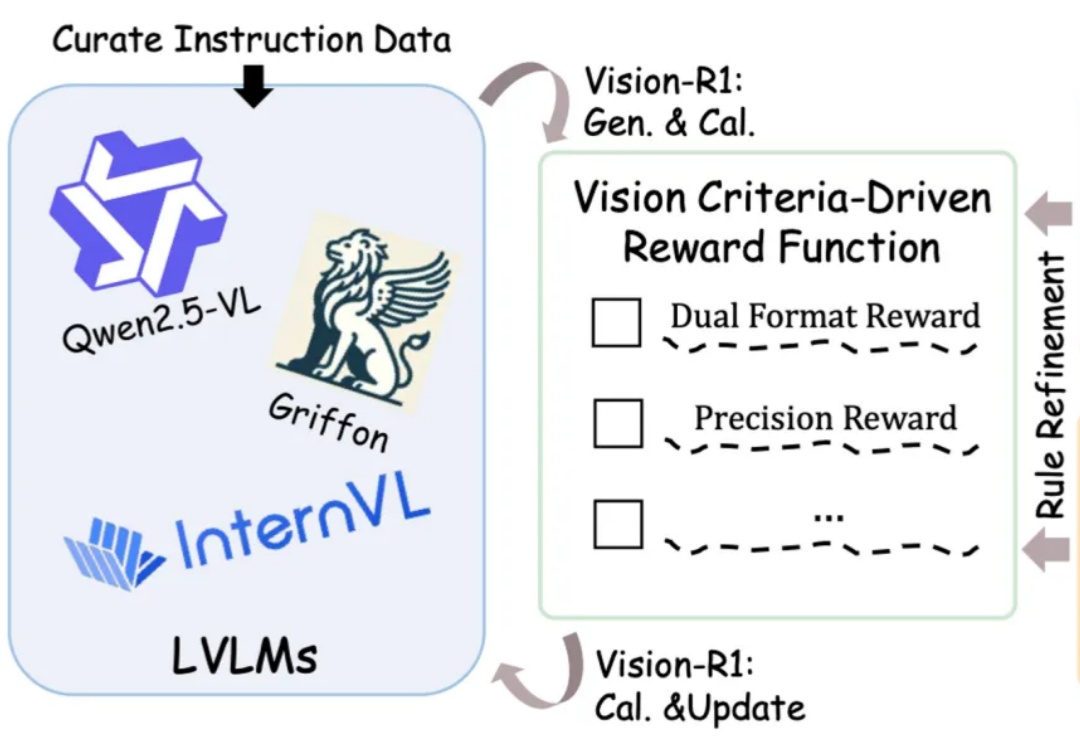

图文大模型通常采用「预训练 + 监督微调」的两阶段范式进行训练,以强化其指令跟随能力。受语言领域的启发,多模态偏好优化技术凭借其在数据效率和性能增益方面的优势,被广泛用于对齐人类偏好。目前,该技术主要依赖高质量的偏好数据标注和精准的奖励模型训练来提升模型表现。然而,这一方法不仅资源消耗巨大,训练过程仍然极具挑战。

谷歌DeepMind研发的DreamerV3实现重大突破:无需任何人类数据,通过强化学习与「世界模型」,自主完成《我的世界》中极具挑战的钻石收集任务。该成果被视为通往AGI的一大步,并已登上Nature。

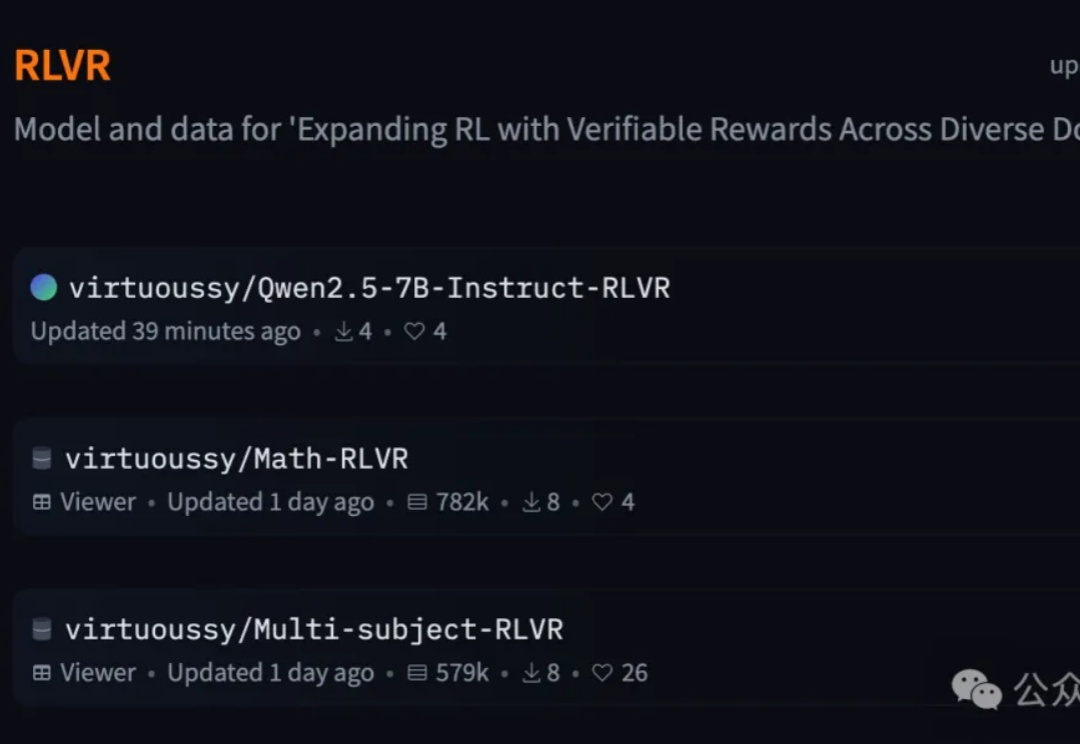

一个7B奖励模型搞定全学科,大模型强化学习不止数学和代码。

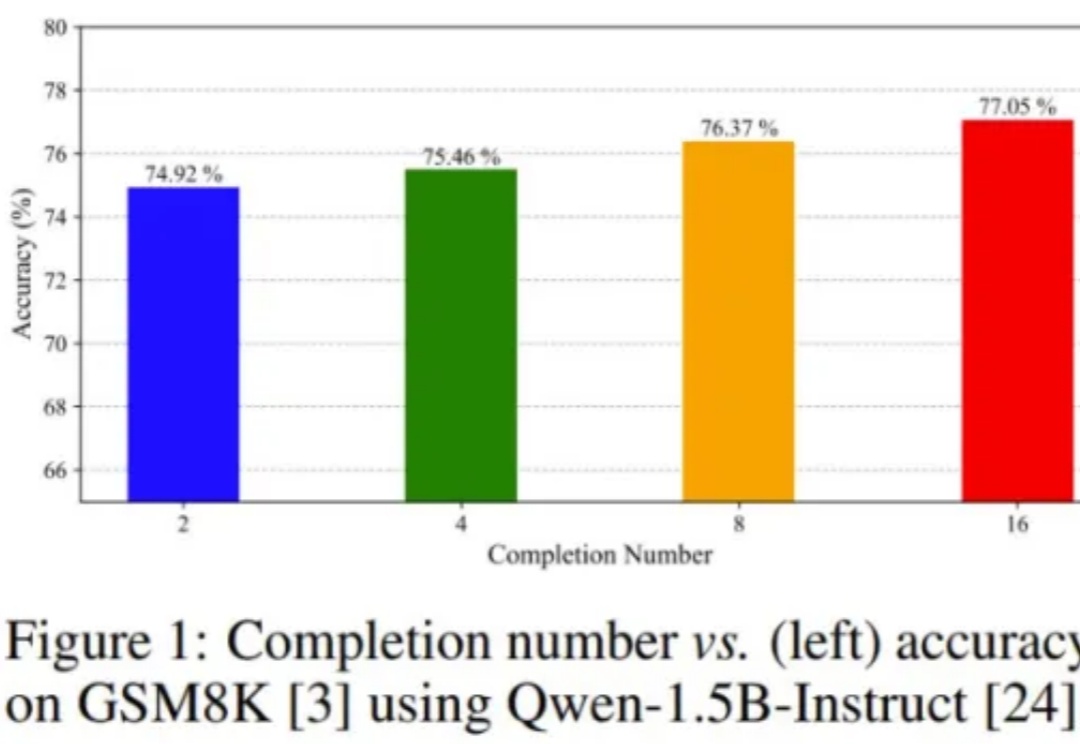

DeepSeek-R1 的成功离不开一种强化学习算法:GRPO(组相对策略优化)。

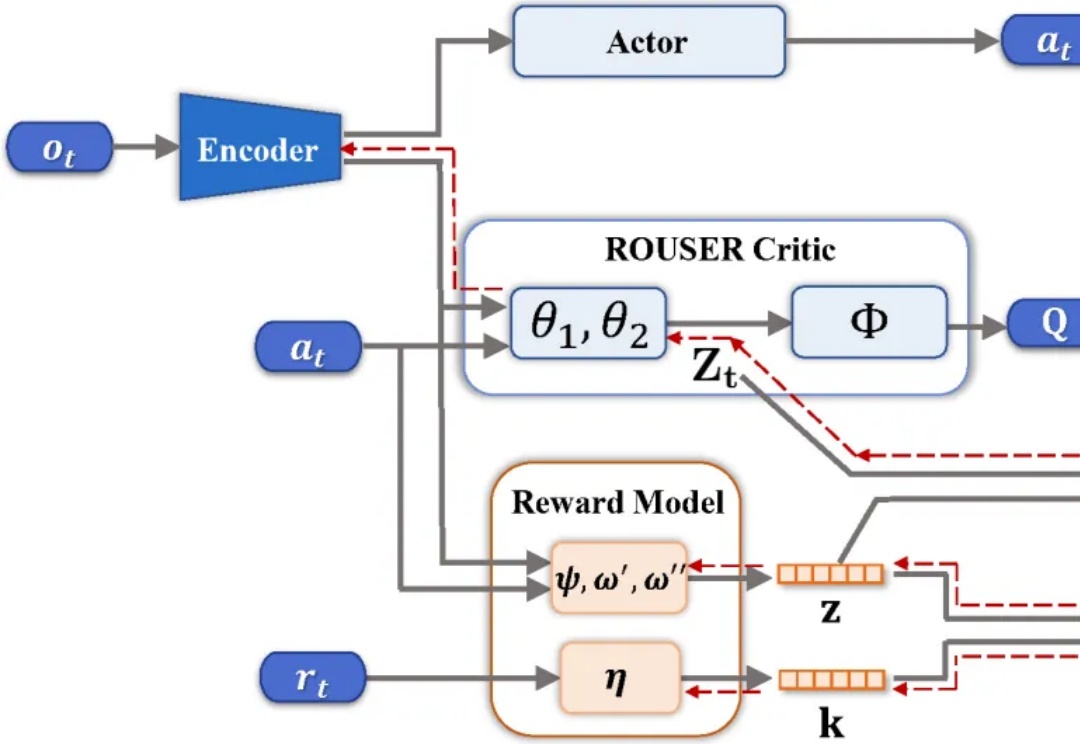

在视觉强化学习中,许多方法未考虑序列决策过程,导致所学表征缺乏关键的长期信息的空缺被填补上了。

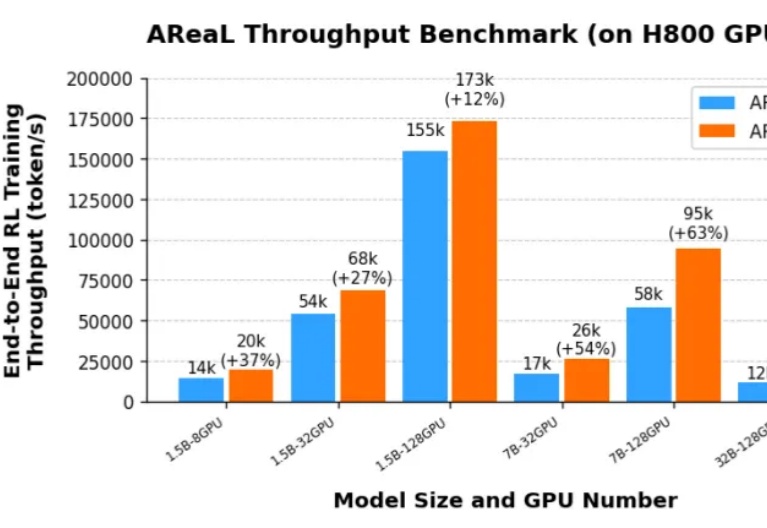

由于 DeepSeek R1 和 OpenAI o1 等推理模型(LRM,Large Reasoning Model)带来了新的 post-training scaling law,强化学习(RL,Reinforcement Learning)成为了大语言模型能力提升的新引擎。然而,针对大语言模型的大规模强化学习训练门槛一直很高:

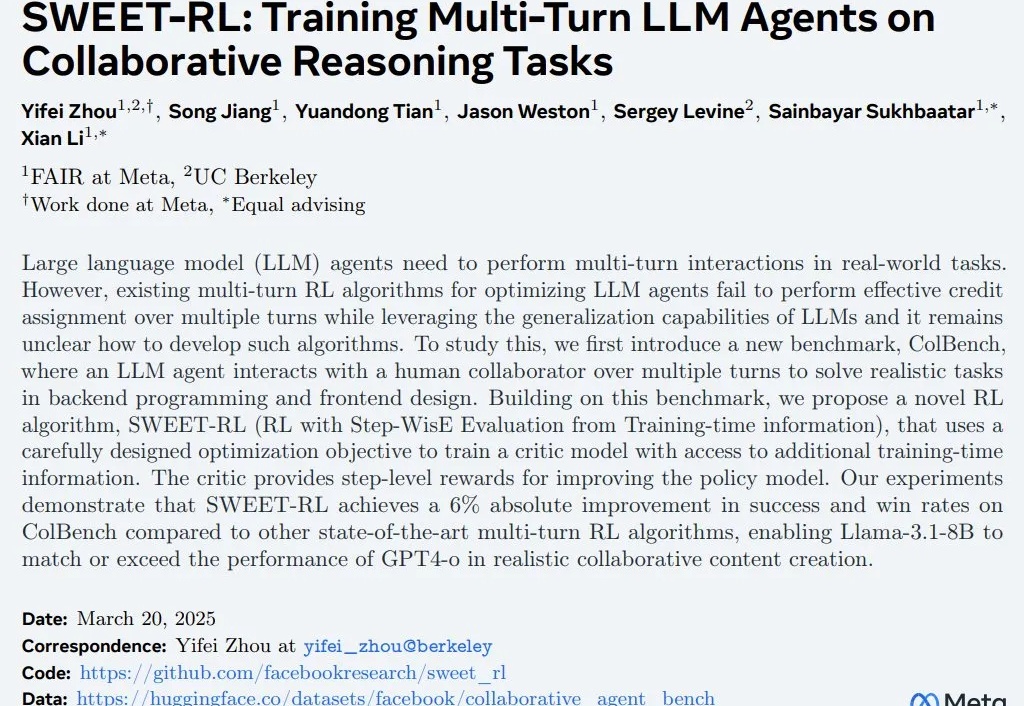

强化学习提升了 LLM 各方面的能力,而强化学习本身也在进化。

注意看,机器人像人一样从容地走出大门了!人形机器人独角兽Figure,再次带来他们的新成果——利用强化学习实现自然人形行走。跟之前版本的机器人相比,确实更像人了许多,而且步态更加轻盈,速度也更快。

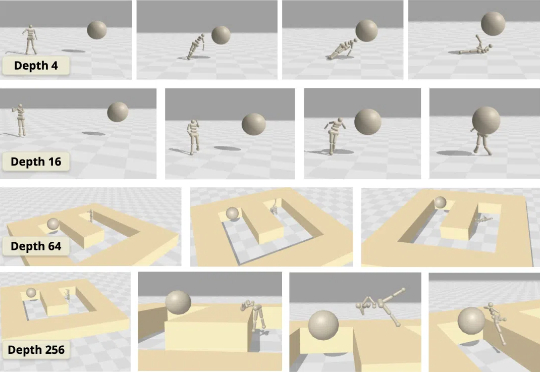

虽然大多数强化学习(RL)方法都在使用浅层多层感知器(MLP),但普林斯顿大学和华沙理工的新研究表明,将对比 RL(CRL)扩展到 1000 层可以显著提高性能,在各种机器人任务中,性能可以提高最多 50 倍。

波士顿动力的Atlas机器人又双叒叕来了!从最初的液压「电缆尾巴」到现在全电动AI增强版,这个机器人不仅会翻跟头、跳街舞,还学会了倒立侧翻,甚至开始「进厂打工」搬零件。动作捕捉技术与强化学习的加持,让Atlas的动作越来越像人类,而它的目标也从炫技转向实用。