加速扩散模型,最快1步生成SOTA级图片,字节Hyper-SD开源了

加速扩散模型,最快1步生成SOTA级图片,字节Hyper-SD开源了最近,扩散模型(Diffusion Model)在图像生成领域取得了显著的进展,为图像生成和视频生成任务带来了前所未有的发展机遇。尽管取得了令人印象深刻的结果,扩散模型在推理过程中天然存在的多步数迭代去噪特性导致了较高的计算成本。

最近,扩散模型(Diffusion Model)在图像生成领域取得了显著的进展,为图像生成和视频生成任务带来了前所未有的发展机遇。尽管取得了令人印象深刻的结果,扩散模型在推理过程中天然存在的多步数迭代去噪特性导致了较高的计算成本。

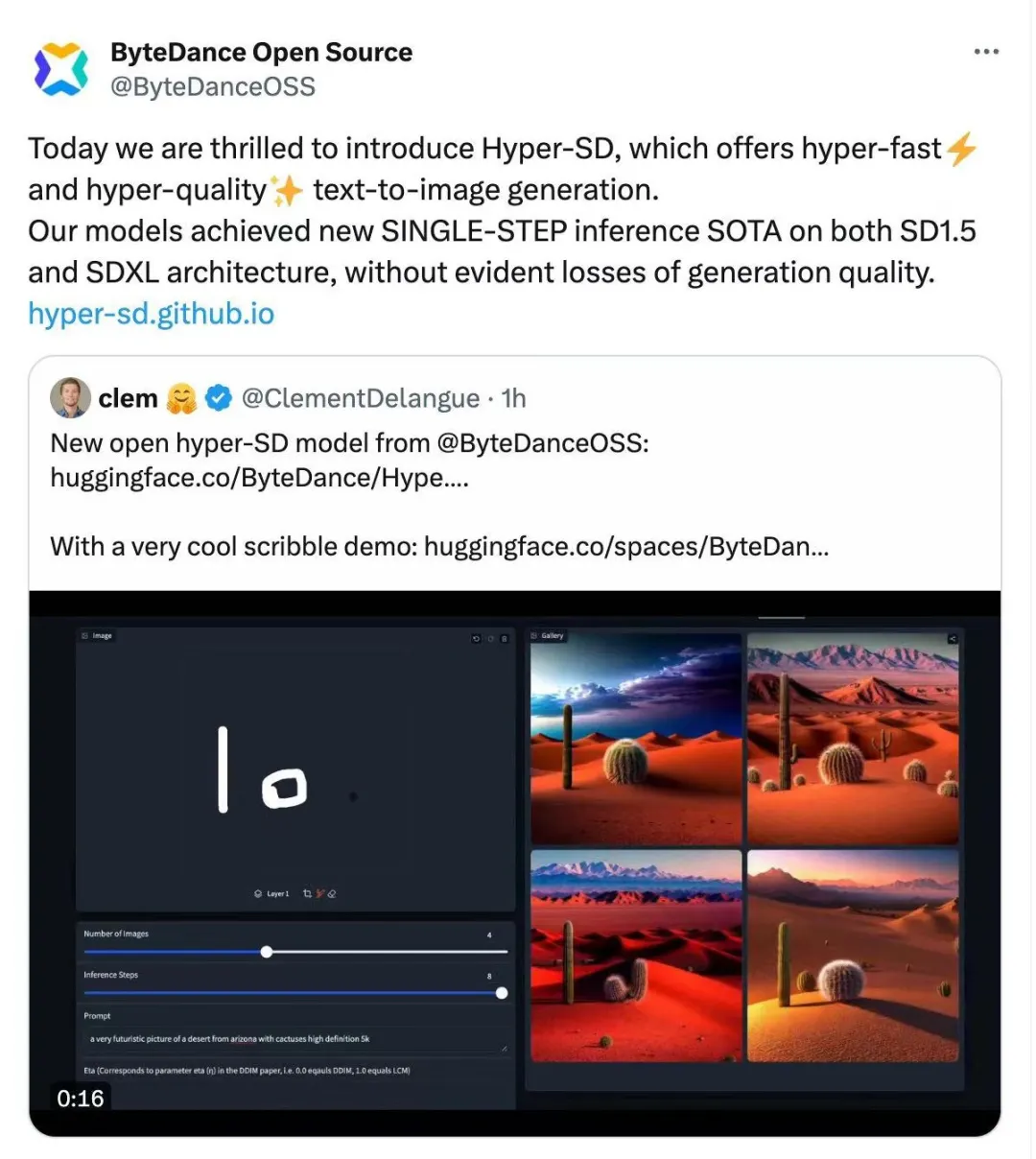

图像融合的目的是将同一场景中不同传感器捕获的多源图像的互补信息整合到单个图像上。这种方式通常被用于提取图片重要信息和提高视觉质量。

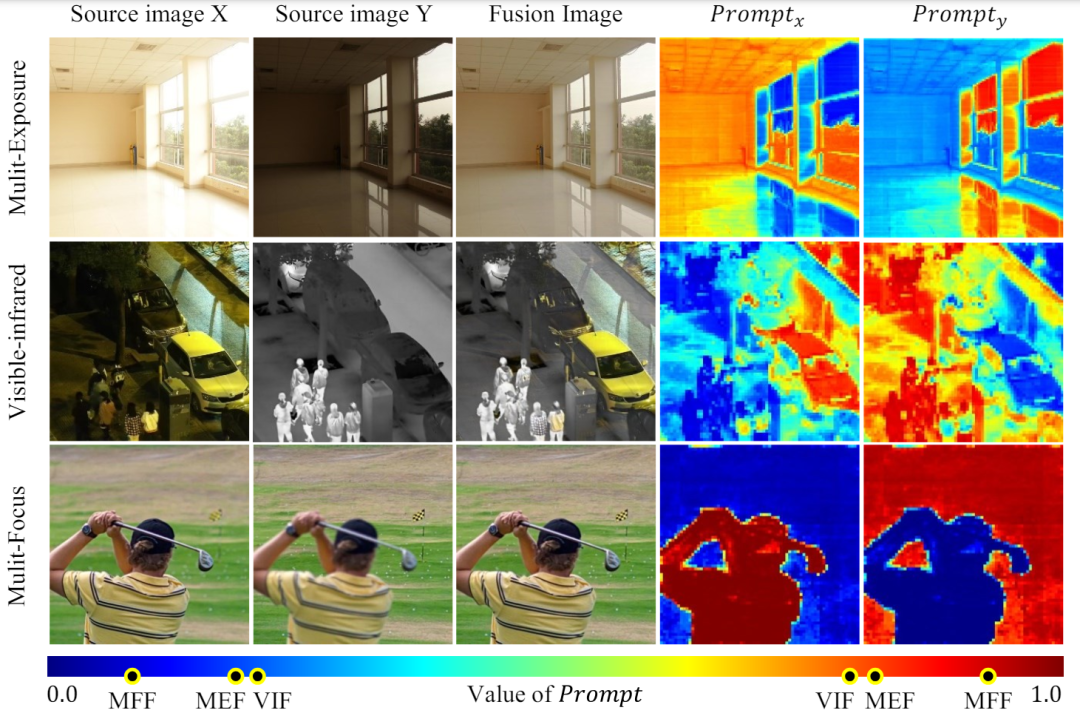

在人物说话的过程中,每一个细微的动作和表情都可以表达情感,都能向观众传达出无声的信息,也是影响生成结果真实性的关键因素。

最近,字节旗下的一款视频生成AI——Dreamina 开始大规模开放测试。 Dreamina 不算是新产品,但现在它与 Sora 最大的区别,不是模型能力,而是它真的是能使用的。

过去几年来,扩散模型强大的图像合成能力已经得到充分证明。研究社区现在正在攻克一个更困难的任务:视频生成。近日,OpenAI 安全系统(Safety Systems)负责人 Lilian Weng 写了一篇关于视频生成的扩散模型的博客。

过去几年里,基于文本来生成图像的扩散模型得到了飞速发展,生成能力有了显著的提升,可以很容易地生成逼真的肖像画,以及各种天马行空的奇幻画作。

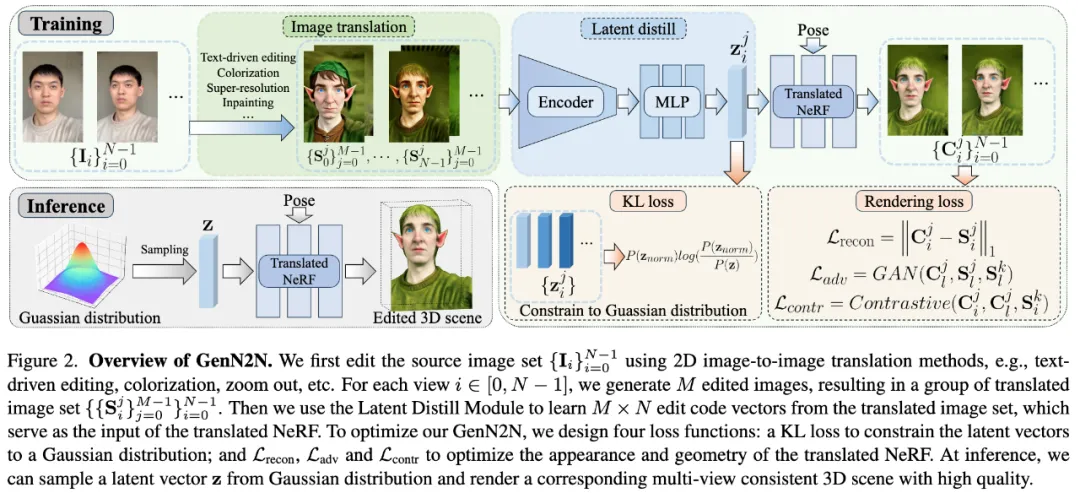

来自香港科技大学,清华大学的研究者提出了「GenN2N」,一个统一的生成式 NeRF-to-NeRF 转换框架,适用于各种 NeRF 转换任务,例如文字驱动的 NeRF 编辑、着色、超分辨率、修复等,性能均表现极其出色!

纵观生成式AI领域中的两个主导者:自回归和扩散模型。 一个专攻文本等离散数据,一个长于图像等连续数据。 如果,我们让后者来挑战前者的主场,它能行吗?

风格化图像生成,也常称为风格迁移,其目标是生成与参考图像风格一致的图像。

新一代视觉生成范式「VAR: Visual Auto Regressive」视觉自回归来了