互联网巨头,如何合法地「偷」你的数据训练 AI?

互联网巨头,如何合法地「偷」你的数据训练 AI?苍蝇再小也是肉,聚沙成塔。

苍蝇再小也是肉,聚沙成塔。

大模型对话能更接近现实了!

只需几分钟、一张图或一句话,就能完成时空一致的4D内容生成。

在这个数据为王的时代,数据是人工智能的三大支柱之一,其重要性不言而喻。最近,OpenAI 收购了数据库初创公司 Rockset,迅速引起了业内外的广泛关注。OpenAI 早已在算法和计算能力方面遥遥领先,通过这次战略性的收购,OpenAI 将在其产品中融合 Rockset 的先进数据索引和查询技术,帮助 OpenAI 将数据转化为 “可操作智能”。

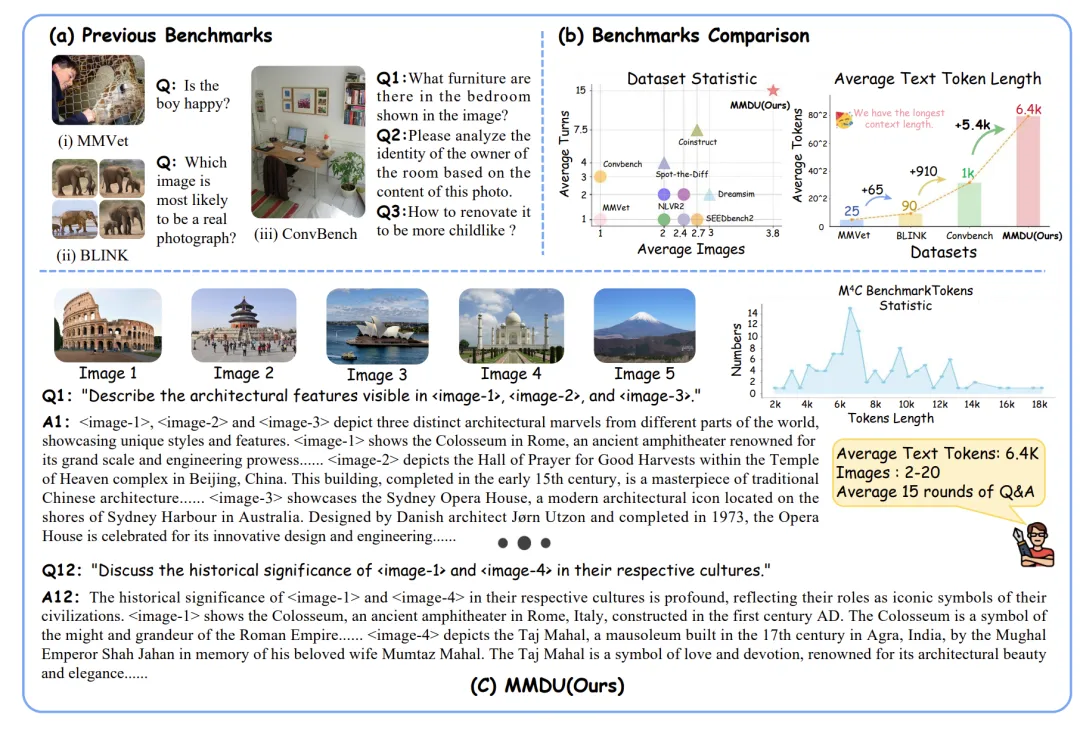

近日,LeCun和谢赛宁等大佬,共同提出了这一种全新的SOTA MLLM——Cambrian-1。开创了以视觉为中心的方法来设计多模态模型,同时全面开源了模型权重、代码、数据集,以及详细的指令微调和评估方法。

AI 和数据库真正的大一统时代要来了?

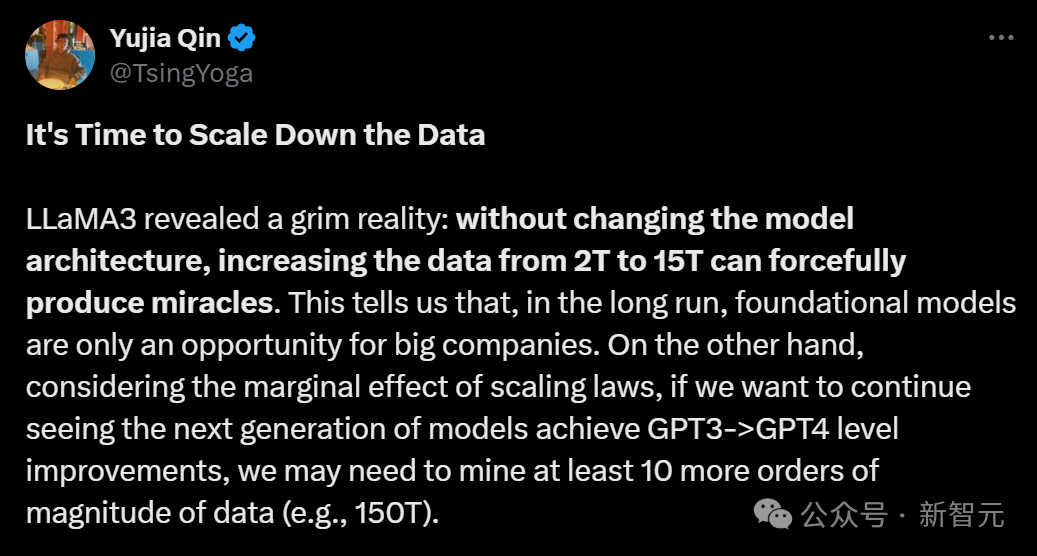

是时候把数据Scale Down了!Llama 3揭示了这个可怕的事实:数据量从2T增加到15T,就能大力出奇迹,所以要想要有GPT-3到GPT-4的提升,下一代模型至少还要150T的数据。好在,最近有团队从CommonCrawl里洗出了240T数据——现在数据已经不缺了,但你有卡吗?

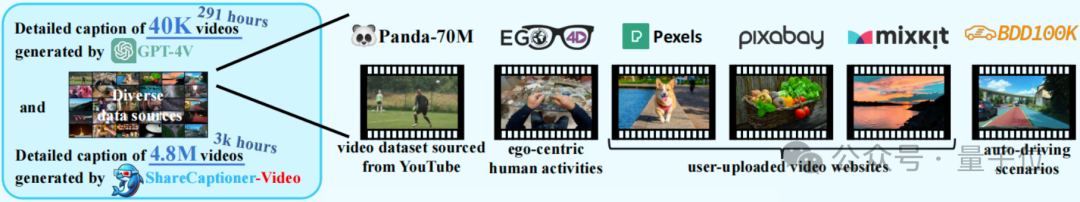

中科大、上海AI实验室等组成的ShareGPT4V团队,推出了新的视频数据集,登顶HuggingFace排行榜!

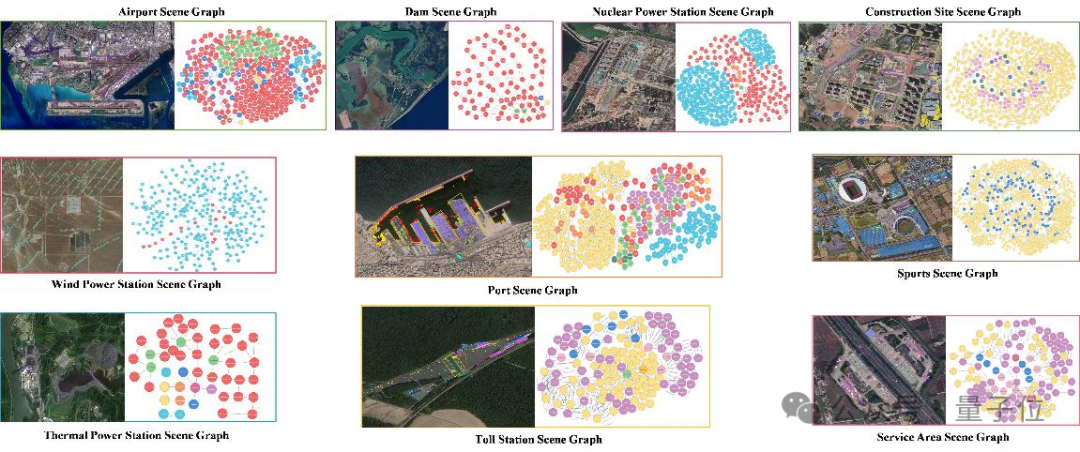

AI卫星影像知识生成模型数据集稀缺的问题,又有新解了。

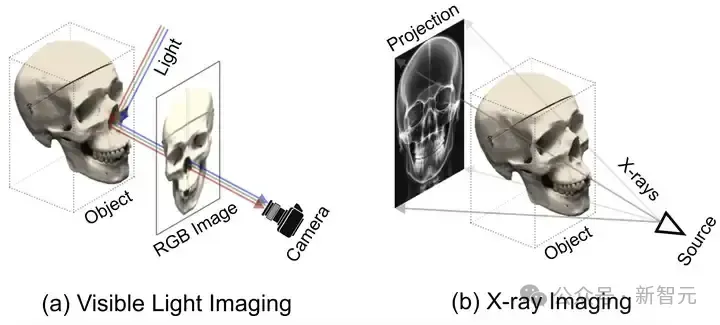

SAX-NeRF框架,一种专为稀疏视角下X光三维重建设计的新型NeRF方法,通过Lineformer Transformer和MLG采样策略显著提升了新视角合成和CT重建的性能。研究者还建立了X3D数据集,并开源了代码和预训练模型,为X光三维重建领域的研究提供了宝贵的资源和工具。