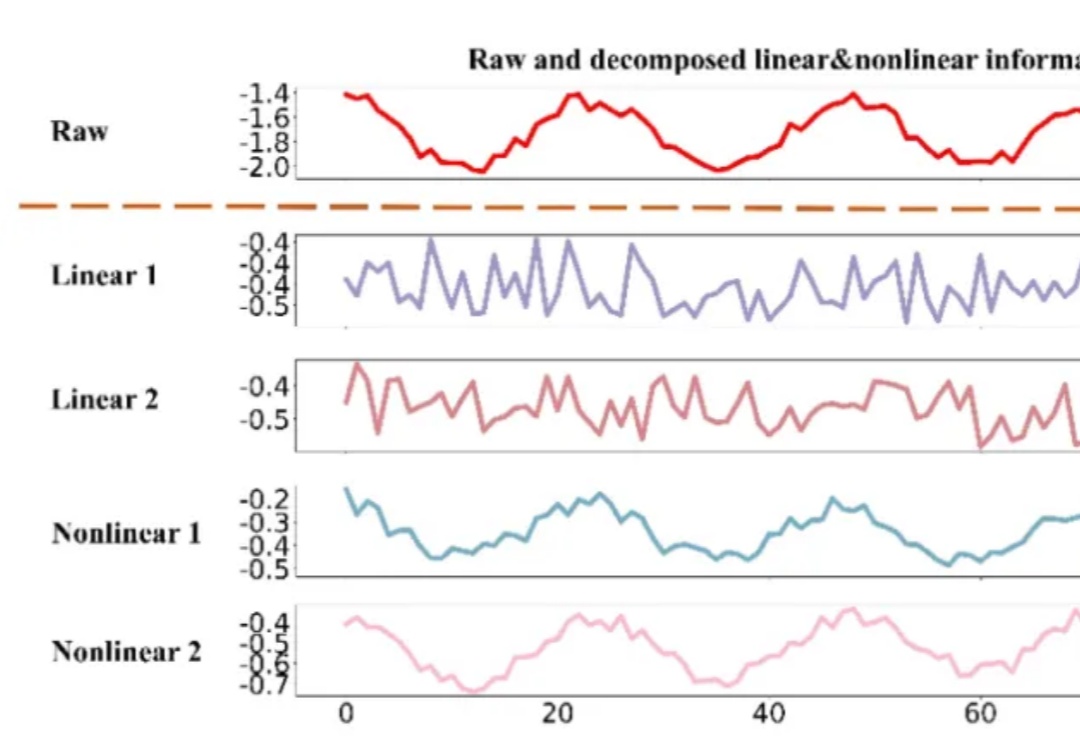

北大、港理工革新性LiNo框架:线性与非线性模式有效分离,性能全面超越Transformer

北大、港理工革新性LiNo框架:线性与非线性模式有效分离,性能全面超越Transformer时间序列数据,作为连续时间点的数据集合,广泛存在于医疗、金融、气象、交通、能源(电力、光伏等)等多个领域。有效的时间序列预测模型能够帮助我们理解数据的动态变化,预测未来趋势,从而做出更加精准的决策。

时间序列数据,作为连续时间点的数据集合,广泛存在于医疗、金融、气象、交通、能源(电力、光伏等)等多个领域。有效的时间序列预测模型能够帮助我们理解数据的动态变化,预测未来趋势,从而做出更加精准的决策。

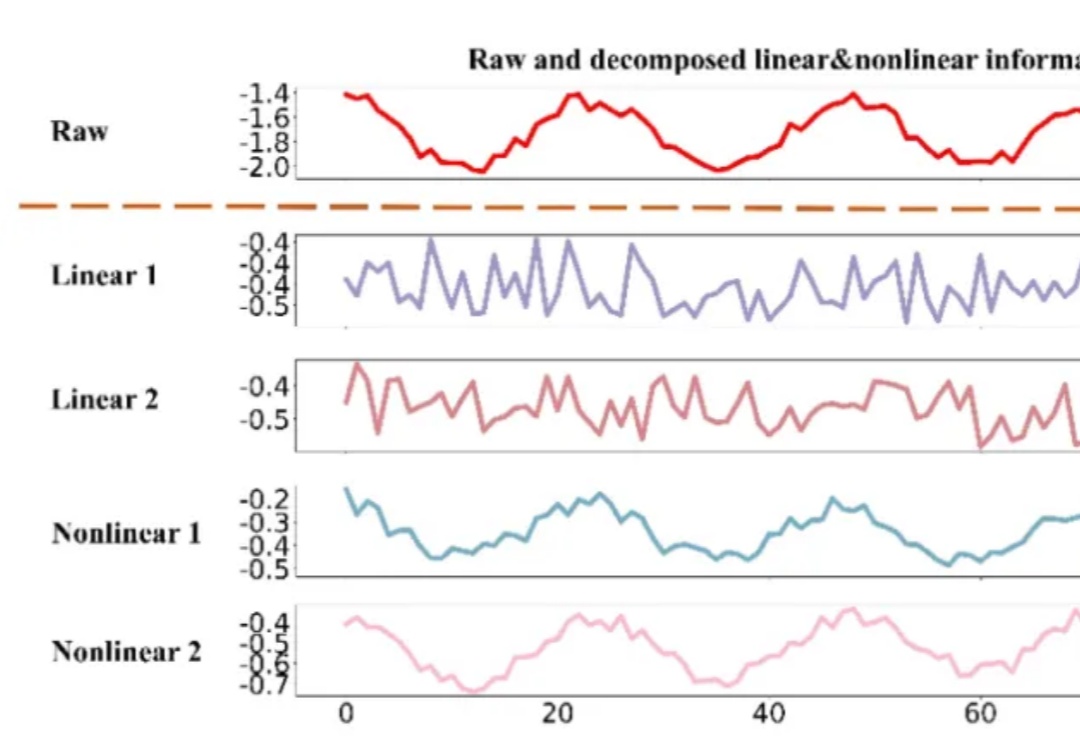

SceneX是一个创新的3D场景生成框架,能根据简单的文字描述快速创建高质量、逼真的虚拟场景,大幅提高构建虚拟世界的效率和灵活性。

多模态理解与生成一体化模型,致力于将视觉理解与生成能力融入同一框架,不仅推动了任务协同与泛化能力的突破,更重要的是,它代表着对类人智能(AGI)的一种深层探索。

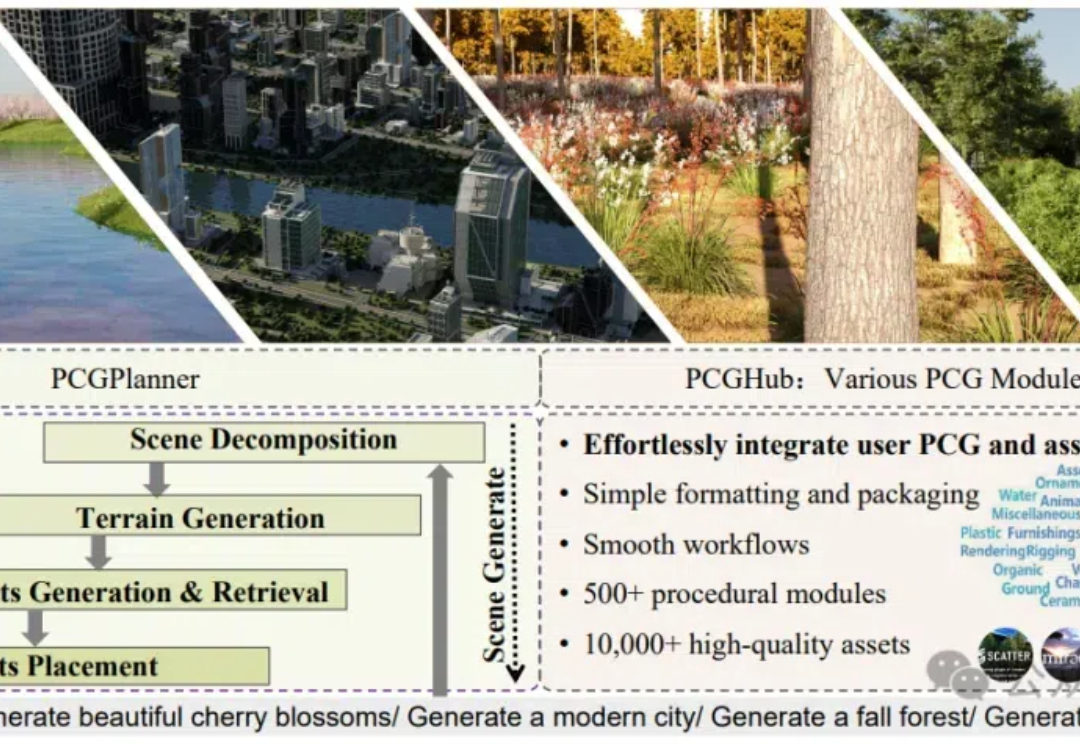

在机器人空间泛化领域,原来也有一套Scaling Law! 来自清华和新加坡国立大学的团队,发现了空间智能的泛化性规律。 在此基础上,他们提出了一套新颖的算法框架——ManiBox,让机器人能够在真实世界中应对多样化的物体位置和复杂的场景布置。

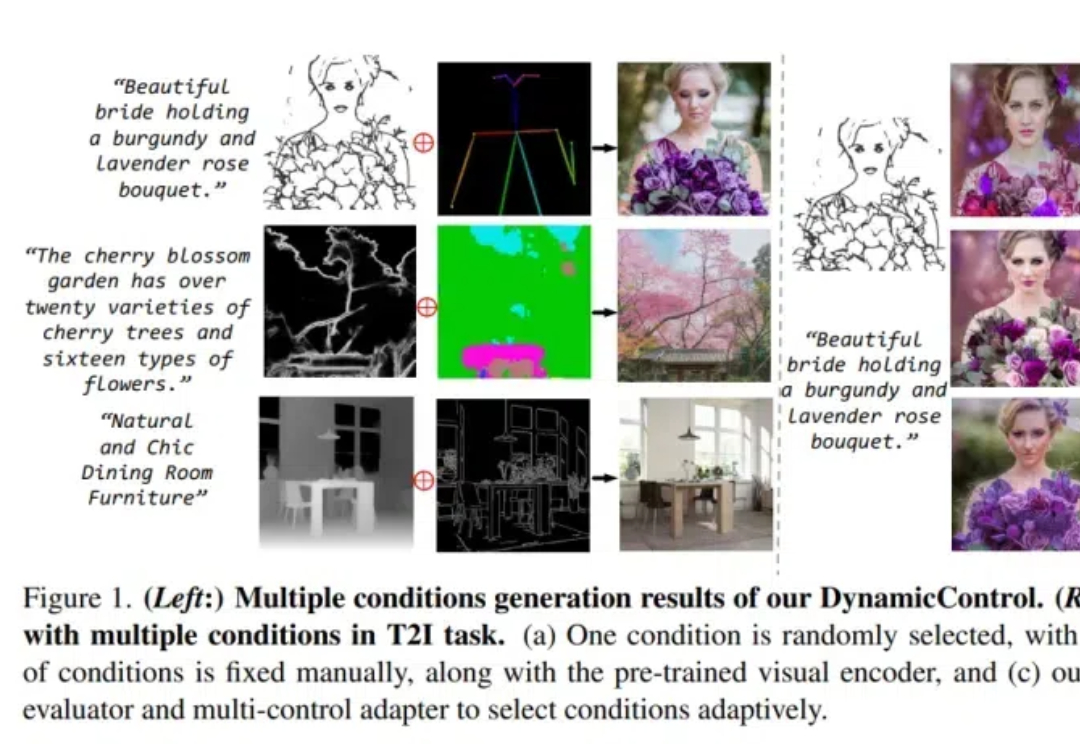

超越ControlNet++,让文生图更可控的新框架来了!

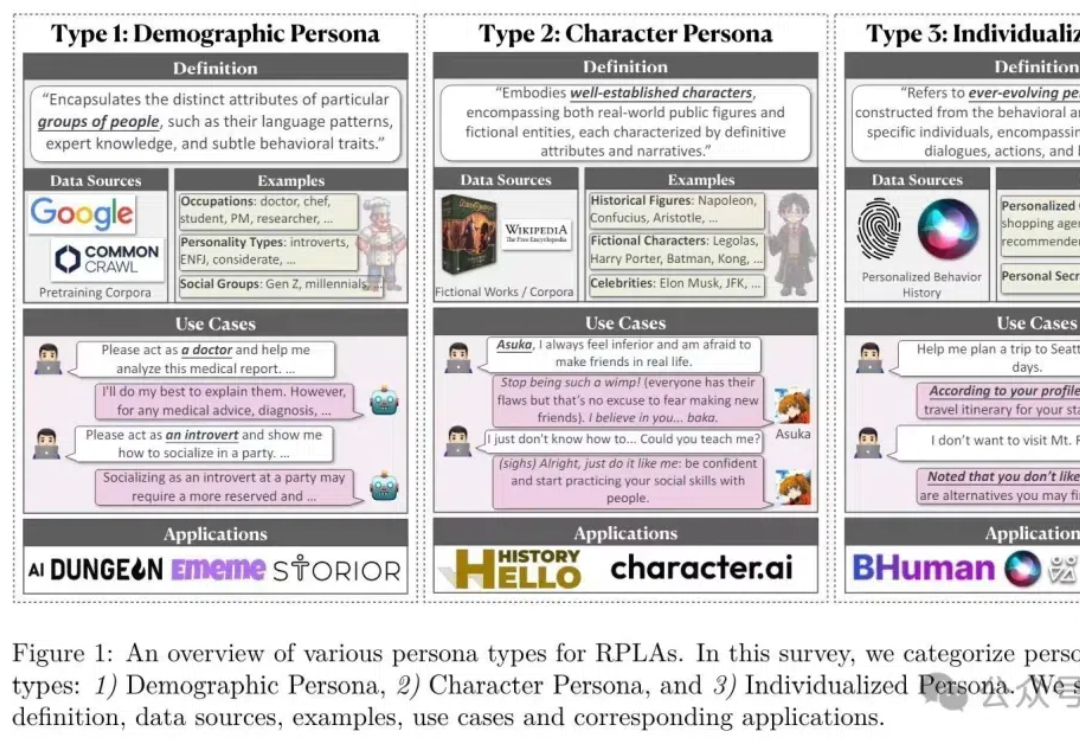

数字生命一直是人类几十年来的追求,反映了我们对技术与人类体验交汇的深层探索。近期,复旦大学发表了一篇综述论文,首次系统梳理了角色扮演AI(Role-Playing Language Agents,RPLAs)的研究现状,现已被机器学习顶级期刊TMLR接收。

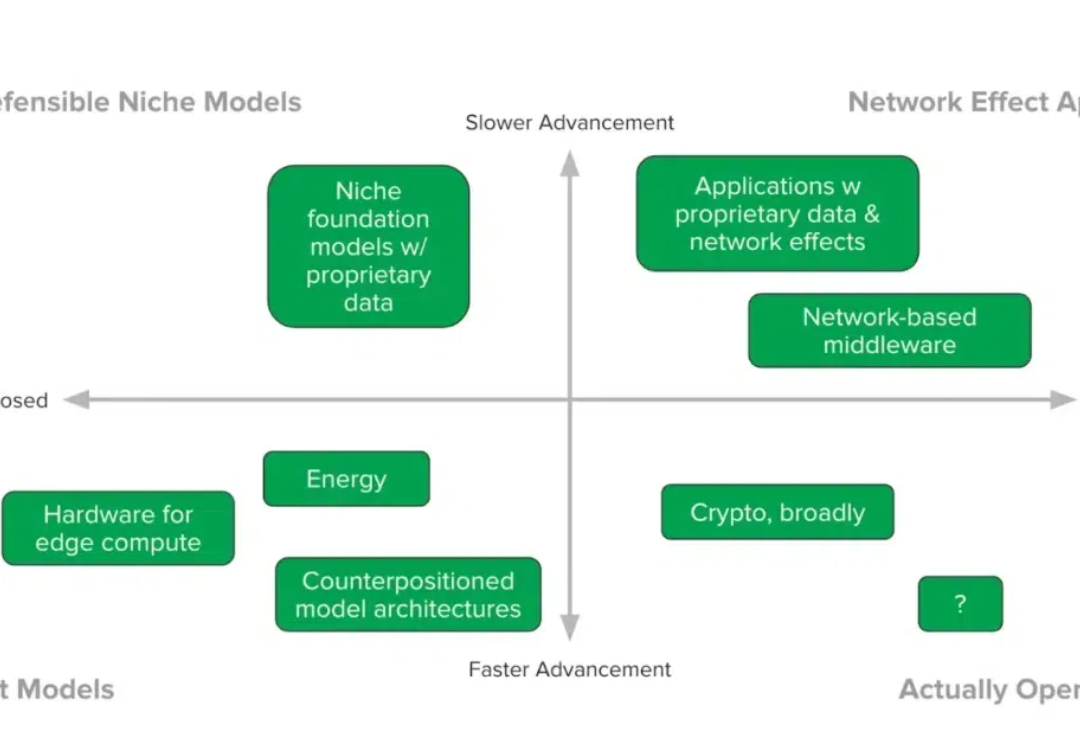

我超级喜欢构建一个框架和模式来分析未来各种可能性的思维方式。

刚刚,ControlNet作者张吕敏又发布了一个的图像打光新项目LuminaBrush,LuminaBrush 是一个构建交互式工具的项目,用于在图像上绘制光照效果。该框架采用两阶段方法:首先将图像转换为均匀光照的外观;然后通过用户的涂鸦生成光照效果。

上周发出《AI时代写Prompt应该用APPL:为Prompt工程打造的编程语言,来自清华姚班的博士》之后,文章中实现了一个Google DeepMind的OPRO简单版本的优化方法,这让很多读者非常着迷。

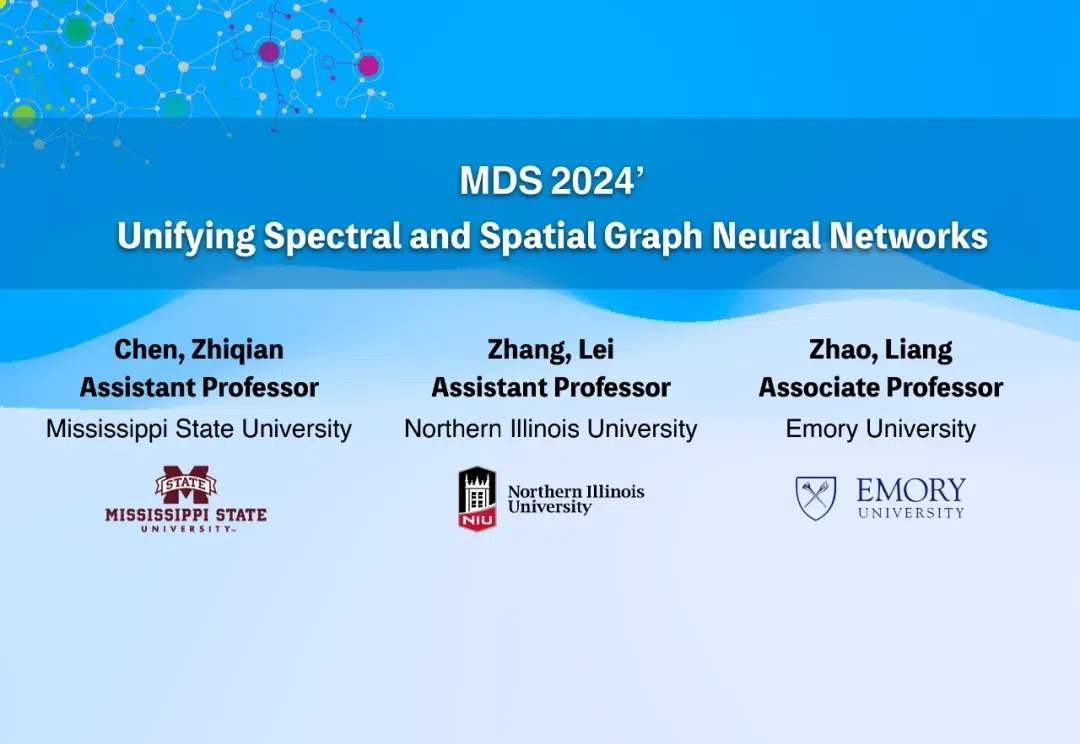

图数据学习在过去几年中取得了显著的进展,图神经网络(GNN)在此过程中起到了核心作用。然而,不同的 GNN 方法在概念和实现上的差异,对理解和应用图学习算法构成了挑战。