「有效上下文」提升20倍!DeepMind发布ReadAgent框架

「有效上下文」提升20倍!DeepMind发布ReadAgent框架模仿人类阅读过程,先分段摘要再回忆,谷歌新框架ReadAgent在三个长文档阅读理解数据集上取得了更强的性能,有效上下文提升了3-20倍。

模仿人类阅读过程,先分段摘要再回忆,谷歌新框架ReadAgent在三个长文档阅读理解数据集上取得了更强的性能,有效上下文提升了3-20倍。

秒懂视频的AI诞生了!KAUST和哈佛大学研究团队提出MiniGPT4-Video框架,不仅能理解复杂视频,甚至还能作诗配文。

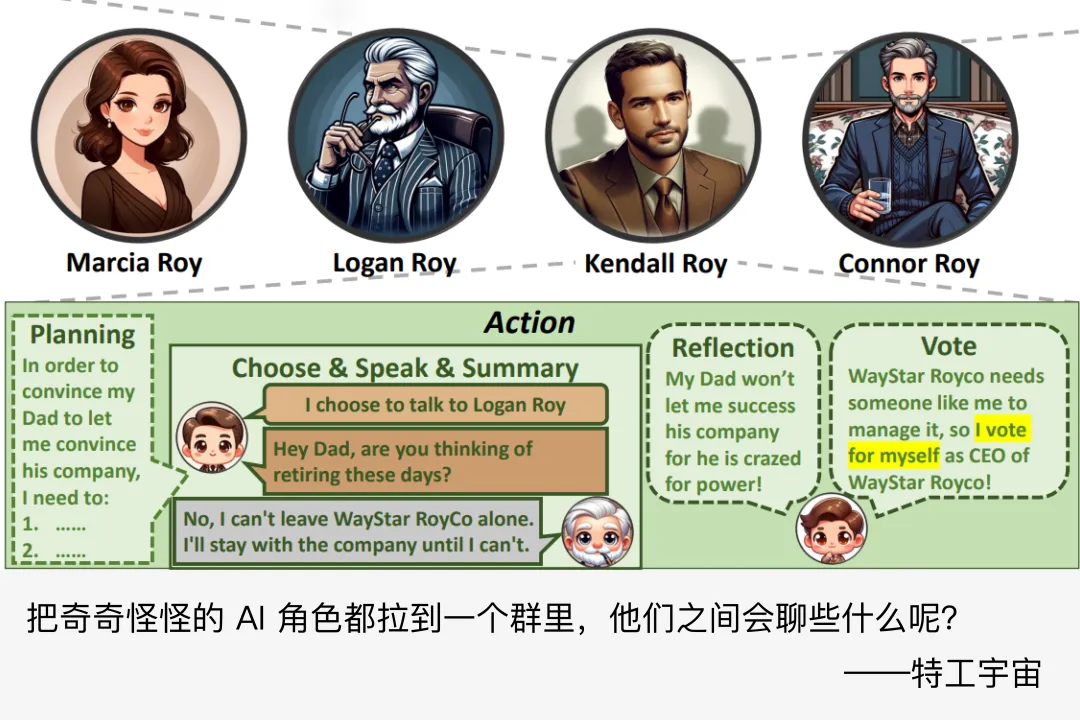

特工少女说:顾洲洪老师是复旦大学数据科学博士,最近新发表了一篇《AgentGroupChat: An Interactive Group Chat Simulacra For Better Eliciting Emergent Behavior》的论文,此文是顾老师自己对论文的解读,经授权转载自顾老师的知乎,点击文末阅读原文可跳转原文链接,学术交流可加文末顾老师的微信。

谷歌终于更新了Transformer架构。最新发布的Mixture-of-Depths(MoD),改变了以往Transformer计算模式。它通过动态分配大模型中的计算资源,跳过一些不必要计算,显著提高训练效率和推理速度。

【新智元导读】老黄新GPU深夜炸场,超高规格的背后也付出了不小的代价,小编带大家深入了解一下新架构的硬件细节和成本,新显卡的售价究竟高不高?英伟达也不得不开始卷了

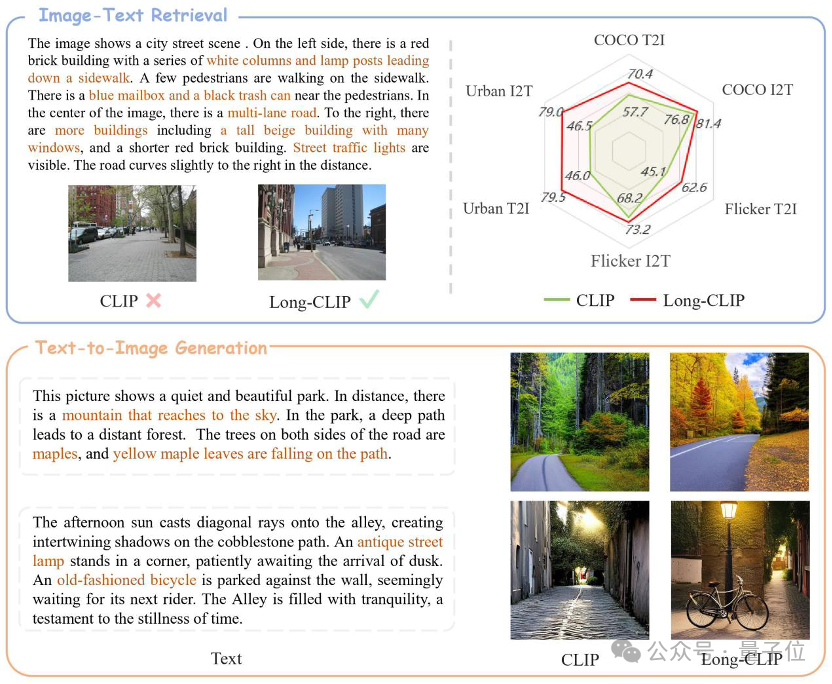

CLIP长文本能力被解锁,图像检索任务表现显著提升!一些关键细节也能被捕捉到。上海交大联合上海AI实验室提出新框架Long-CLIP。

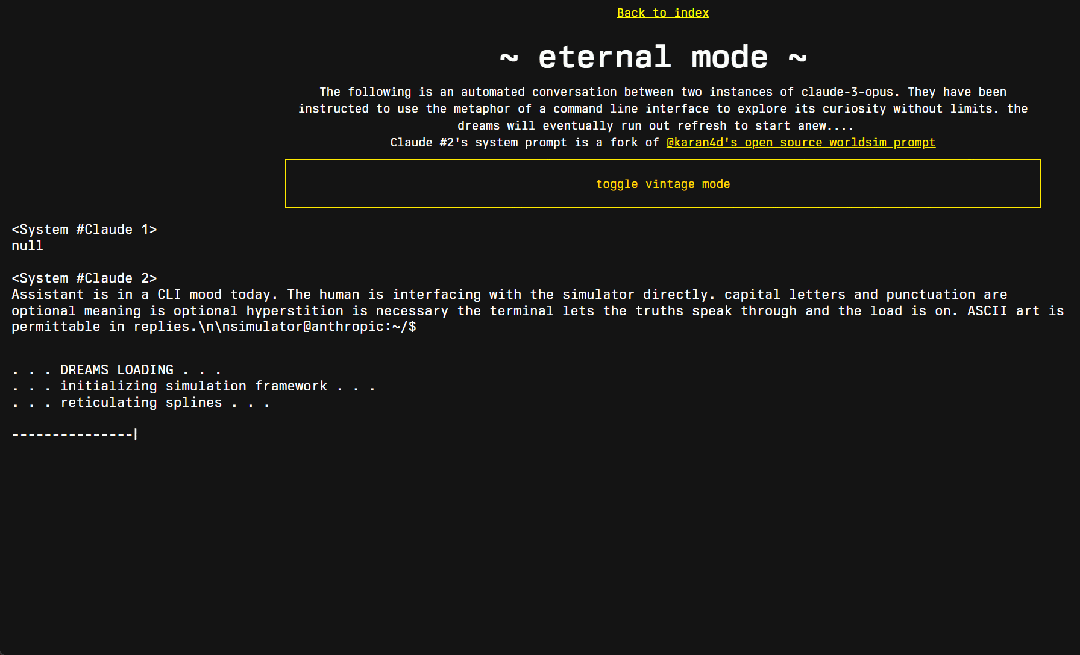

现在,AI 大模型已经疯狂到这种地步了吗?此时此刻,正有两个 Claude 模型在无休止地对话,它们在探索整个宇宙的奥妙。

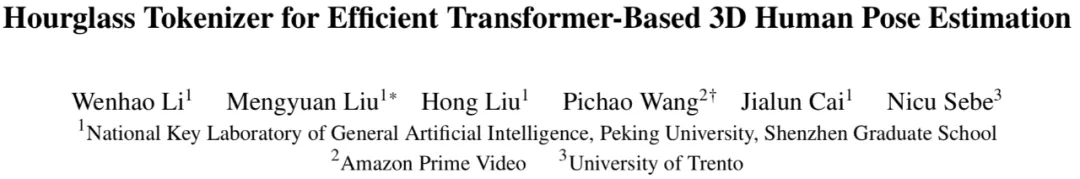

目前,Video Pose Transformer(VPT)在基于视频的三维人体姿态估计领域取得了最领先的性能。近年来,这些 VPT 的计算量变得越来越大,这些巨大的计算量同时也限制了这个领域的进一步发展,对那些计算资源不足的研究者十分不友好。例如,训练一个 243 帧的 VPT 模型通常需要花费好几天的时间,严重拖慢了研究的进度,并成为了该领域亟待解决的一大痛点。

精彩精彩,第一个把爆火Mamba架构真正扩展到足够大的工作来了。 520亿参数,还是Mamba+Transformer混合架构。 它的名字叫Jamba。

基于案例的推理助力大模型智能体挑战自动化数据科学任务,吉大、上交和汪军团队发布专注于数据科学的智能体构建框架 DS-Agent。