“存算一体”是大模型AI芯片的破局关键?

“存算一体”是大模型AI芯片的破局关键?近年来,随着Transformer模型的大规模发展和应用,模型大小每两年平均增长240倍,GPT-3等大模型的参数增长已经超过了GPU内存的增长。在大算力激增的需求下,越来越多行业人士认识到,新的计算架构或许才是算力破局的关键。

搜索

搜索

近年来,随着Transformer模型的大规模发展和应用,模型大小每两年平均增长240倍,GPT-3等大模型的参数增长已经超过了GPU内存的增长。在大算力激增的需求下,越来越多行业人士认识到,新的计算架构或许才是算力破局的关键。

2023年,人工智能技术的创新与应用突飞猛进,ChatGPT等大模型爆火出圈,AI热潮席卷全球。

无需微调,只要四行代码就能让大模型窗口长度暴增,最高可增加3倍!而且是“即插即用”,理论上可以适配任意大模型,目前已在Mistral和Llama2上试验成功。

如何从一段视频中找出感兴趣的片段?时序行为检测(Temporal Action Localization,TAL)是一种常用方法。过去TAL中的建模是片段甚至实例级的,而现在只要视频里的一帧就能实现,效果媲美全监督。

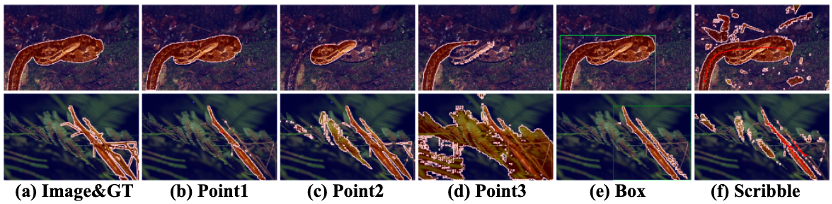

仅需一个任务描述,即可一键分割所有图片!

当大家都在研究大模型(LLM)参数规模达到百亿甚至千亿级别的同时,小巧且兼具高性能的小模型开始受到研究者的关注。

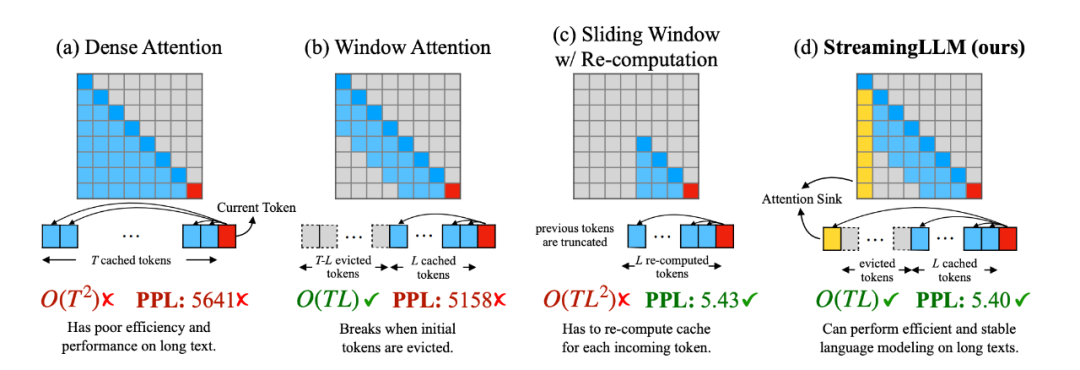

在大型语言模型(LLM)的世界中,处理多轮对话一直是一个挑战。前不久麻省理工 Guangxuan Xiao 等人推出的 StreamingLLM,能够在不牺牲推理速度和生成效果的前提下,可实现多轮对话总共 400 万个 token 的流式输入,22.2 倍的推理速度提升。

指令调优或许是让大模型性能提升最有潜力的方法。用高质量数据集进行指令调优,能让大模型性能快速提升。

将2D扩散模型的强大图像生成能力与再绘策略的纹理对齐能力结合起来,Repaint123能够在2分钟内从零开始生成具有多视角一致性和精细纹理的高质量3D内容。

大模型推理再次跃升一个新台阶!最近,全新开源的国产SwiftInfer方案,不仅能让LLM处理无限流式输入,而且还将推理性能提升了46%。