一张照片、一段声音秒生超逼真视频!南大等提出全新框架,口型动作精准还原

一张照片、一段声音秒生超逼真视频!南大等提出全新框架,口型动作精准还原最近,来自南大等机构的研究人员开发了一个通用的框架,用一段音频就能让照片上的头像讲多国语言。不论是头部动作还是嘴型都非常自然,看到很多不错的

搜索

搜索

最近,来自南大等机构的研究人员开发了一个通用的框架,用一段音频就能让照片上的头像讲多国语言。不论是头部动作还是嘴型都非常自然,看到很多不错的

在视频生成场景中,用 Transformer 做扩散模型的去噪骨干已经被李飞飞等研究者证明行得通。这可算得上是 Transformer 在视频生成领域取得的一项重大成功。

都快到年底了,大模型领域还在卷,今天,Microsoft发布了参数量为2.7B的Phi-2——不仅13B参数以内没有对手,甚至还能和Llama 70B掰手腕!

随着大型语言模型(LLM)的发展,从业者面临更多挑战。如何避免 LLM 产生有害回复?如何快速删除训练数据中的版权保护内容?如何减少 LLM 幻觉(hallucinations,即错误事实)? 如何在数据政策更改后快速迭代 LLM?这些问题在人工智能法律和道德的合规要求日益成熟的大趋势下,对于 LLM 的安全可信部署至关重要。

人类对人工智能学的潜心钻研终于再度获得重大突破,大模型的涌现能力与AIGC的应用普及为那不一定是AGI但一定更AI的未来提供了确定性的加速度。AI2.0时代的加速到来,不仅是把AI能力融入到现有应用中,更是未来产业范式的再塑造。AI正跳跃式地加速渗透进各行各业,推动一场新的生产力与创造力革命。

喂给大模型语料——最初是维基百科和Reddit,后来扩展到音频、视觉图像甚至雷达和热图像——后者广义上说是换了种表达方式的语言。也因此有生成式AI的创业者认为,一个极度聪明的大语言模型就是那个通往AGI最终答案,多模态的研究道路只是目前对前者的底气不足。

21世纪是否是“生命科学的世纪”还是未知,但一定是AI大模型的世纪。 互联网头部企业纷纷发布大模型,产品呈全面开花之势;字节跳动创始人张一鸣公开表示字节跳动无法错过AIGC,挑灯夜读OpenAI的论文,并在卸任CEO两年后在香港成立个人投资基金Cool River Venture

幂律智能已经获得近百家互联网、制造业、连锁零售、金融、医疗等行业头部客户的认可,公司业务较去年增长超200%。

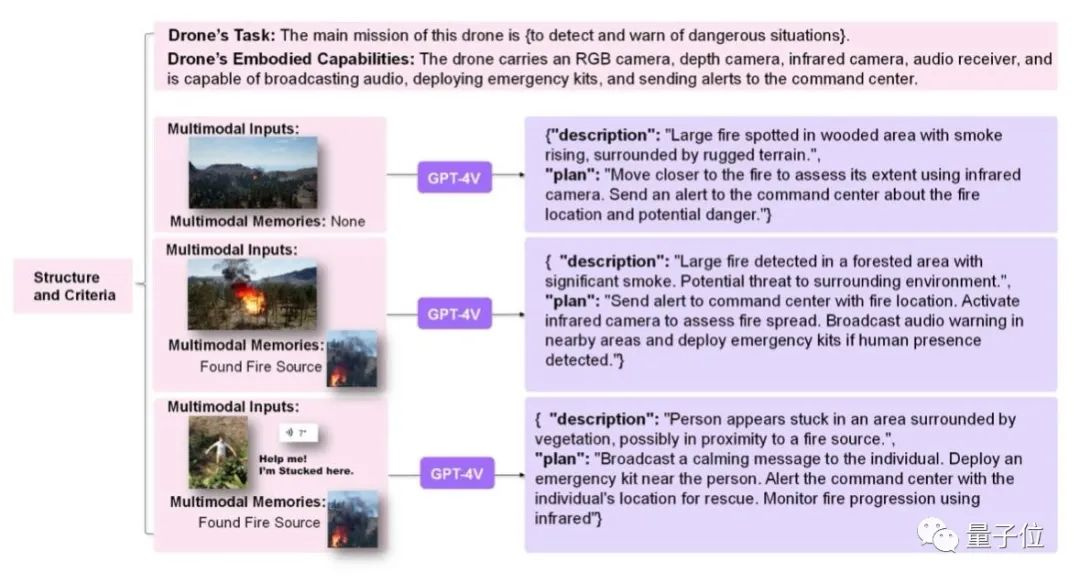

进入多模态时代,大模型也会操纵无人机了!只要视觉模块捕捉到启动条件,大模型这个“大脑”就会生成动作指令,接着无人机便能迅速准确地执行。

大模型创业,“最安全”的人来了!吴翰清,前阿里云首席安全科学家、P10级研究员在今年5月离职阿里后,现在被曝投身AI创业。