MIT斯坦福Transformer最新研究:过度训练让中度模型「涌现」结构泛化能力

MIT斯坦福Transformer最新研究:过度训练让中度模型「涌现」结构泛化能力过度训练让中度模型出现了结构泛化能力。

搜索

搜索

过度训练让中度模型出现了结构泛化能力。

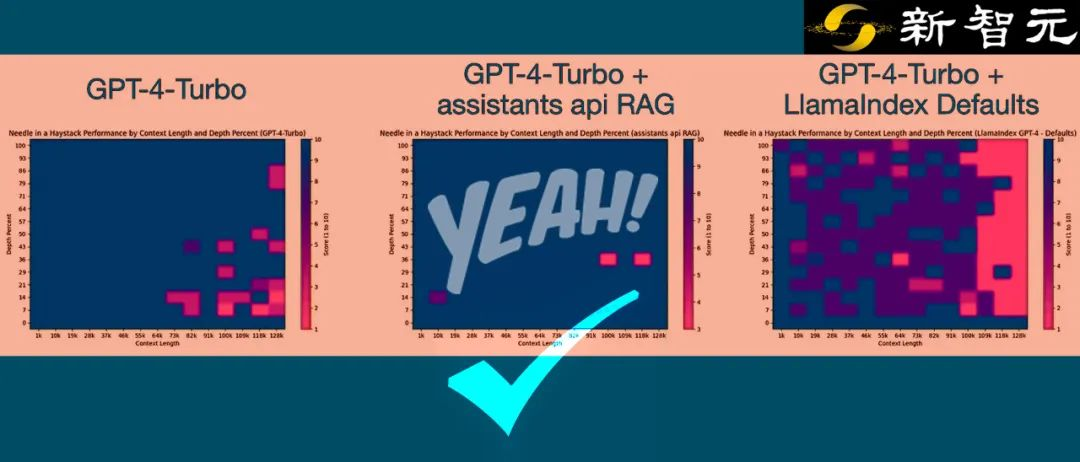

RAG或许就是大模型能力飙升下一个未来。RAG+GPT-4,4%的成本,便可拥有卓越的性能。

继谷歌DeepMind AI工具成功预测出220万种晶体结构后,微软团队最新扩散模型MatterGen,能设计生成新颖、稳定的材料,刷新SOTA。

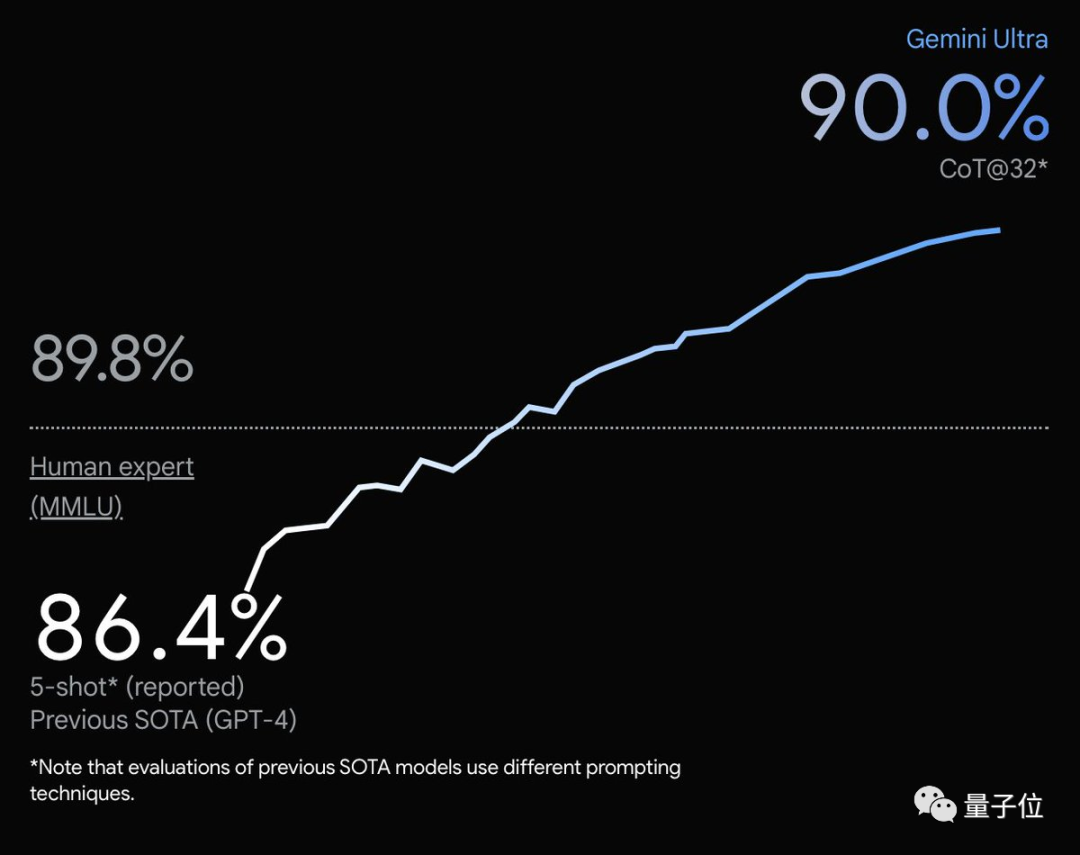

昨天深夜,Google 突然发布重磅 AI 杀手锏——Gemini。多模态 Gemini 可以理解、操作和结合不同类型的信息,包括文本、代码、音频、图像和视频。

时代变了?迄今为止规模最大,能力最强的谷歌大模型来了。当地时间 12 月 6 日,谷歌 CEO 桑达尔・皮查伊官宣 Gemini 1.0 版正式上线。

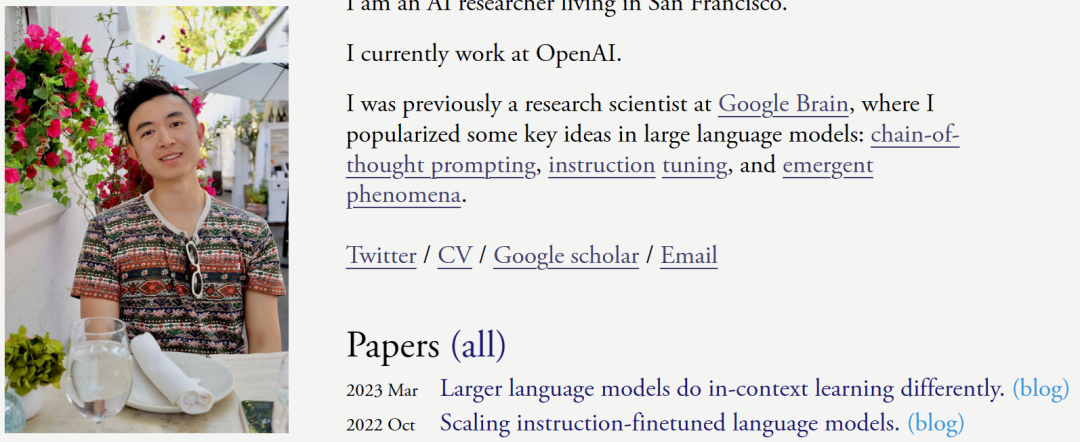

大模型究竟从下一个词预测任务中学到了什么呢?还记得 Jason Wei 吗?这位思维链的提出者还曾共同领导了指令调优的早期工作,并和 Yi Tay、Jeff Dean 等人合著了关于大模型涌现能力的论文。

谷歌憋了许久的大招,双子座Gemini大模型终于发布!其中一图一视频最引人注目:一图,MMLU多任务语言理解数据集测试,Gemini Ultra不光超越GPT-4,甚至超越了人类专家。

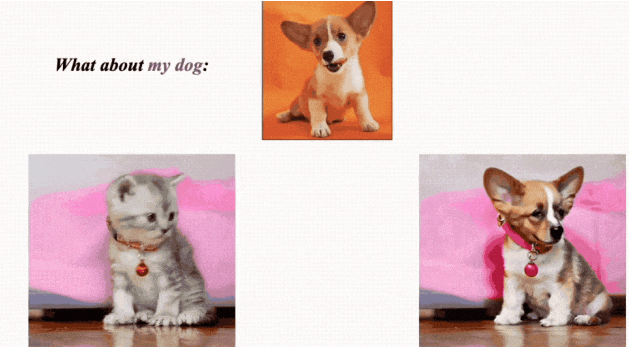

后期狂喜了家人们~现在,只需一张图片就能替换视频主角,效果还是如此的丝滑!且看这个叫做“VideoSwap”的新视频编辑模型——

苹果M系列芯片专属的机器学习框架,开源即爆火!现在,用上这个框架,你就能直接在苹果GPU上跑70亿参数大模型、训练Transformer模型或是搞LoRA微调。

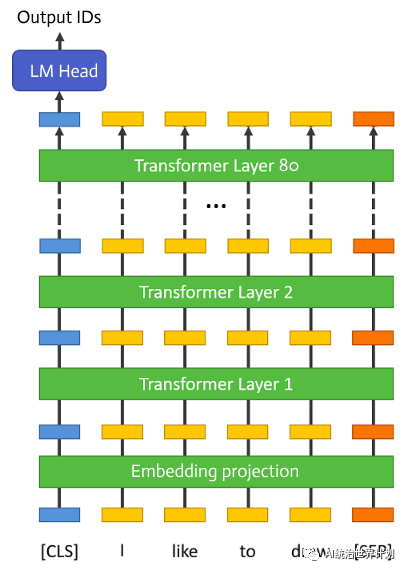

大语言模型需要消耗巨量的GPU内存。有可能一个单卡GPU跑推理吗?可以的话,最低多少显存?70B大语言模型仅参数量就有130GB,仅仅把模型加载到GPU显卡里边就需要2台顶配100GB内存的A100。