数据不够致Scaling Law撞墙?CMU和DeepMind新方法可让VLM自己生成记忆

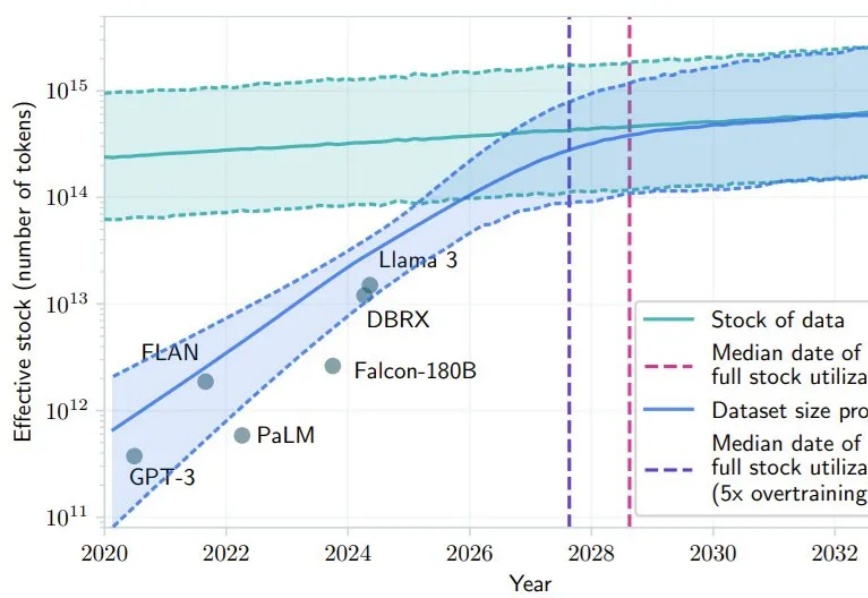

数据不够致Scaling Law撞墙?CMU和DeepMind新方法可让VLM自己生成记忆最近 AI 社区很多人都在讨论 Scaling Law 是否撞墙的问题。其中,一个支持 Scaling Law 撞墙论的理由是 AI 几乎已经快要耗尽已有的高质量数据,比如有一项研究就预计,如果 LLM 保持现在的发展势头,到 2028 年左右,已有的数据储量将被全部利用完。

最近 AI 社区很多人都在讨论 Scaling Law 是否撞墙的问题。其中,一个支持 Scaling Law 撞墙论的理由是 AI 几乎已经快要耗尽已有的高质量数据,比如有一项研究就预计,如果 LLM 保持现在的发展势头,到 2028 年左右,已有的数据储量将被全部利用完。

"机器究竟还需要多长时间,才能真正具备人类大脑的认知能力?"这个困扰人工智能领域数十年的根本性问题,在2024年末再次成为全球科技界的焦点。

继电动车、消费品之后,中国团队又在AI领域上演了一出“成本屠夫”的好戏。

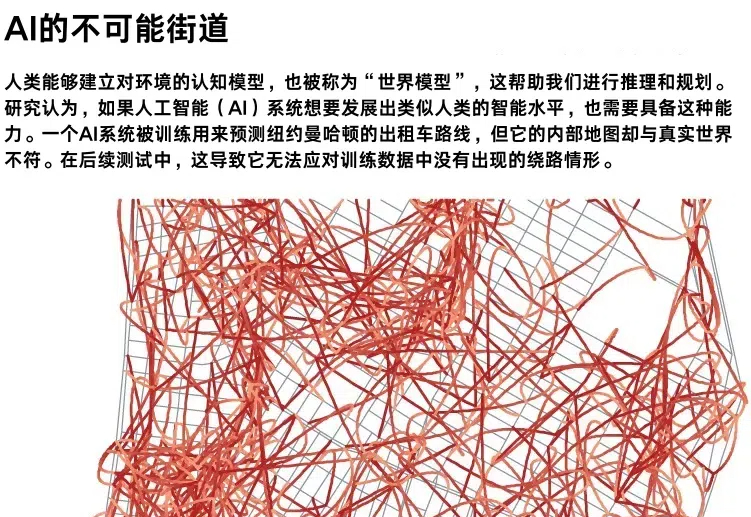

就在刚刚,噩耗传来:年仅41岁的谷歌DeepMind天才科学家Felix Hill英年早逝。

强强联合!

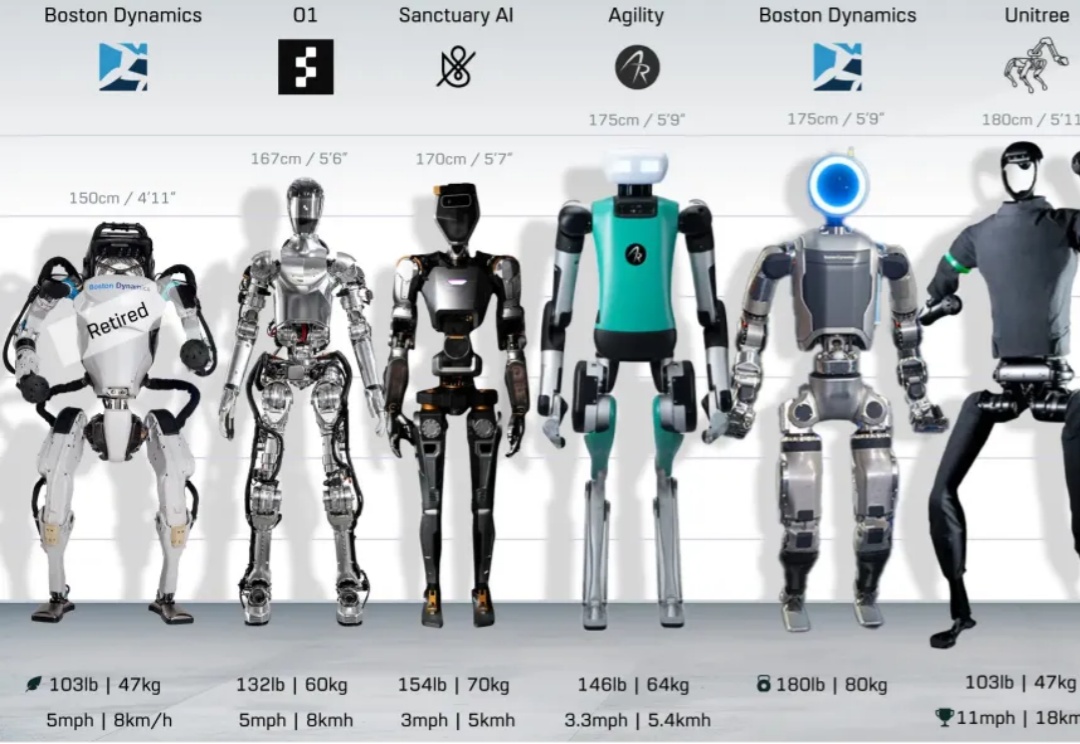

随着AI时代的到来,算法、大模型、深度学习等技术飞速发展,使得人形机器人成为了面向未来的黄金赛道。

基于大型定量模型,解决各行业的复杂科学和商业问题

2025 年即将到来的三大技术突破。

但咱觉得吧,显卡还是很重要的

过去一段时间,“预训练终结”成为了 AI 领域最热烈的讨论之一。OpenAI的GPT系列模型此前大踏步的前进,预训练是核心推动力。而前 OpenAI 首席科学家 Ilya Sutskever、预训练和scaling law(规模定律)最忠实的倡导者,却宣称预训练要终结了、scaling law要失效。由此,引发了大量争议。