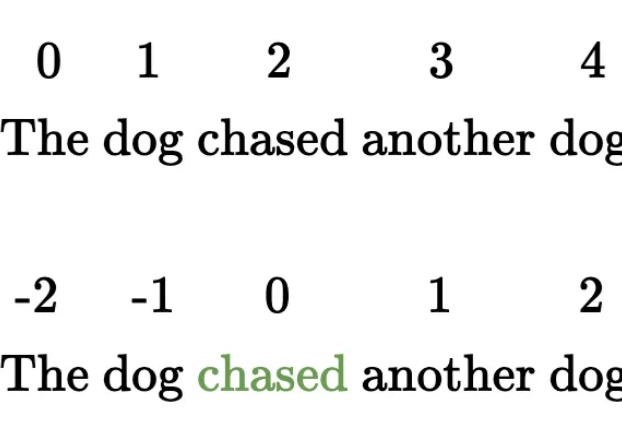

HuggingFace工程师亲授:如何在Transformer中实现最好的位置编码

HuggingFace工程师亲授:如何在Transformer中实现最好的位置编码一个有效的复杂系统总是从一个有效的简单系统演化而来的。——John Gall

一个有效的复杂系统总是从一个有效的简单系统演化而来的。——John Gall

完蛋了,高考落榜了!

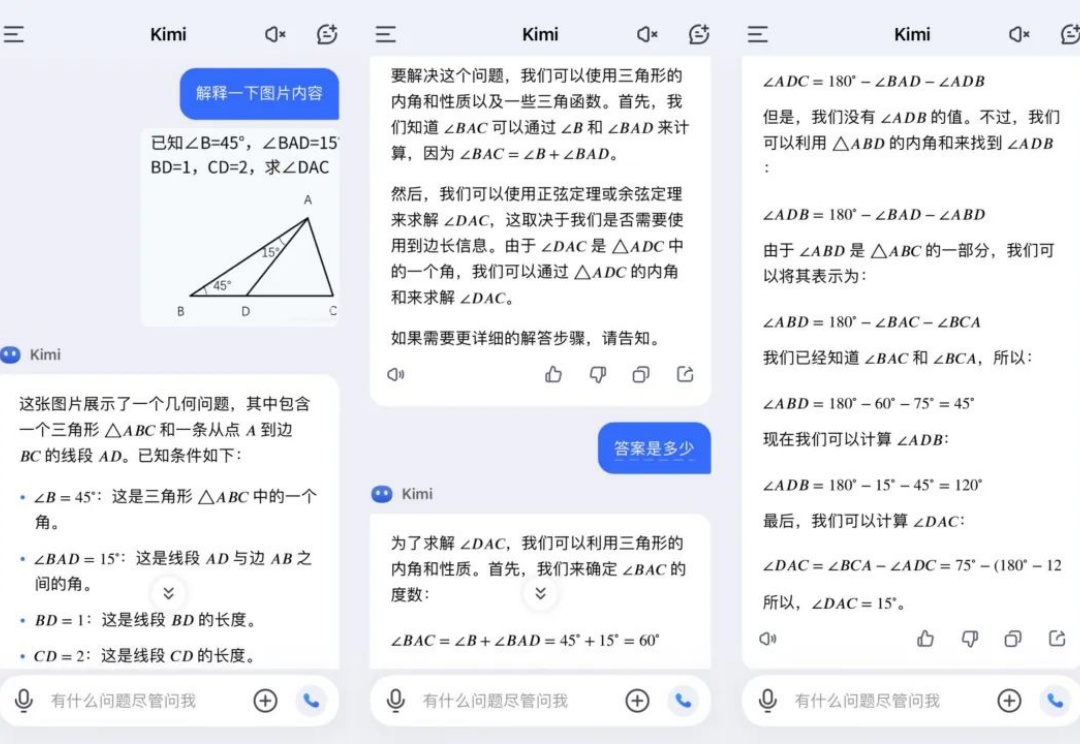

在当今多模态领域,CLIP 模型凭借其卓越的视觉与文本对齐能力,推动了视觉基础模型的发展。CLIP 通过对大规模图文对的对比学习,将视觉与语言信号嵌入到同一特征空间中,受到了广泛应用。

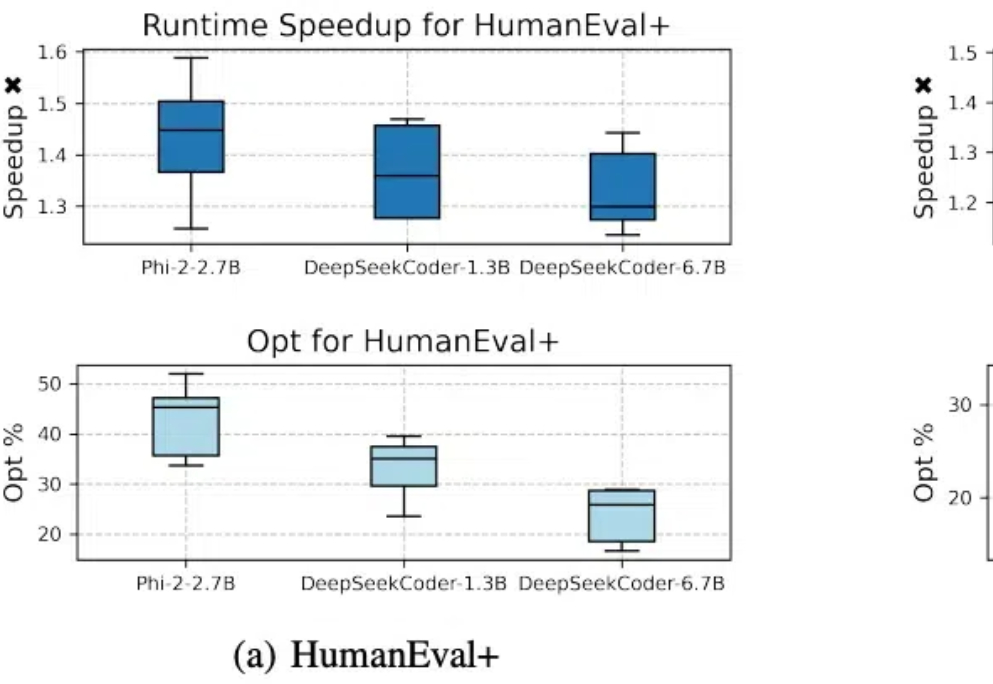

代码模型SFT对齐后,缺少进一步偏好学习的问题有解了。 北大李戈教授团队与字节合作,在模型训练过程中引入偏好学习,提出了一个全新的代码生成优化框架——CodeDPO。

只要改一行代码,就能让大模型训练效率提升至1.47倍。

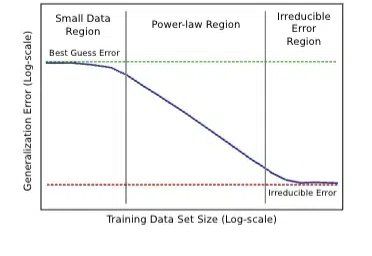

什么?Scaling Law最早是百度2017年提的?! Meta研究员翻出经典论文: 大多数人可能不知道,Scaling law原始研究来自2017年的百度,而非三年后(2020年)的OpenAI。

家人们,国产o1大模型,最近着实是有点火啊。 就在今天,昆仑万维的Skywork o1也开启了邀测。 那一波实测,这不就得安排一下么。

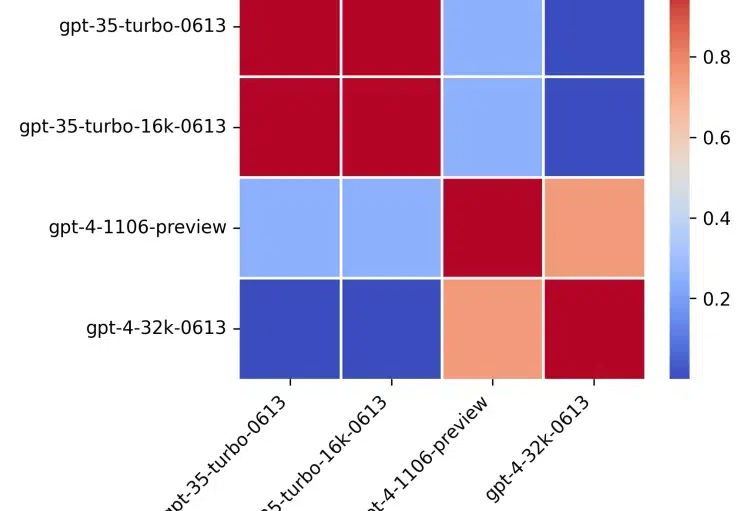

这篇文章研究了提示格式对大型语言模型(LLM)性能的影响。

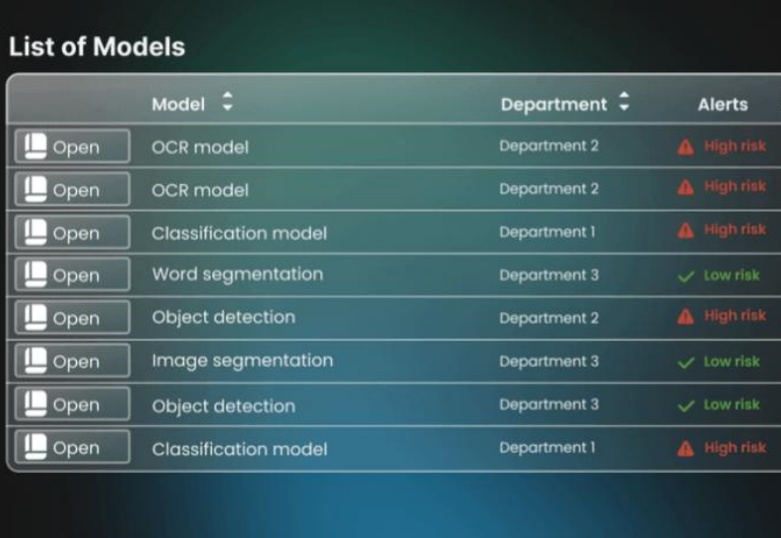

获评2024年度模型风险管理产品。

2022 年,以ChatGPT 大语言模型(LLM)的发布为标志, AI 神经网络的类人学习能力取得了里程碑式的进展,在全球范围内掀起了一股 AI 热潮。