大模型训练成本降一半!厦大和vivo联合推出预训练新策略,给LLM降本增效

大模型训练成本降一半!厦大和vivo联合推出预训练新策略,给LLM降本增效近年来,大语言模型(Large Language Models, LLMs)的研究取得了重大进展,并对各个领域产生了深远影响。然而,LLMs的卓越性能来源于海量数据的大规模训练,这导致LLMs的训练成本明显高于传统模型。

近年来,大语言模型(Large Language Models, LLMs)的研究取得了重大进展,并对各个领域产生了深远影响。然而,LLMs的卓越性能来源于海量数据的大规模训练,这导致LLMs的训练成本明显高于传统模型。

上周Anthropic发布了Claude 3.5 Sonnet的升级,让AI助手能够通过"电脑使用"功能直接与计算机交互。

自去年底以来,时序预测领域正在经历重大转型,从传统的「单一数据集训练单一模型」的模式逐步转向「通用预测基础模型」。

个性化精品数字人(Personalized Talking Face Generation)强调合成的数字人视频在感官上与真人具有极高的相似性(不管是说话人的外表还是神态)。

大模型固然性能强大,但限制也颇多。如果想在端侧塞进 405B 这种级别的大模型,那真是小庙供不起大菩萨。近段时间,小模型正在逐渐赢得人们更多关注。这一趋势不仅出现在语言模型领域,也出现在了机器人领域。

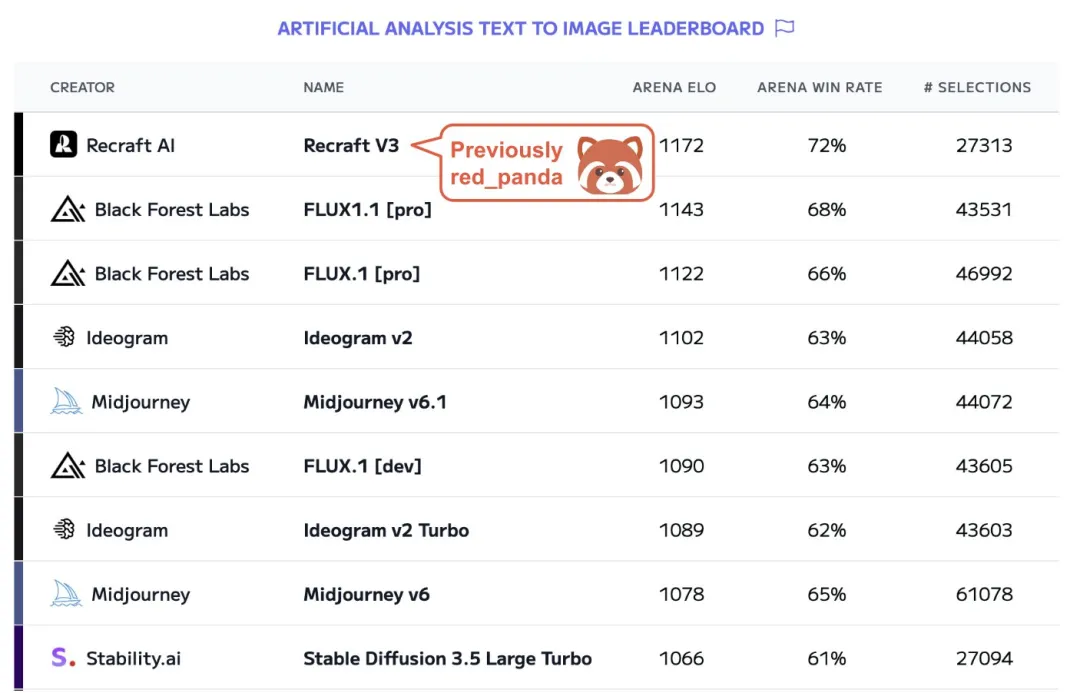

前几天在 Hugging Face 文本转图像排行榜上排名第一的 red_panda,是一个名为 Recraft V3 的模型,由 AI 初创公司 Recraft 提供。 Recraft V3 以 1172 的 ELO 评分位居第一,超越了 Midjourney、OpenAI 和其他公司的模型。

清华大学推出的SonicSim平台和SonicSet数据集针对动态声源的语音处理研究提供了强有力的工具和数据支持,有效降低了数据采集成本,实验证明这些工具能有效提升模型在真实环境中的性能。

三个月前,「LiblibAI 哩布哩布 AI」,一个 AI 模型社区型产品,在一年内完成了三轮共计数亿元的融资。

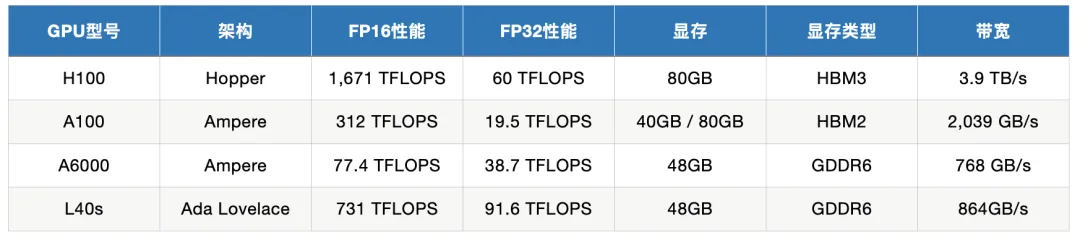

通过深入分析这些 GPU 的性能指标,我们将探讨它们在模型训练和推理任务中的适用场景,以帮助用户在选择适合的 GPU 时做出明智的决策。同时,我们还会给出一些实际有哪些知名的公司或项目在使用这几款 GPU。

大家好!非常荣幸和大家分享一些我对未来社会中人机协作的想法。