RL 是 LLM 的新范式

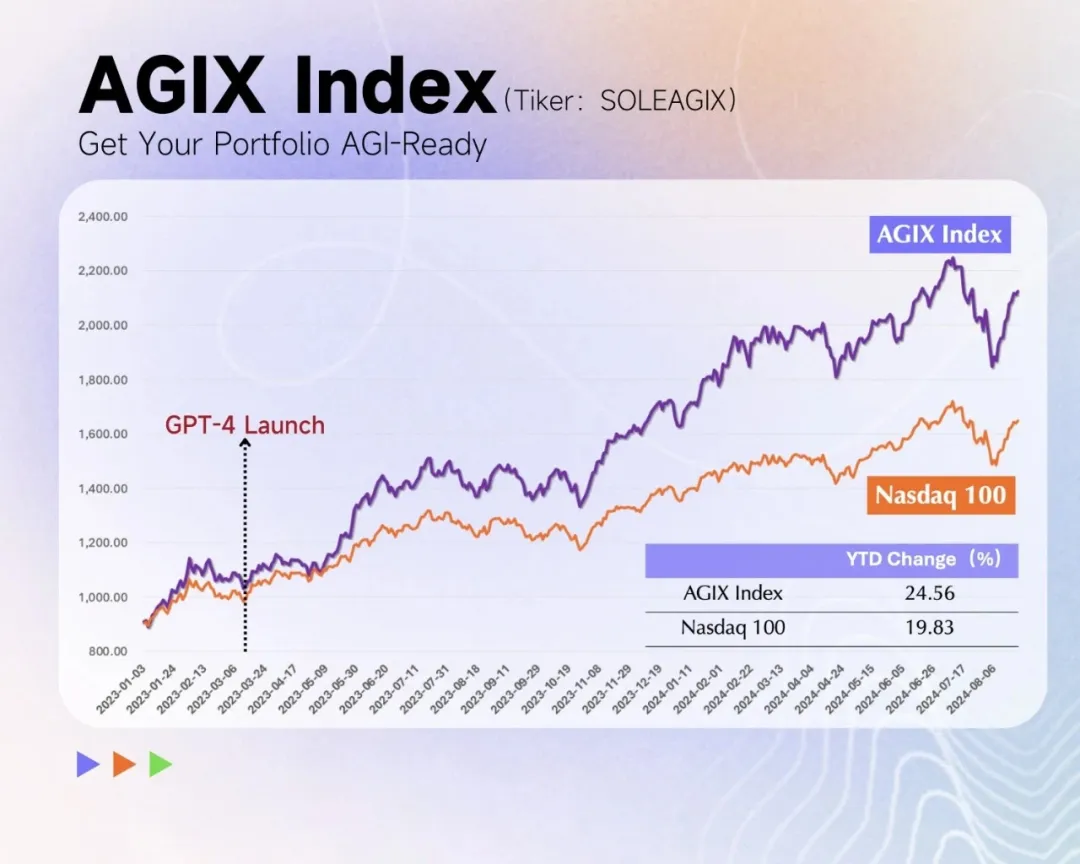

RL 是 LLM 的新范式AGI 正在迎来新范式,RL 是 LLM 的秘密武器。

AGI 正在迎来新范式,RL 是 LLM 的秘密武器。

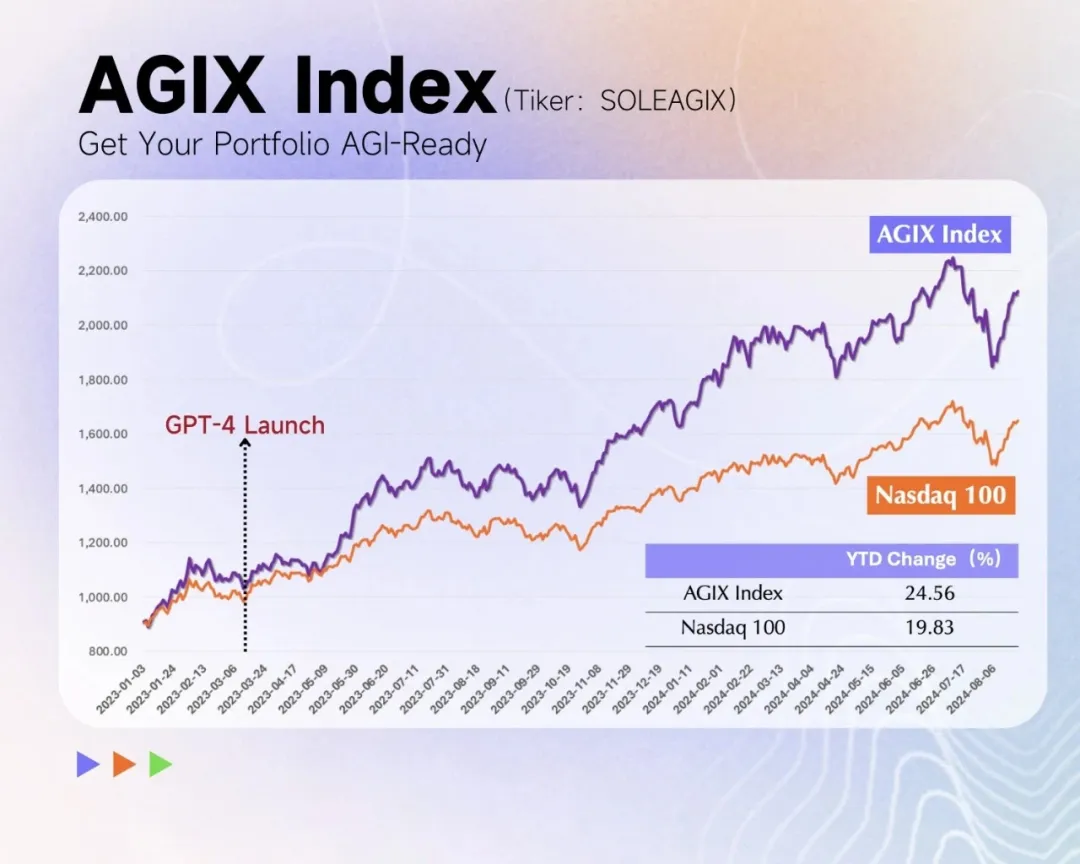

通过600多天里的大模型中标项目,我们看到了什么?

计算机是二进制的世界,所以浮点数也是用二进制来表示的,与整型不同的是,浮点数通过3个区间来表示:

近日,开源社区又迎来一款强力的「视频生成」工作,可以在消费级显卡 (如 GeForce RTX 3090) 上生成任意分辨率、任意宽高比、不同风格、不同运动幅度的视频,其衍生模型还能够完成视频扩展、视频回溯的功能…… 这便是 360AI 团队和中山大学联合研发的 FancyVideo,一种基于 UNet 架构的视频生成模型。

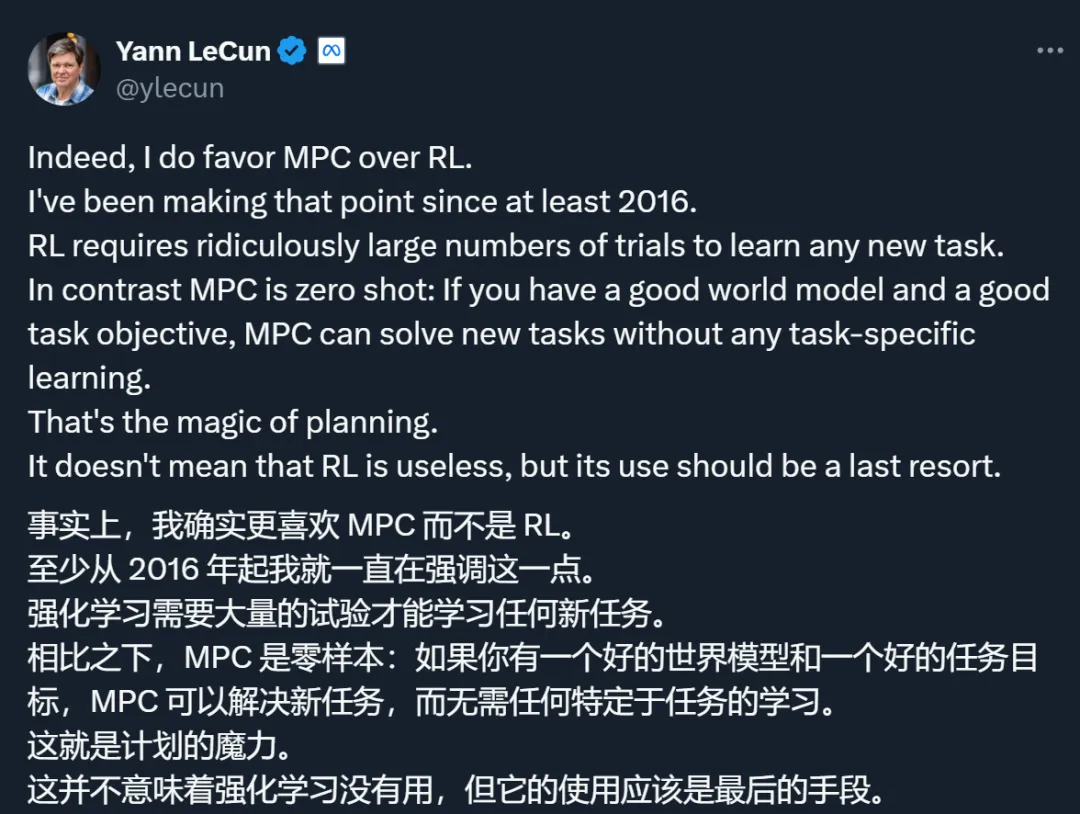

「相比于强化学习(RL),我确实更喜欢模型预测控制(MPC)。至少从 2016 年起,我就一直在强调这一点。强化学习在学习任何新任务时都需要进行极其大量的尝试。相比之下,模型预测控制是零样本的:如果你有一个良好的世界模型和一个良好的任务目标,模型预测控制就可以在不需要任何特定任务学习的情况下解决新任务。这就是规划的魔力。这并不意味着强化学习是无用的,但它的使用应该是最后的手段。」

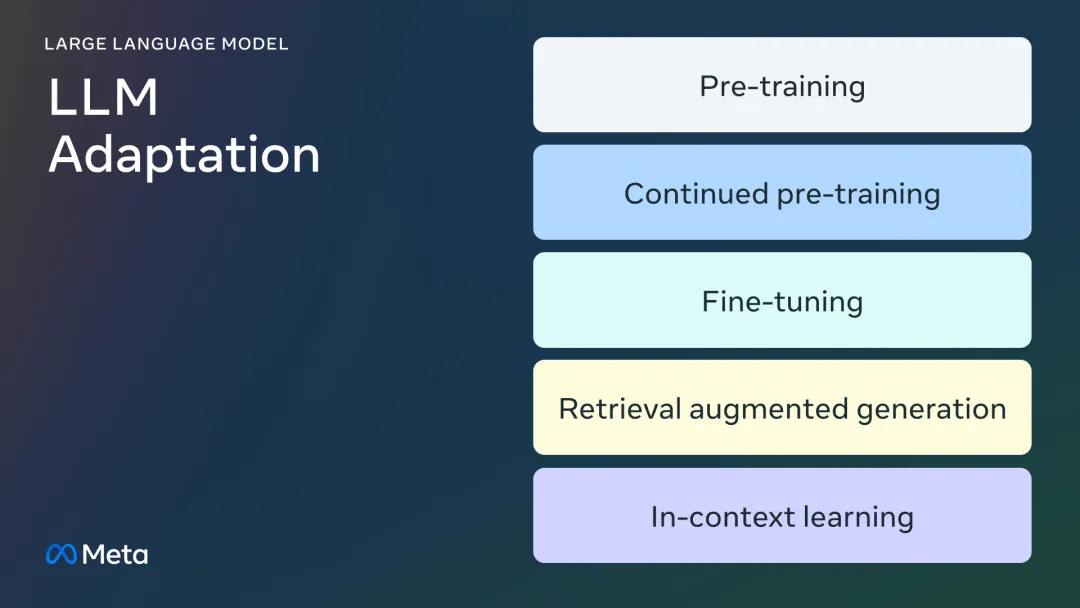

微调的所有门道,都在这里了。

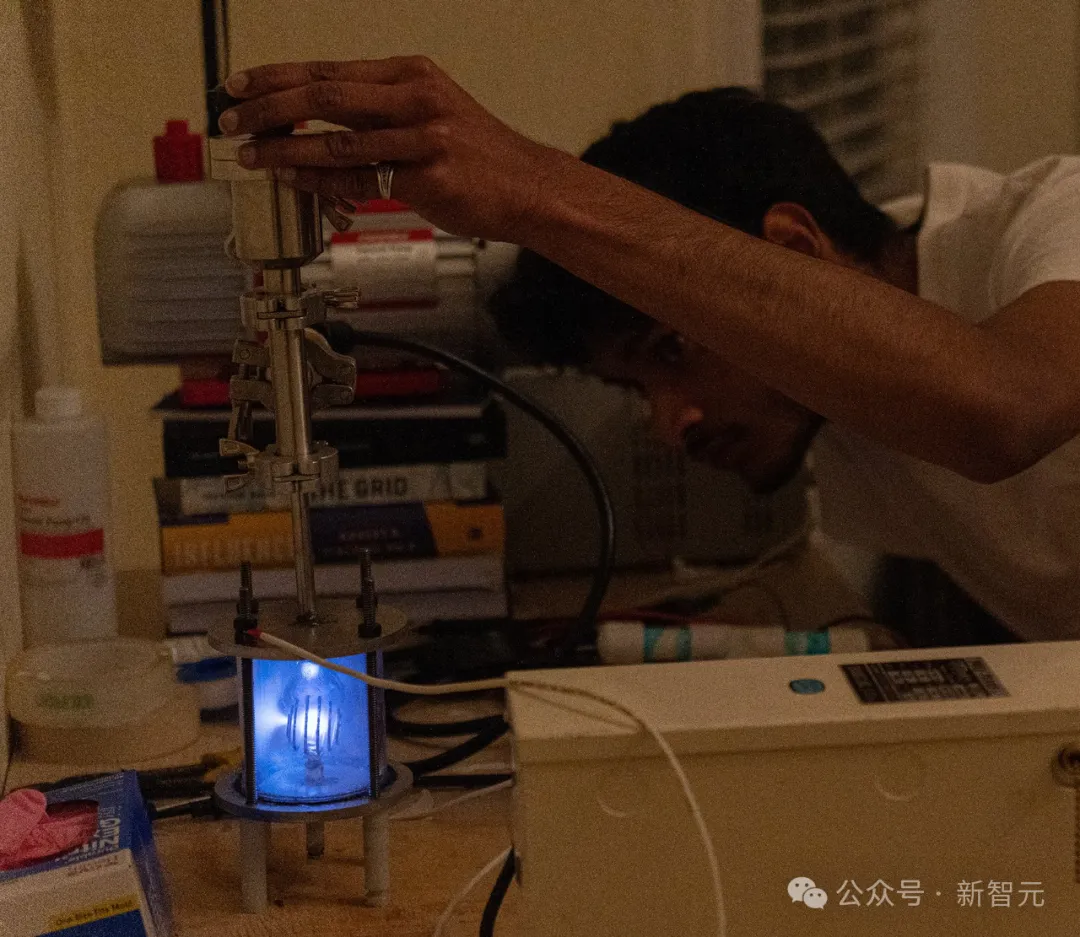

前段时间,Claude 3.5帮助右手骨折工程师一周肝出3000行代码。现在,又有00后数学系本科生借助AI,用了一个月时间,在自家卧室手搓「核聚变反应堆」,震惊一大波网友。

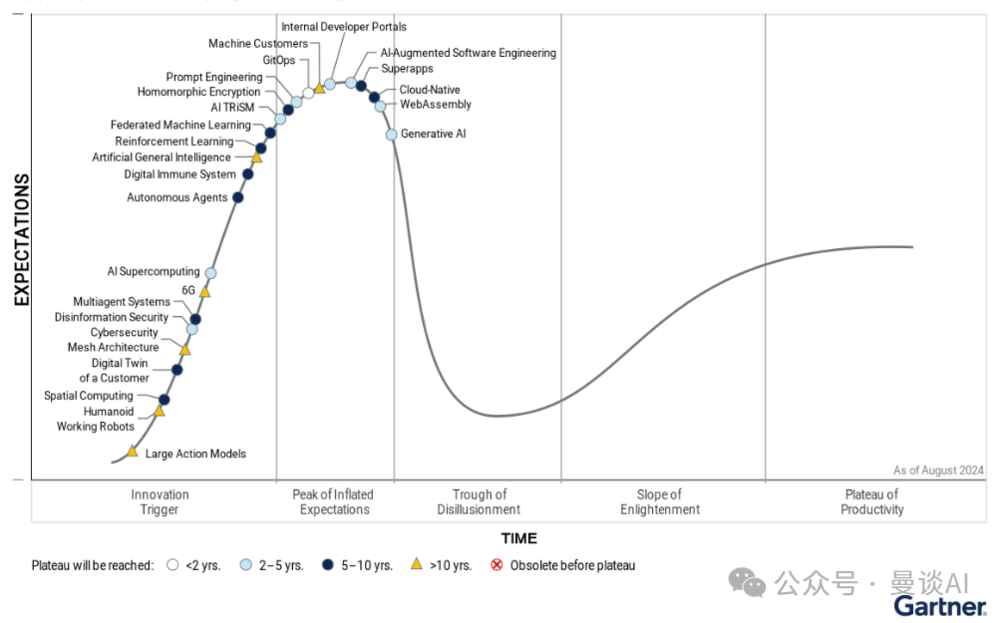

生成式AI需克服成本、可靠性、隐私等五大挑战,产品变革仍在初期。 • 成本问题阻碍了生成式AI的广泛应用。 • 隐私和安全性成为AI助手普及的主要障碍。 • 企业需在AI商业化过程中重视用户需求。

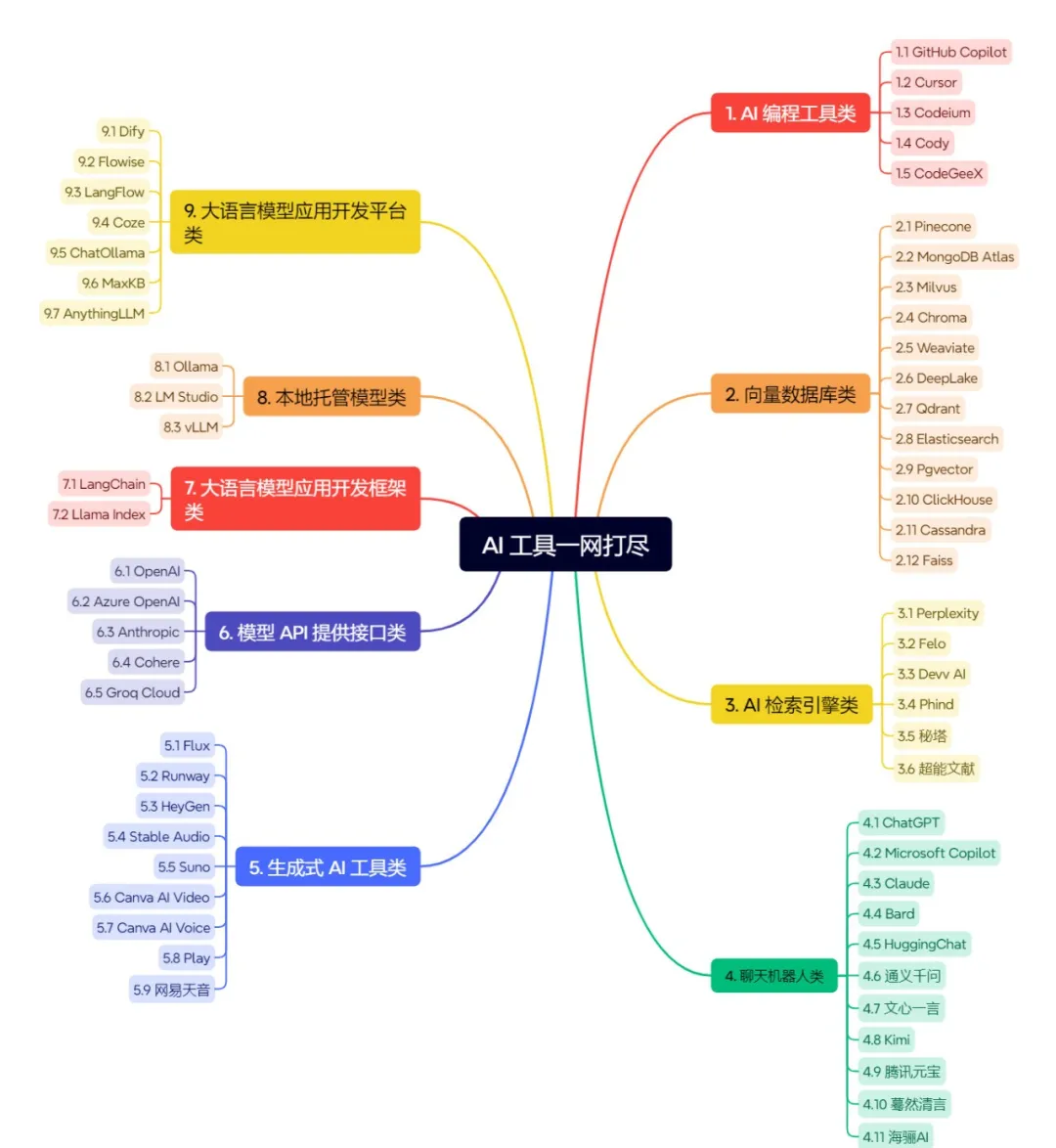

在当今人工智能领域,大语言模型及其相关工具正在迅速发展,涵盖了编程、数据库、检索引擎、聊天机器人、生成式 AI 工具、模型 API、开发框架和平台等各个方面。

前两天Ideogram 更新了 2.0版本,并且现在可以免费体验。