Mamba一作再祭神作,H100利用率飙至75%!FlashAttention三代性能翻倍,比标准注意力快16倍

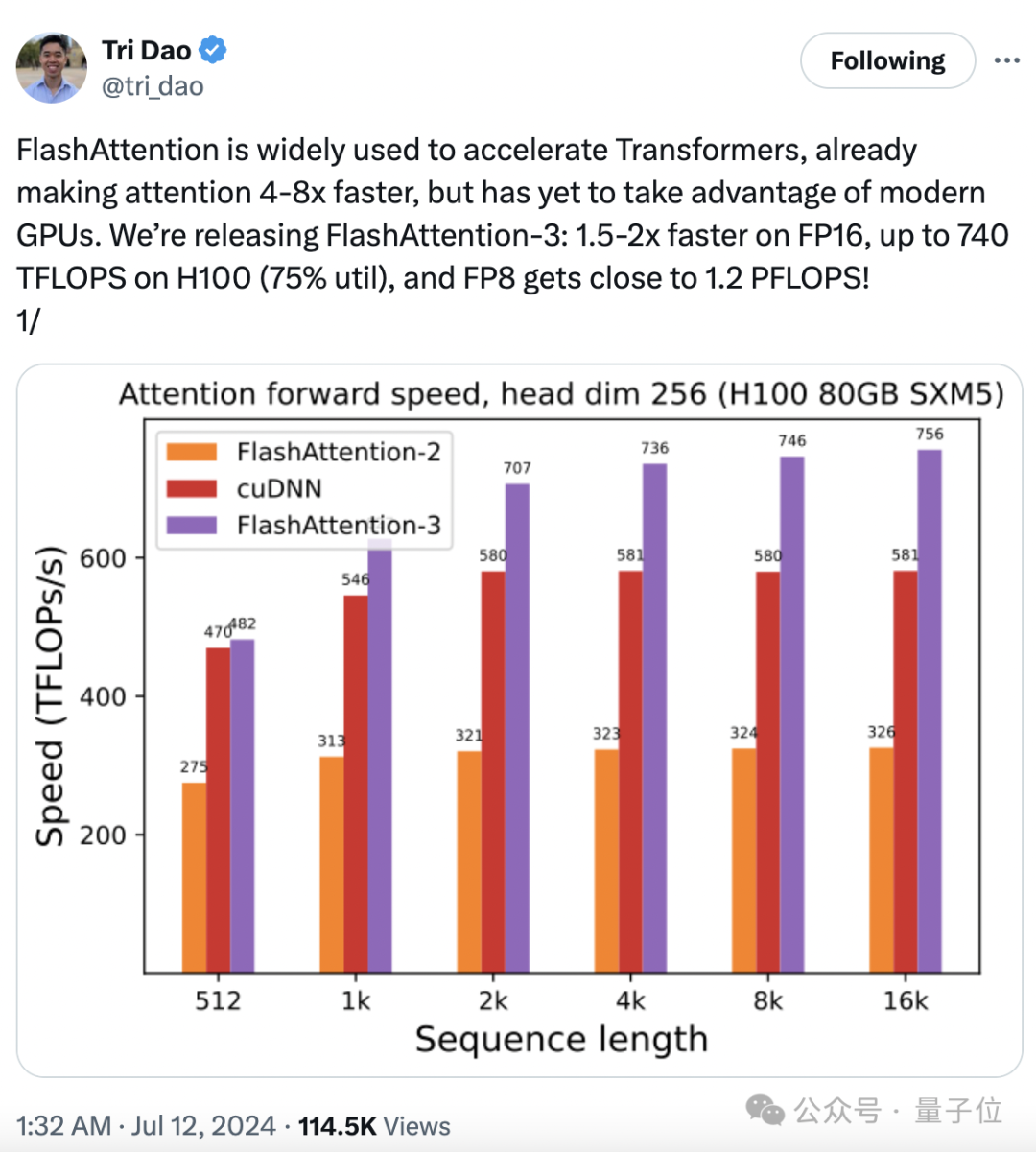

Mamba一作再祭神作,H100利用率飙至75%!FlashAttention三代性能翻倍,比标准注意力快16倍时隔一年,FlashAttention又推出了第三代更新,专门针对H100 GPU的新特性进行优化,在之前的基础上又实现了1.5~2倍的速度提升。

来自主题: AI技术研报

10521 点击 2024-07-12 16:57

搜索

搜索

时隔一年,FlashAttention又推出了第三代更新,专门针对H100 GPU的新特性进行优化,在之前的基础上又实现了1.5~2倍的速度提升。

近两年最热的赛道就是 AI 了,我们技术团队早在去年上半年就开始布局相关的技术研究,但现在一年多时间过去了,产品上却迟迟没有做任何与 AI 相关的功能。

这期对谈如果要提炼出一个核心观点,我想就是——人工智能的持续进步,现在需要开创性的用户界面和产品体验,但这不只是一个技术活儿,也是一个艺术活儿,才能把尖端科技用柔软轻盈的方式带入到大众的生活里。

芯片巨头AMD刚刚官宣要再做大做强:

大模型训练推理神作,又更新了!

“让个人按照自己的方式探索世界,重新定义旅行。”

科技巨头计划在未来几年在AI资本支出上花费1万亿美元,但几乎没有任何实质性的、可见的成果来证明这些投入是值得的。

人工智能安全已经来到临界点

评估大模型是否诚实的基准来了!

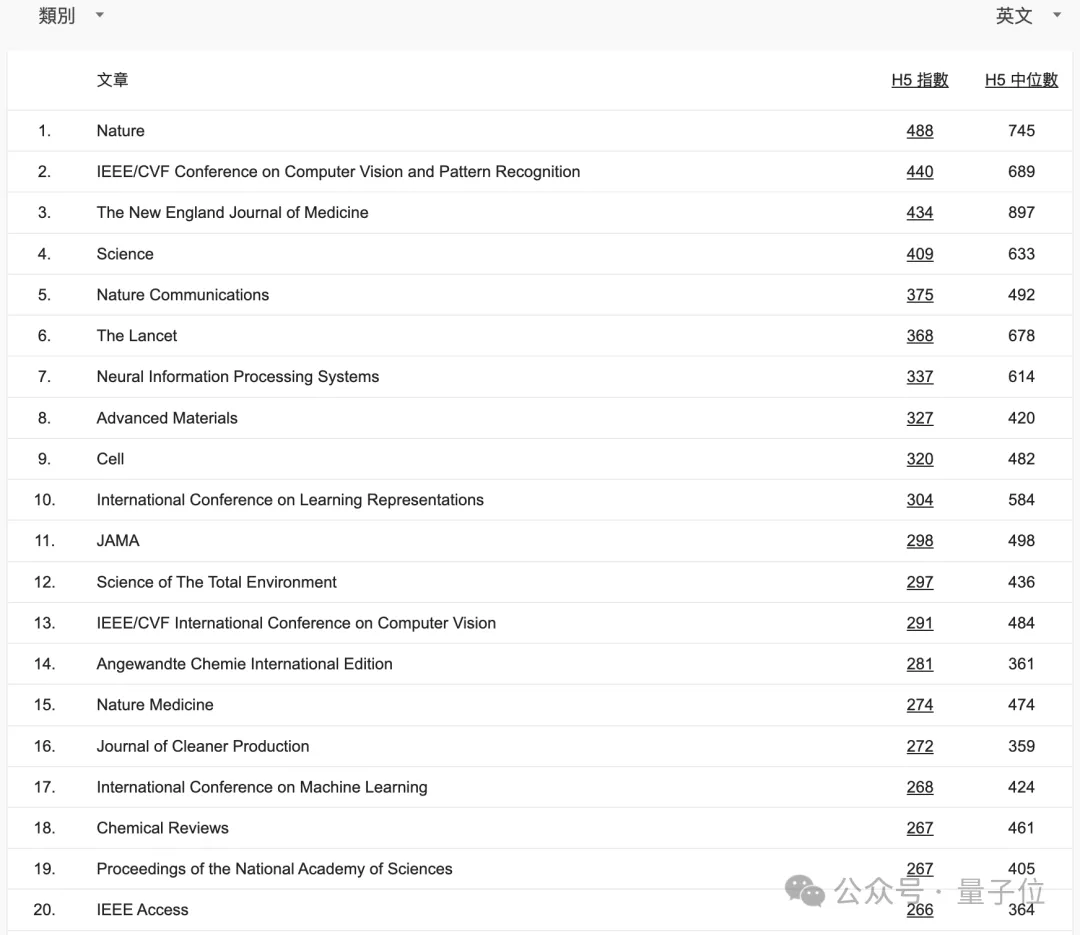

2024谷歌学术指标(Google Scholar Metrics)出炉,AI顶会掀起狂欢—— CVPR成为第二大学术出版物,超越Science,仅次于Nature。