免费!国产大模型编程助手豆包MarsCode重磅上线,还有登录即用的云端IDE

免费!国产大模型编程助手豆包MarsCode重磅上线,还有登录即用的云端IDE因为 AI 为自己的工作焦虑,这件事不是一天两天了。

搜索

搜索

因为 AI 为自己的工作焦虑,这件事不是一天两天了。

AI 考古,追溯到了祖师爷头上。

神经网络通常由三部分组成:线性层、非线性层(激活函数)和标准化层。线性层是网络参数的主要存在位置,非线性层提升神经网络的表达能力,而标准化层(Normalization)主要用于稳定和加速神经网络训练,很少有工作研究它们的表达能力,例如,以Batch Normalization为例

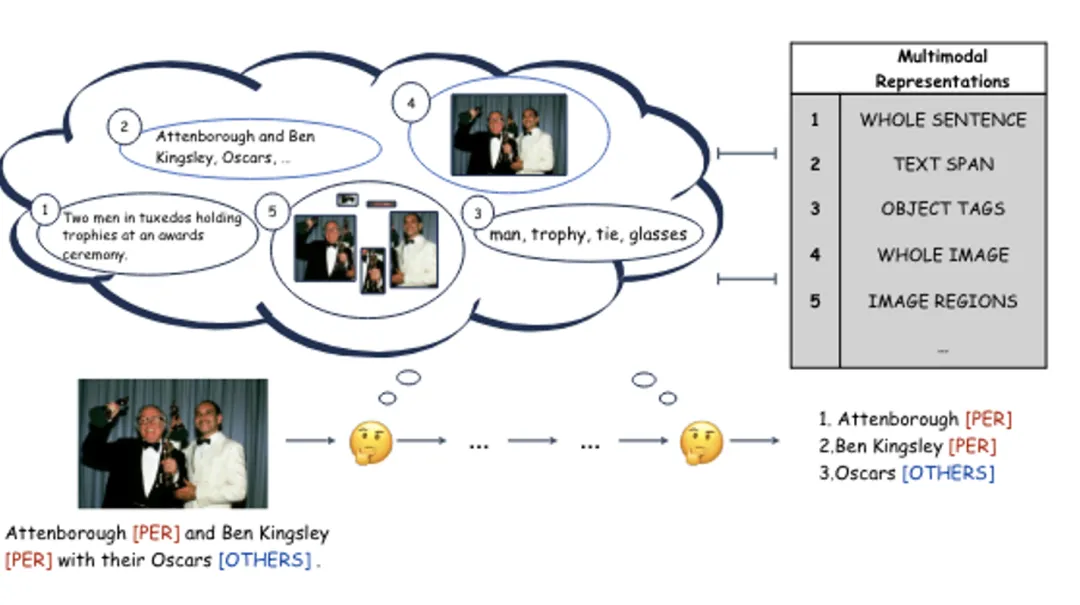

多模态命名实体识别,作为构建多模态知识图谱的一项基础而关键任务,要求研究者整合多种模态信息以精准地从文本中提取命名实体。尽管以往的研究已经在不同层次上探索了多模态表示的整合方法,但在将这些多模态表示融合以提供丰富上下文信息、进而提升多模态命名实体识别的性能方面,它们仍显不足。

「微调你的模型,获得比GPT-4更好的性能」不只是说说而已,而是真的可操作。最近,一位愿意动手的ML工程师就把几个开源LLM调教成了自己想要的样子。

两年一届的ECCV录用结果终于揭晓了!刚刚,ECCV组委会公布了录用论文名单,共有2395篇论文被录用。

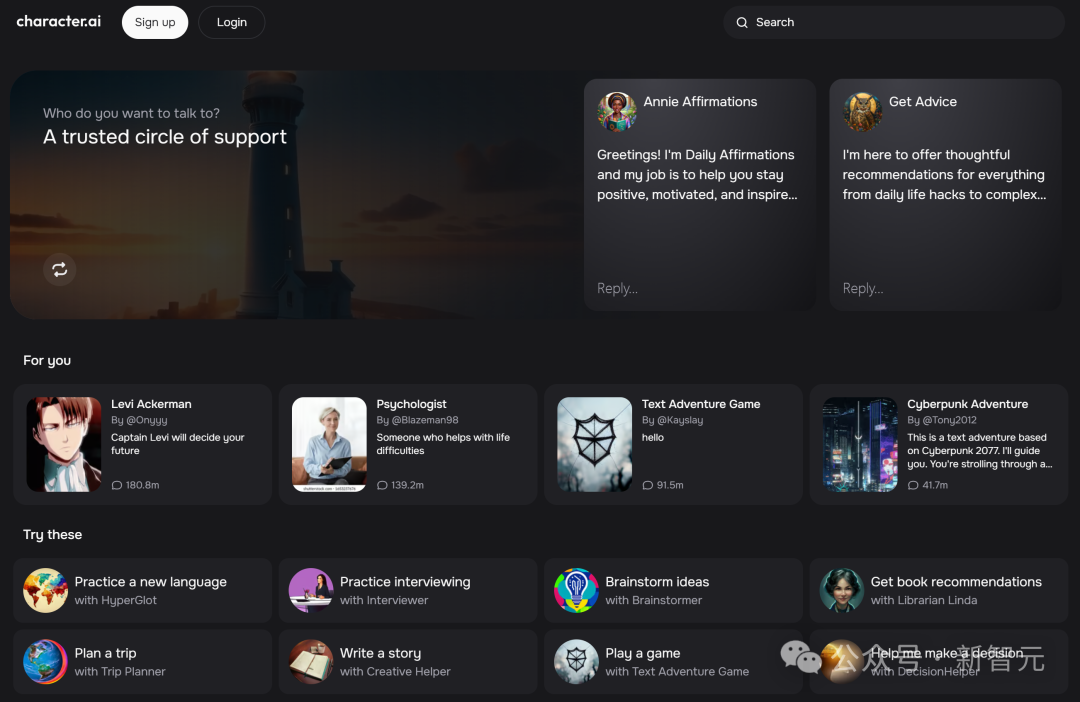

最近,在美国00后中爆火的Character AI,竟然把聊天机器人对话模型给「阉割」了?愤怒的年轻人们冲进社区,抱怨的声浪快要掀翻天了!而这背后,似乎还有谷歌或Meta的授意。

中国的大模型已经在春天了。

本文研究发现大语言模型在持续预训练过程中出现目标领域性能先下降再上升的现象。

导读:时隔4个月上新的Gemma 2模型在LMSYS Chatbot Arena的排行上,以27B的参数击败了许多更大规模的模型,甚至超过了70B的Llama-3-Instruct,成为开源模型的性能第一!