2024 H1 「中国最具价值 AGI 创新机构 TOP 50」 发布

2024 H1 「中国最具价值 AGI 创新机构 TOP 50」 发布大模型的盛宴,不应该只属于那些无数光环加身的算法天才们。

搜索

搜索

大模型的盛宴,不应该只属于那些无数光环加身的算法天才们。

在当今的多模态大模型的发展中,模型的性能和训练数据的质量关系十分紧密,可以说是 “数据赋予了模型的绝大多数能力”。

上下文学习 (in-context learning, 简写为 ICL) 已经在很多 LLM 有关的应用中展现了强大的能力,但是对其理论的分析仍然比较有限。人们依然试图理解为什么基于 Transformer 架构的 LLM 可以展现出 ICL 的能力。

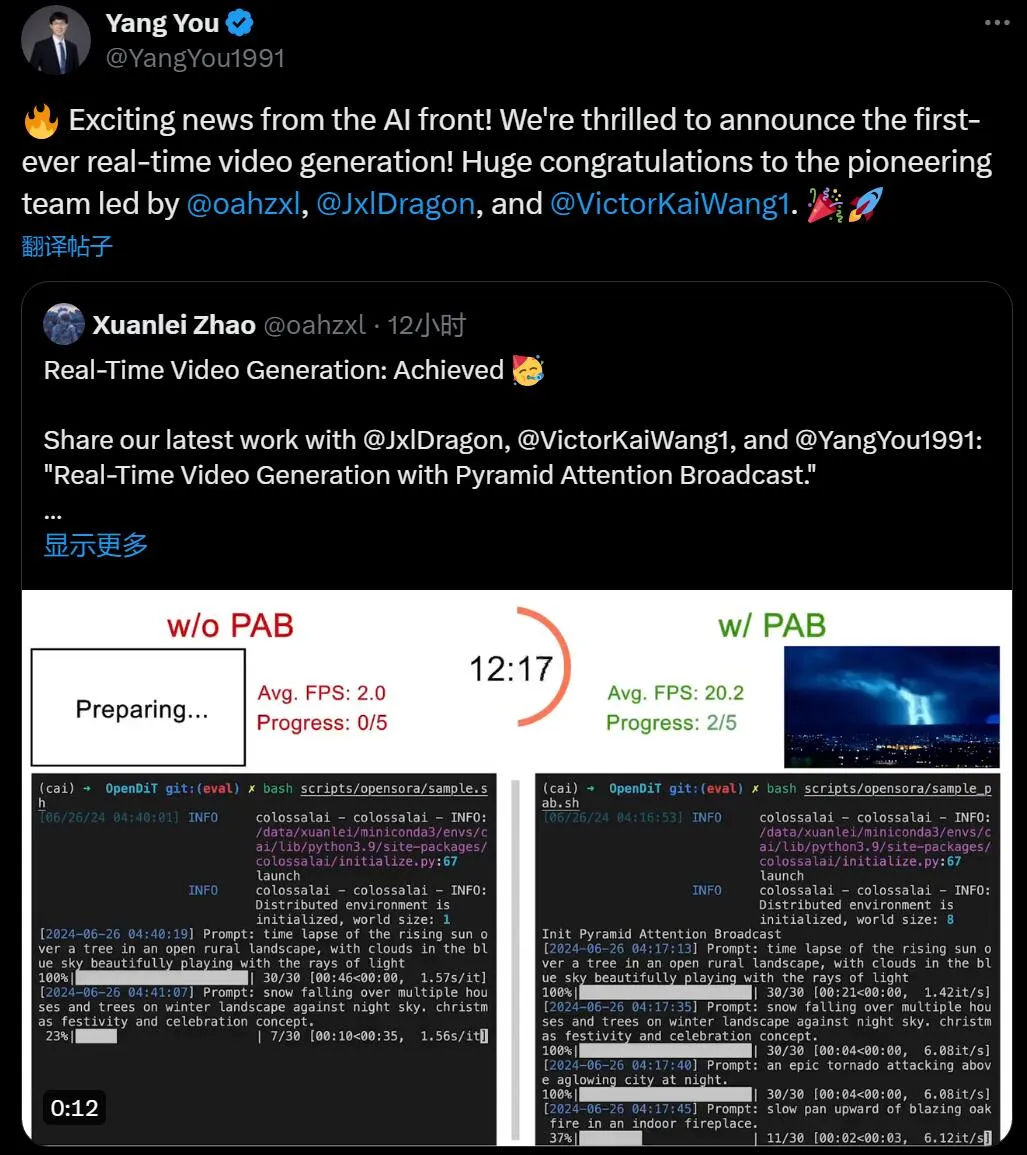

DiT 都能用,生成视频无质量损失,也不需要训练。

国内大模型的能力,又来到了一个新高度!

轰轰烈烈的大模型浪潮,似乎正在进入一个煎熬期。6 月中旬,微软发布了一个出人意料的消息,他们将于 7 月份停止其推出仅三个月的 Copilot GPTs 服务。

处理单张切片用时不到30秒,「透彻未来」推进AI病理诊断与数智化转型。

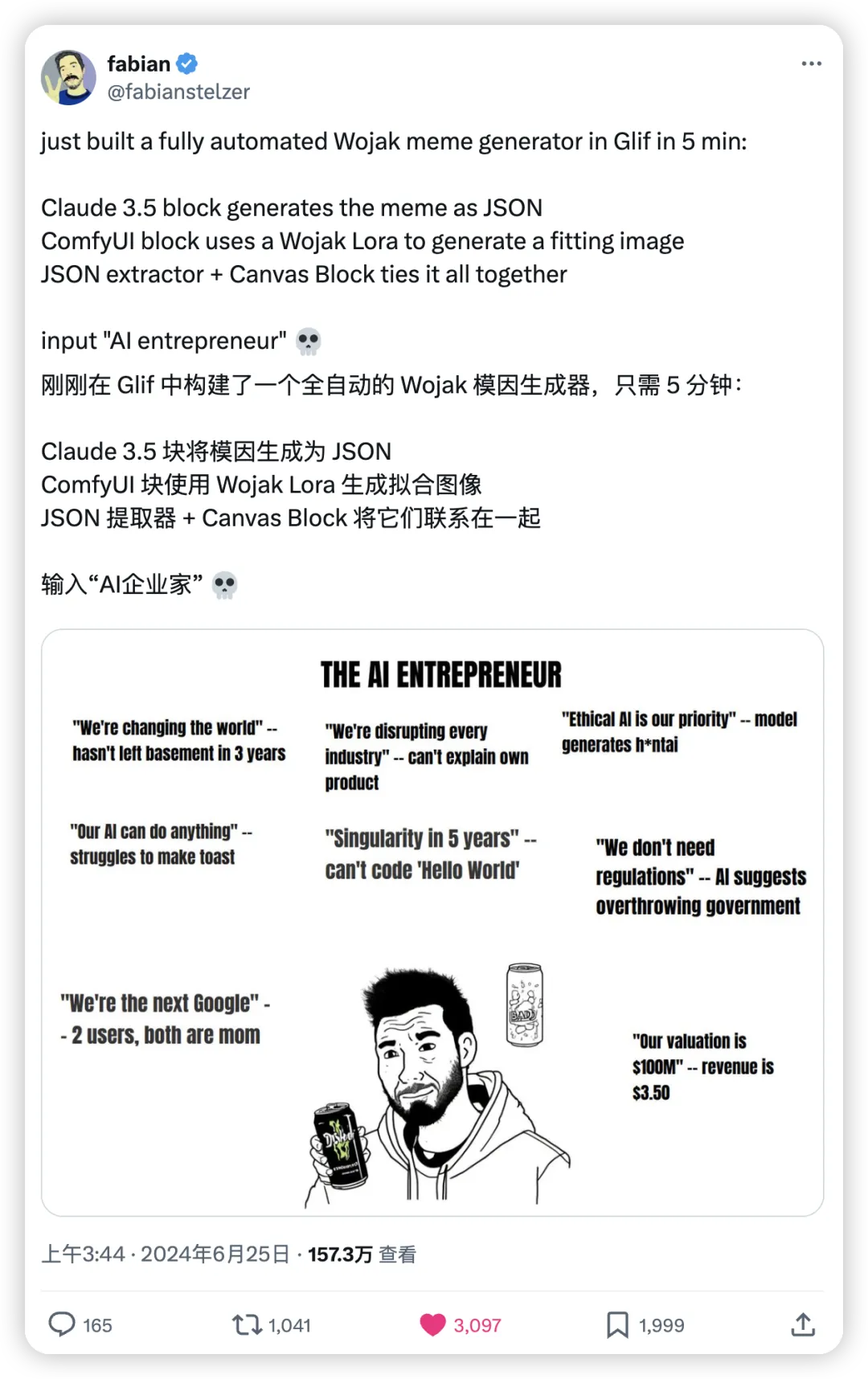

推特上有这么一个作者,今天早上只用了五分钟,使用了 Claude 3.5、ComfyUI、JSON 提取器等模块,搭建了个生成 meme 梗图的生成器,截止目前已经 157.3w 人看过。

面对层出不穷的个性化图像生成技术,一个新问题摆在眼前:缺乏统一标准来衡量这些生成的图片是否符合人们的喜好。对此,来自清华、西交大、伊利诺伊厄巴纳-香槟分校、中科院、旷视的研究人员共同推出了一项新基准DreamBench++。

大模型趋势的风向,开始变了。