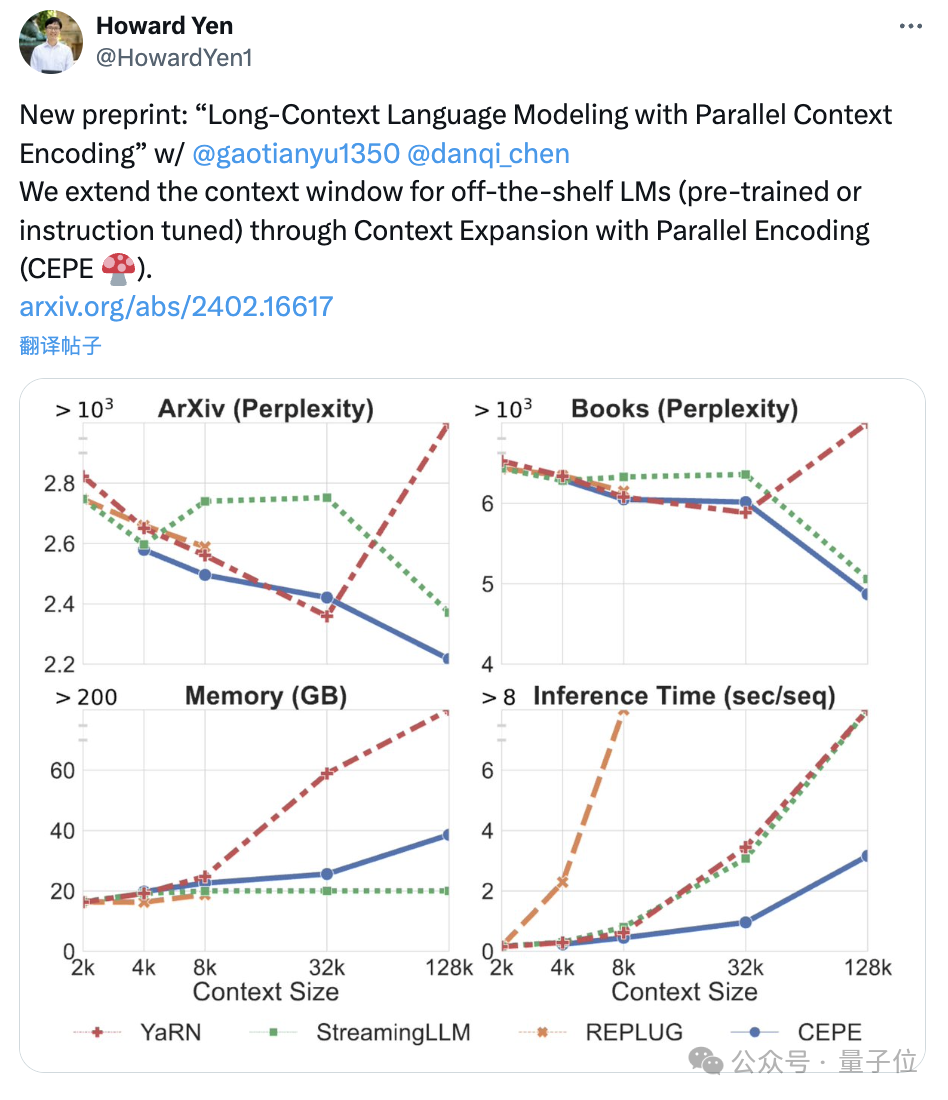

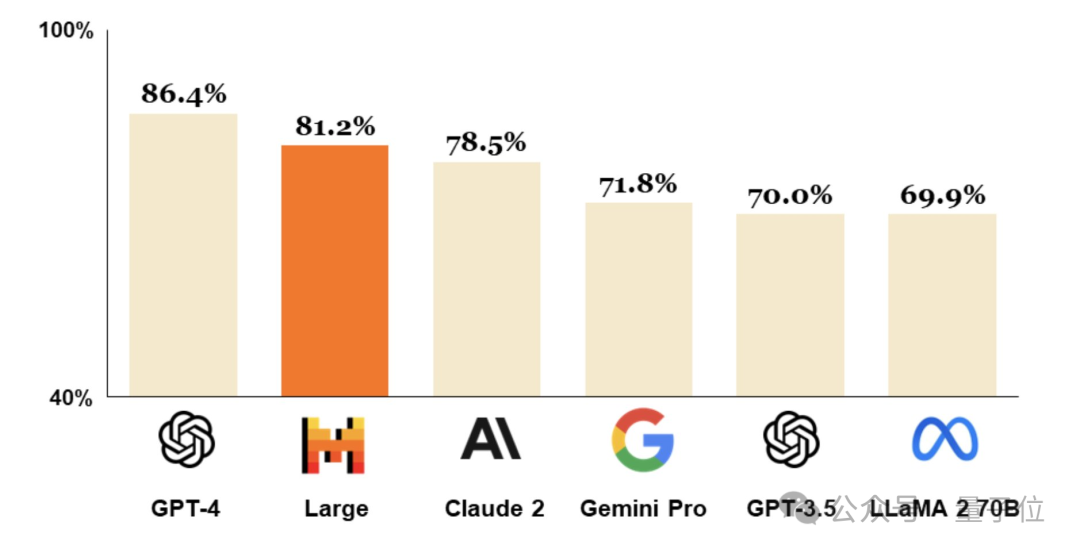

陈丹琦团队新作:Llama-2上下文扩展至128k,10倍吞吐量仅需1/6内存

陈丹琦团队新作:Llama-2上下文扩展至128k,10倍吞吐量仅需1/6内存陈丹琦团队刚刚发布了一种新的LLM上下文窗口扩展方法:它仅用8k大小的token文档进行训练,就能将Llama-2窗口扩展至128k。

搜索

搜索

陈丹琦团队刚刚发布了一种新的LLM上下文窗口扩展方法:它仅用8k大小的token文档进行训练,就能将Llama-2窗口扩展至128k。

2月16日,OpenAI推出了堪称“王炸”的文生视频大模型Sora,AI军备竞赛的战场加速向多模态转移,这意味着相比寻常LLM更为丰富的场景与机会。此外,2024年将成为AI硬件元年的共识也基本形成,业界对AI在智能终端的应用寄予厚望,将其视为提振消费电子市场的关键。

说ChatGPT是AI的iPhone时刻有些言过其实, AGI的路上少不了Hugging Face…

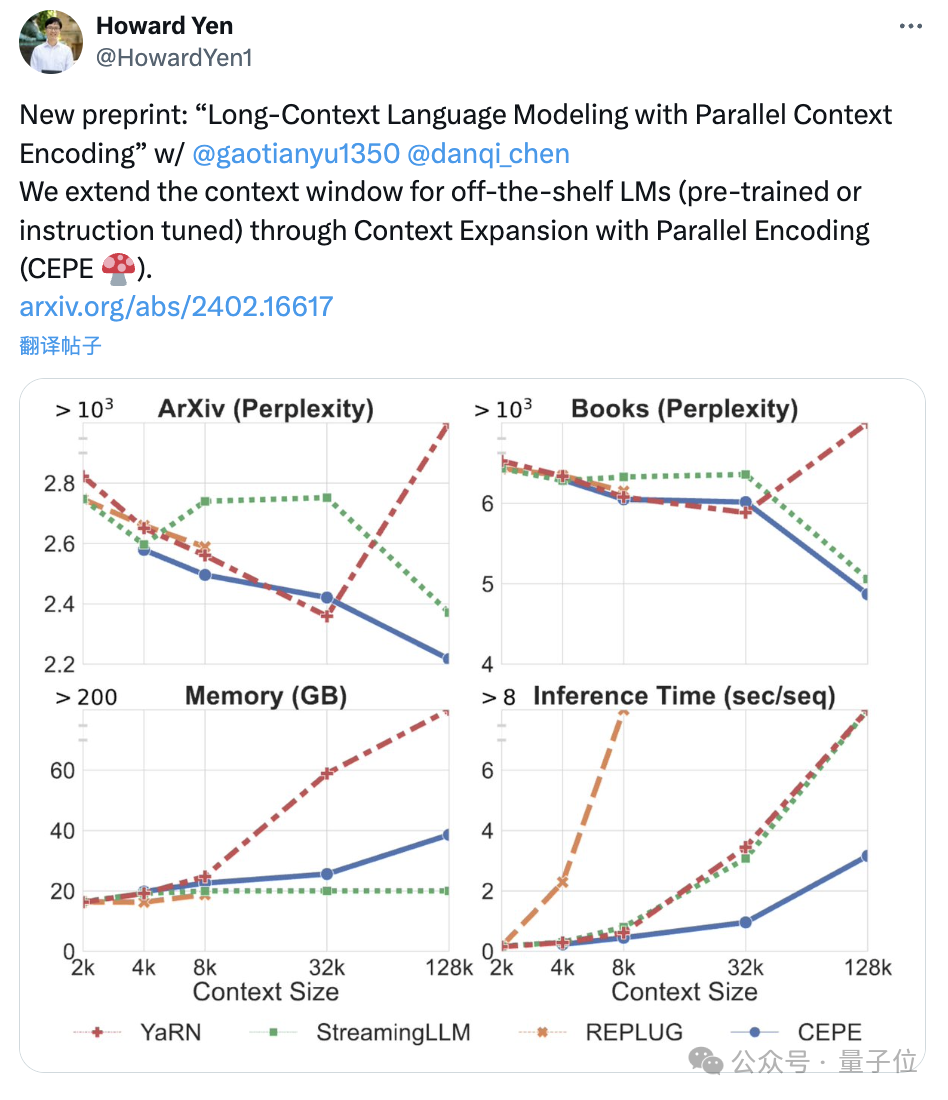

成立仅9个月,法国Mistral AI拿出仅次于GPT-4的大模型。

Sora 的出现,会如何改变电子游戏开发和制作流程,带来怎么样的范式转移,也是行业关注的问题。

全新消费级显卡,专为提速笔记本大模型应用而生。

2月26日,总部位于巴黎的人工智能公司Mistral AI发布尖端文本生成模型Mistral Large。该模型达到了顶级的推理能力,可用于复杂的多语言推理任务,包括文本理解、转换和代码生成。

Reddit和OpenAI及谷歌,竟有着如此错综复杂的关系?最近,Reddit和谷歌双双官宣了一项6000万美元的合作协议,Reddit的数据将帮助谷歌训练AI模型。巧的是,Altman正是Reddit股东之一。

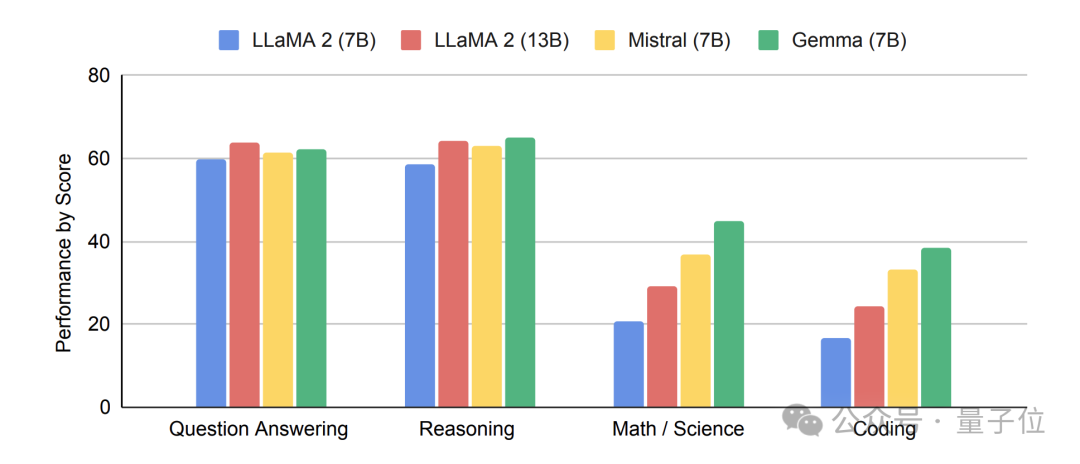

谷歌罕见open的AI,给开源大模型到底带来了什么?

这两天,Sora横空出世让字节也跟着上了热搜。有传言称,字节跳动在Sora引爆文生视频赛道之前,已经研发“中文版Sora”:一款名为Boximator的创新性视频模型。紧接着,字节快速辟谣,积极否认。