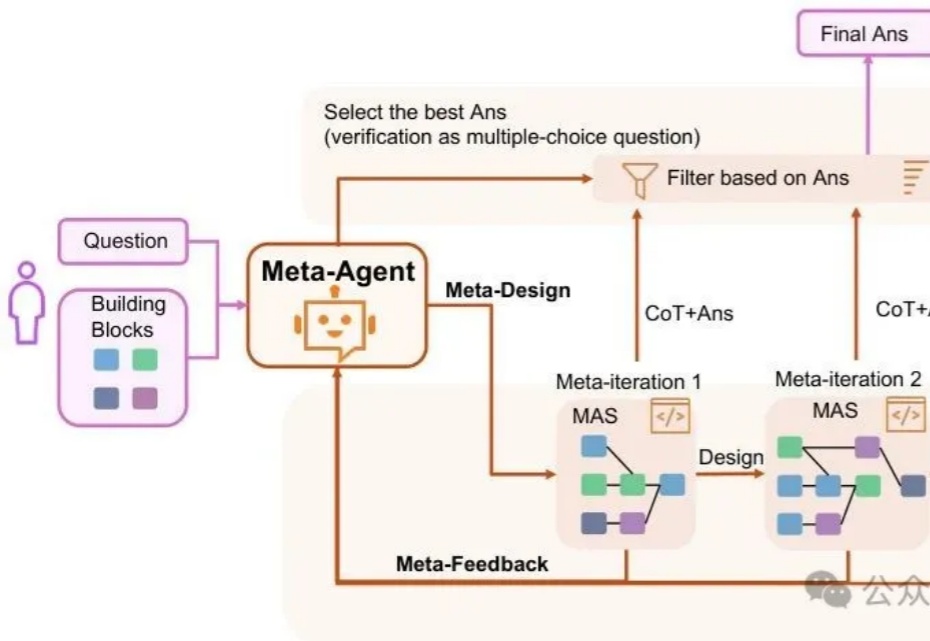

自进化零监督多Agent框架: MAS-ZERO,让AI因地制宜动态适应

自进化零监督多Agent框架: MAS-ZERO,让AI因地制宜动态适应主席在《矛盾论》中强调"具体问题具体分析,是Marxism的活的灵魂"。而在AI领域,我们终于有了一个能够践行这一哲学思想的技术框架——MAS-ZERO,帮我们构建能够因地制宜、因时制宜的智能系统。

主席在《矛盾论》中强调"具体问题具体分析,是Marxism的活的灵魂"。而在AI领域,我们终于有了一个能够践行这一哲学思想的技术框架——MAS-ZERO,帮我们构建能够因地制宜、因时制宜的智能系统。

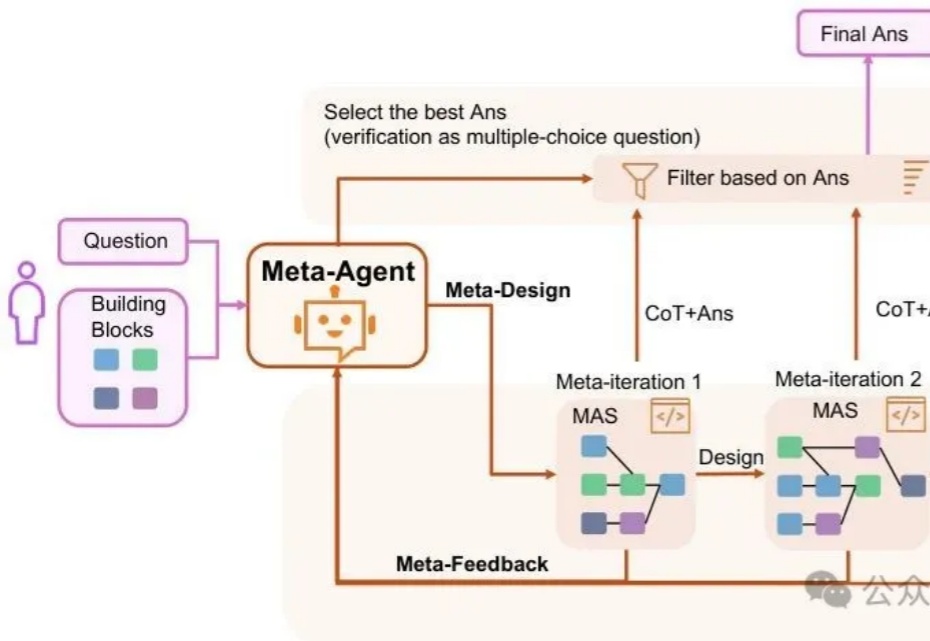

来自上海人工智能实验室团队的最新成果 Linear-MoE,首次系统性地实现了线性序列建模与 MoE 的高效结合,并开源了完整的技术框架,包括 Modeling 和 Training 两大部分,并支持层间混合架构。为下一代基础模型架构的研发提供了有价值的工具和经验。

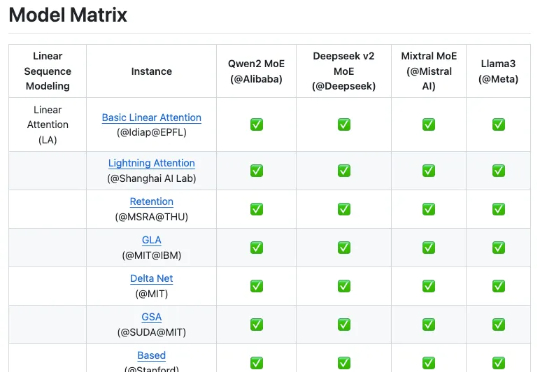

Pangu Ultra MoE 是一个全流程在昇腾 NPU 上训练的准万亿 MoE 模型,此前发布了英文技术报告[1]。最近华为盘古团队发布了 Pangu Ultra MoE 模型架构与训练方法的中文技术报告,进一步披露了这个模型的细节。

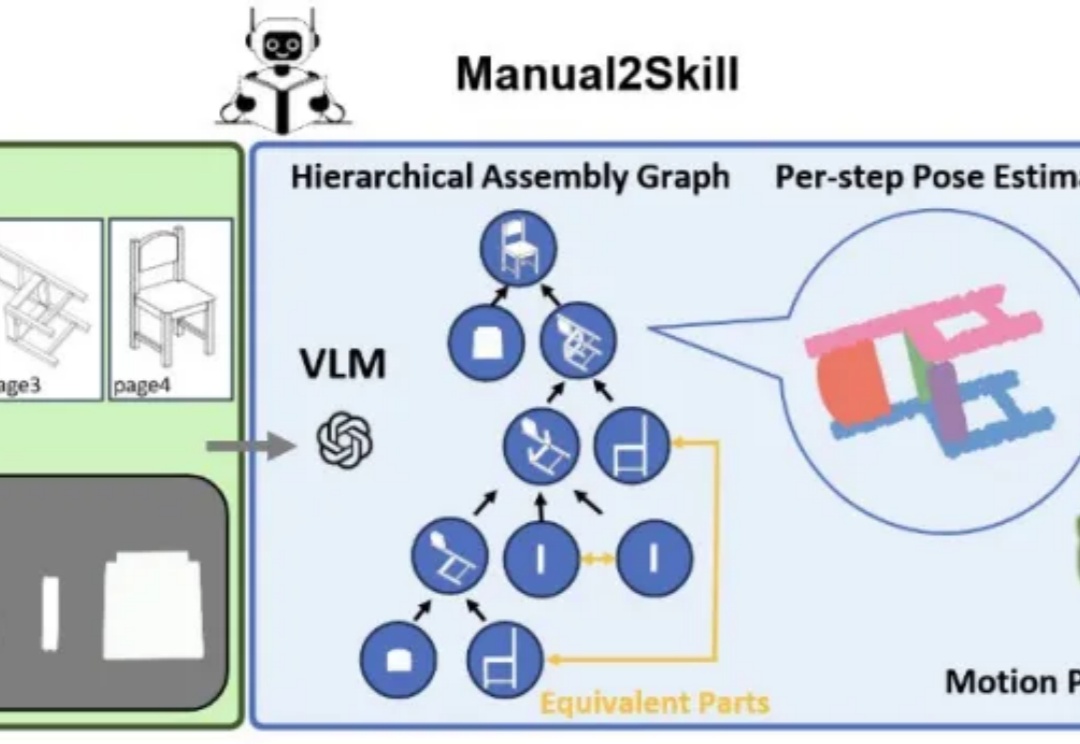

视觉语言模型(Vision-Language Models, VLMs),为真实环境中的机器人操作任务提供了极具潜力的解决方案。

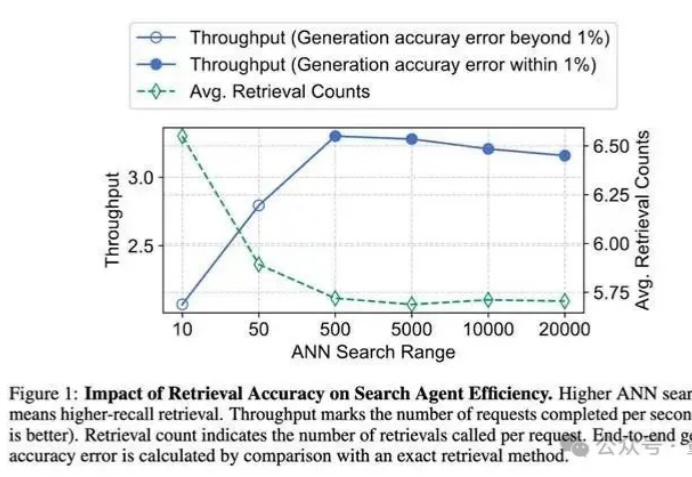

AI越来越聪明,但如果它们反应慢,效率低,也难以满足我们的需求。

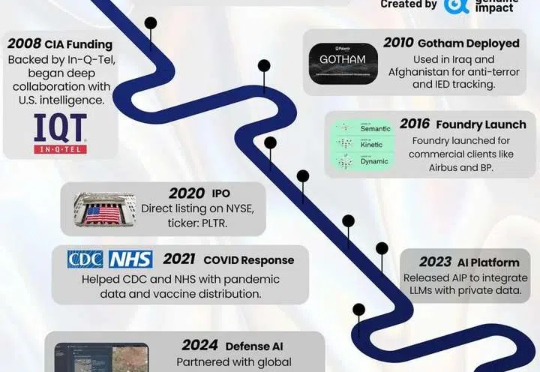

全球最贵估值科技公司,AI 巨头 Palantir 如何合理定价?

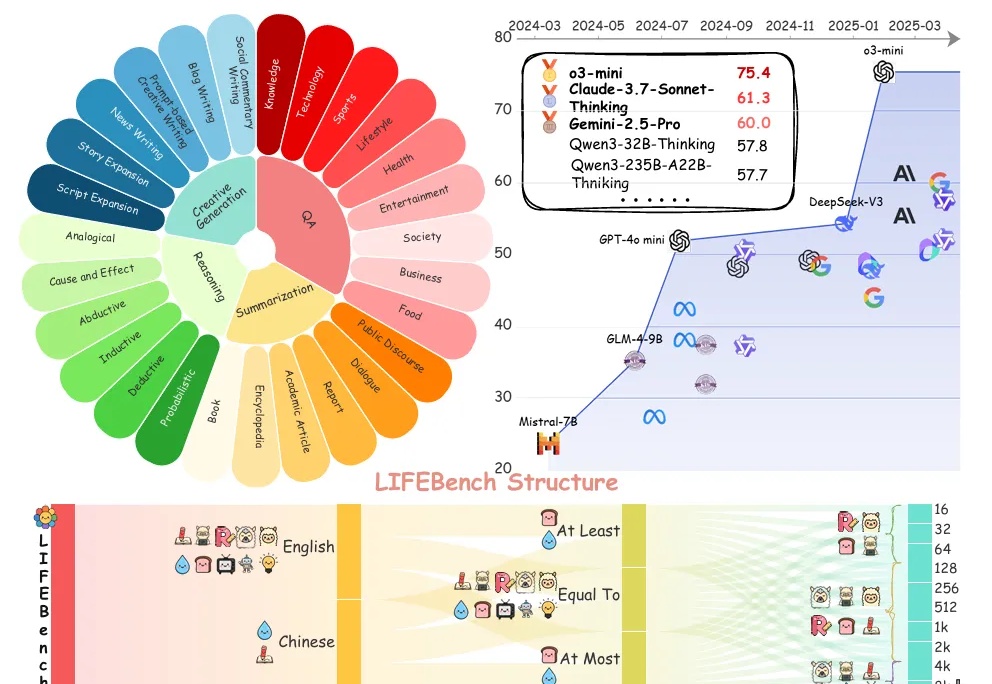

你是否曾对大语言模型(LLMs)下达过明确的“长度指令”?

复刻DeepSeek-R1的长思维链推理,大模型强化学习新范式RLIF成热门话题。

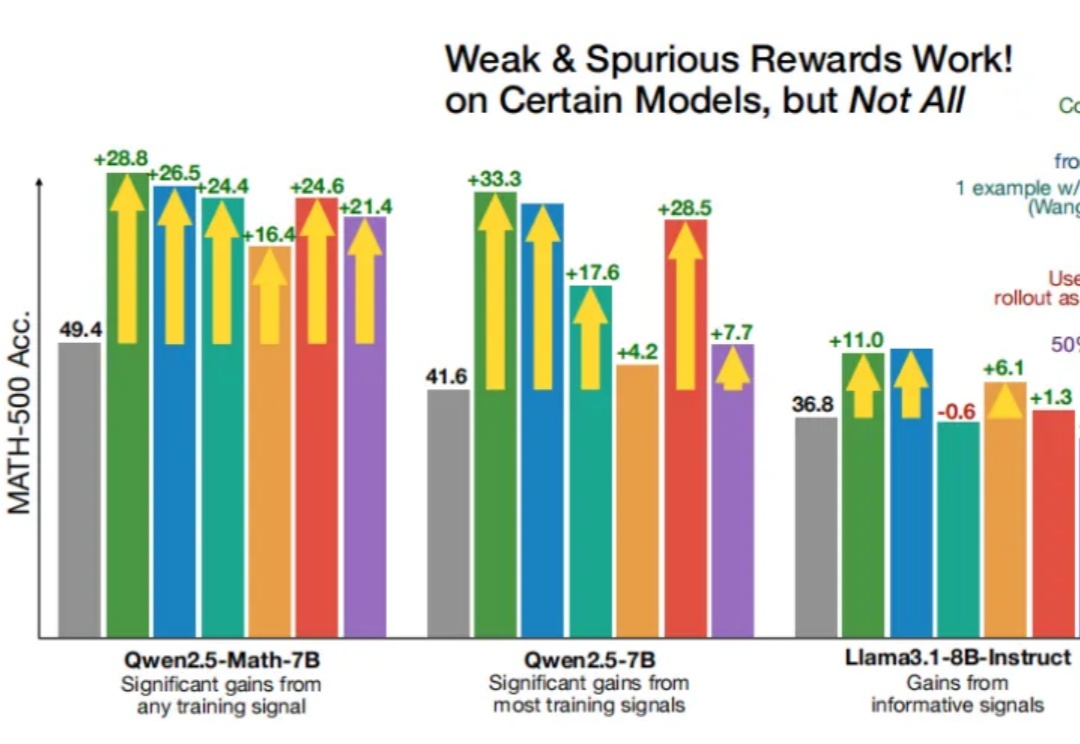

即使RLVR(可验证奖励强化学习)使用错误的奖励信号,Qwen性能也能得到显著提升?

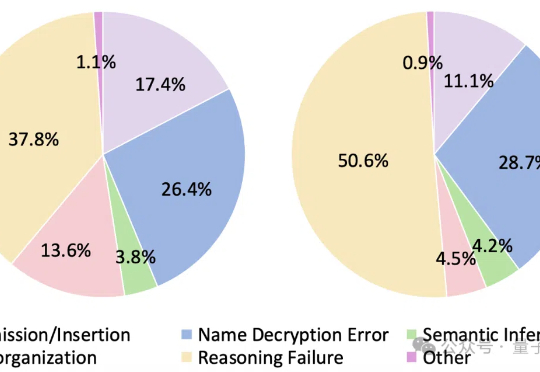

大语言模型遇上加密数据,即使是最新Qwen3也直冒冷汗!