语音生成的「智能涌现」:10万小时数据训练,亚马逊祭出10亿参数BASE TTS

语音生成的「智能涌现」:10万小时数据训练,亚马逊祭出10亿参数BASE TTS伴随着生成式深度学习模型的飞速发展,自然语言处理(NLP)和计算机视觉(CV)已经经历了根本性的转变,从有监督训练的专门模型,转变为只需有限的明确指令就能完成各种任务的通用模型

搜索

搜索

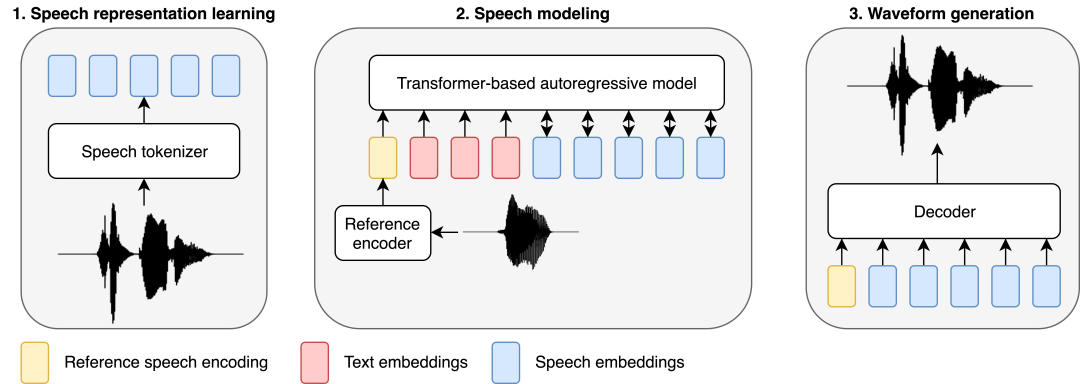

伴随着生成式深度学习模型的飞速发展,自然语言处理(NLP)和计算机视觉(CV)已经经历了根本性的转变,从有监督训练的专门模型,转变为只需有限的明确指令就能完成各种任务的通用模型

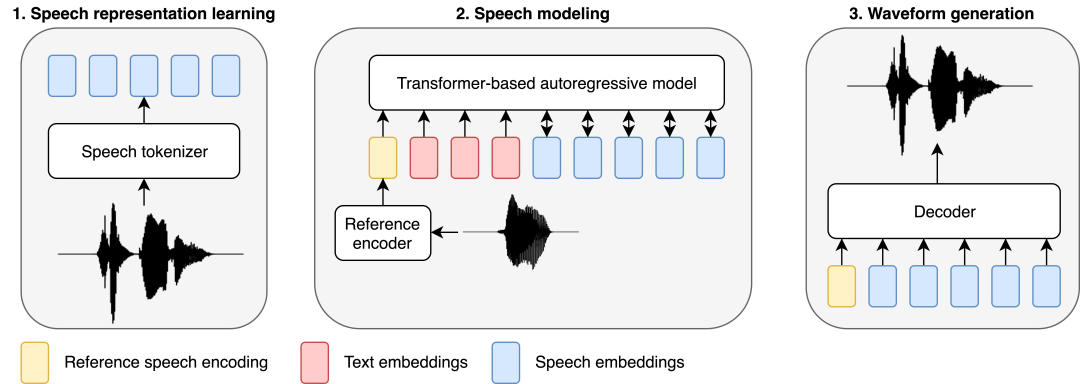

今天介绍一篇密歇根州立大学 (Michigan State University) 和劳伦斯・利弗莫尔国家实验室(Lawrence Livermore National Laboratory)的一篇关于零阶优化深度学习框架的文章 ,本文被 ICLR 2024 接收,代码已开源。

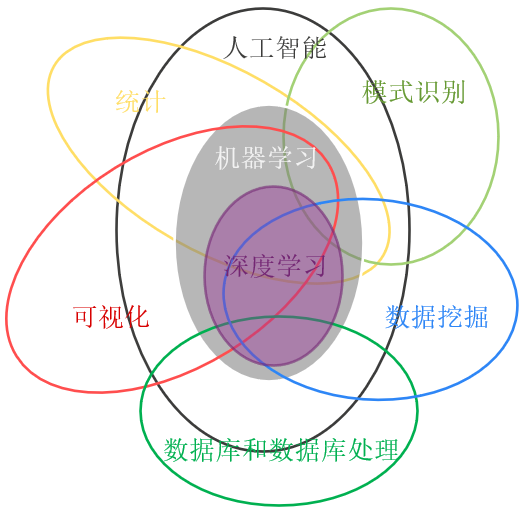

人工智能,即大家说的AI(Artificial Intelligent),当属最热门的技术之一。今天站在嵌入式的角度给大家分享一下人工智能包含的一些要点。

在 AI 领域,推特博主的影响力可能比想象中要大。

药物与靶标之间的结合亲和力的预测对于药物发现至关重要。然而,现有方法的准确性仍需提高。另一方面,大多数深度学习方法只关注非共价(非键合)结合分子系统的预测,而忽略了在药物开发领域越来越受到关注的共价结合的情况。

2023 ACM Fellow正式揭榜!今年共有68人评选为ACM Fellow,图灵奖三巨头,万维网之父位列其中。另外,清华马维英、微软高剑峰等14位华人纷纷入选。

主题驱动的文本到图像生成,通常需要在多张包含该主题(如人物、风格)的数据集上进行训练,这类方法中的代表工作包括 DreamBooth、Textual Inversion、LoRAs 等,但这类方案因为需要更新整个网络或较长时间的定制化训练,往往无法很有效地兼容社区已有的模型,并无法在真实场景中快速且低成本应用。

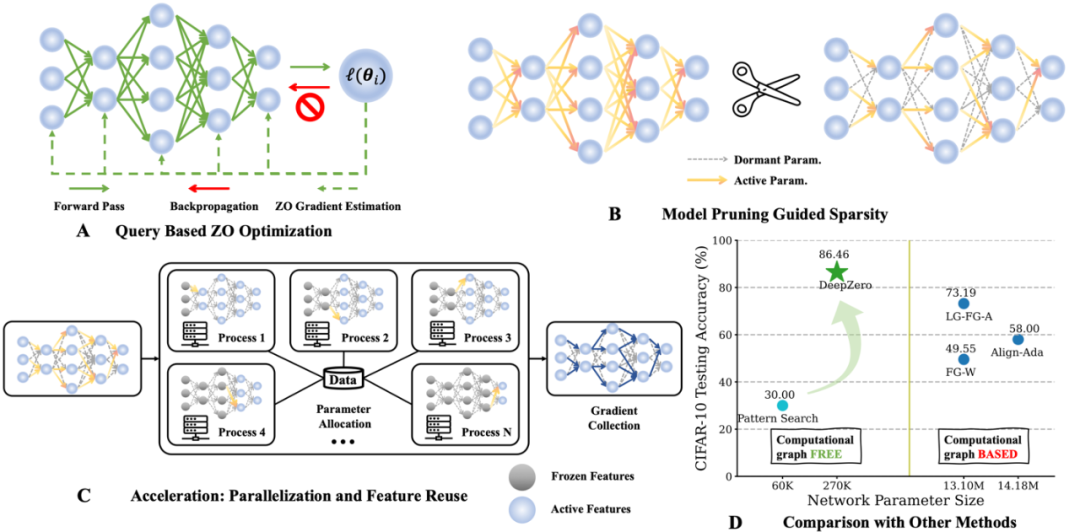

用剪枝的方式加速AI训练,也能实现无损操作了,只要三行代码就能完成!今年的深度学习顶会ICLR上,新加坡国立大学尤洋教授团队的一项成果被收录为Oral论文。

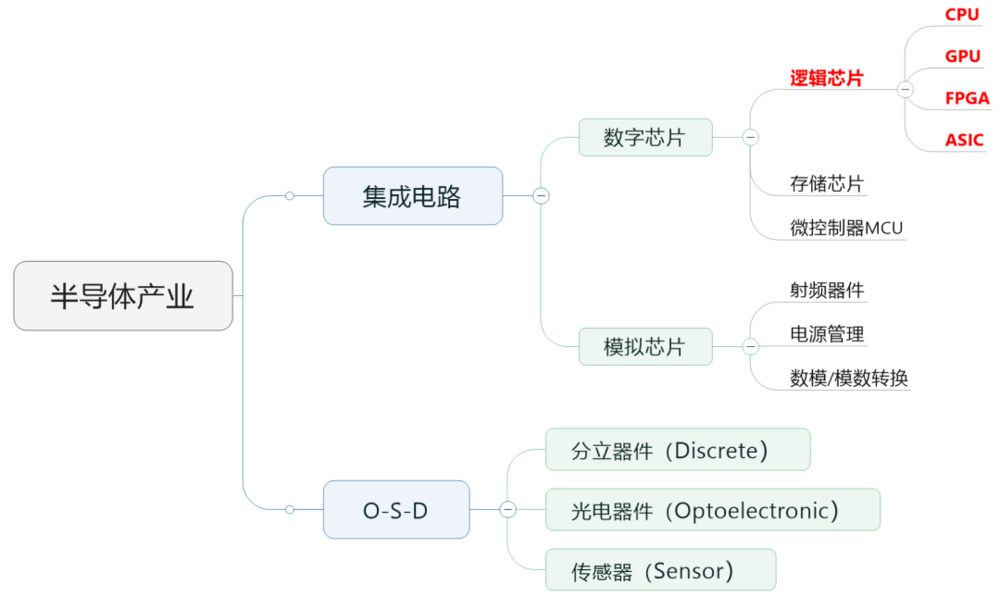

本文介绍了为什么在AI计算中要使用GPU,以及GPU与CPU的区别和作用。GPU具备强悍的并行计算能力,适合处理大量高强度并行计算任务,包括深度学习算法。

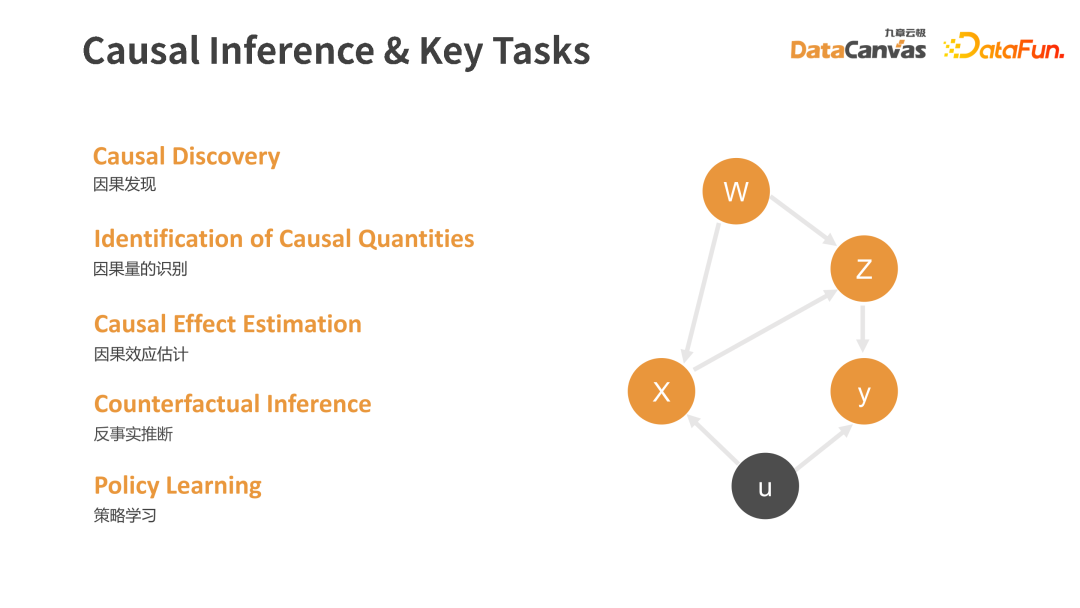

在数字化建设不断推进的今天,随着技术的不断发展,从统计学、机器学习、深度学习,再到因果学习以及最新的热门大模型方向,九章云极 DataCanvas 始终紧贴最前沿的、最能助力企业和落地实践的方向,不断进行着面向决策和面向智能的探索。本文将分享大模型时代下的因果推断。