AI大模型看手相!图片视频加持深度思考,阿里QVQ-Max“神了神了”

AI大模型看手相!图片视频加持深度思考,阿里QVQ-Max“神了神了”阿里又发了个有意思的大模型——QVQ-Max,第一版视觉推理模型,对任意图像或视频都可以进行深度思考。

搜索

搜索

阿里又发了个有意思的大模型——QVQ-Max,第一版视觉推理模型,对任意图像或视频都可以进行深度思考。

今天晚上,就在刚刚,豆包终于上了之前很多人期待的功能,深度思考。我之前用别人的账号体验过这功能,就是推理模型,而今天看到的第一刻,我以为的是,豆包的推理模型终于全量上线了。

首个基于混合Mamba架构的超大型推理模型来了!就在刚刚,腾讯宣布推出自研深度思考模型混元T1正式版,并同步在腾讯云官网上线。对标o1、DeepSeek R1之外,值得关注的是,混元T1正式版采用的是Hybrid-Mamba-Transformer融合模式——

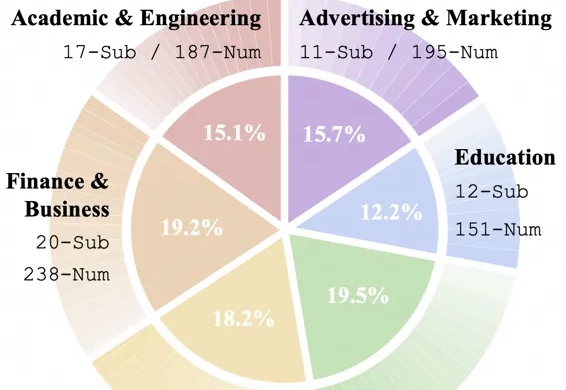

全面评估大模型生成式写作能力的基准来了!

百度文心大模型重磅更新,刚刚如期而至。

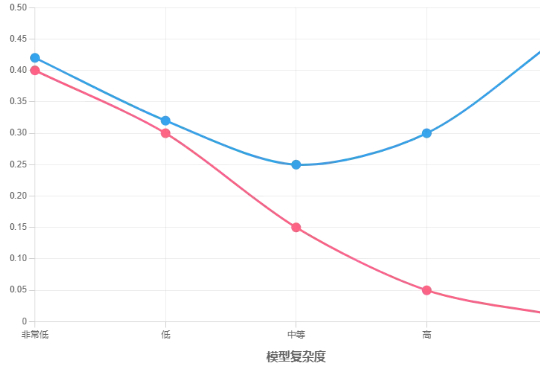

当模型复杂度增加到一定程度后,模型开始对训练数据中的噪声和异常值进行拟合,而不是仅仅学习数据中的真实模式。这导致模型在训练数据上表现得非常好,但在新的数据上表现不佳,因为新的数据中噪声和异常值的分布与训练数据不同。

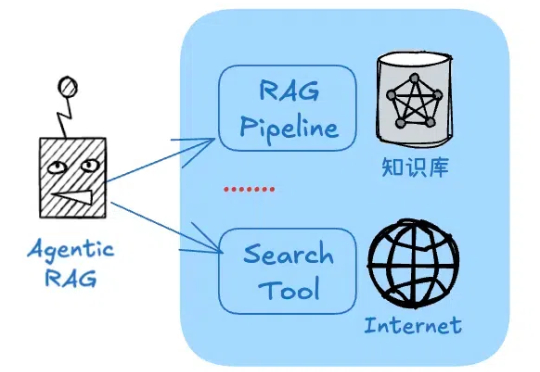

RAG是一种基于“检索结果”做推理的应用,这大大限制了类似DeepSeek-R1模型的发挥空间。但又的确存在将RAG的准确性与DeepSeek深度思考能力结合的场景,而不仅仅是回答事实性问题。比如:

智东西3月3日报道,继2月22日超过豆包后,今日,腾讯旗下AI大模型应用腾讯元宝超过DeepSeek,登顶iOS免费App榜。近期借势DeepSeek,腾讯元宝存在感爆棚,密集上新:2月17日宣布已上线DeepSeek-R1 671B和腾讯混元深度思考模型Thinker(T1);2月18日宣布调用腾讯元宝紧急支持微信搜索,让大家都能稳定体验和使用DeepSeek-R1;

在信息爆炸的时代,搜索引擎早已成为知识工作者和普通人获取专业信息的关键入口。然而,传统搜索引擎以关键词匹配为核心的模式,正在面临前所未有的挑战。

谷歌Gemini 2.0代码助手免费,每月18万次代码补全,支持超大上下文窗口。微软Copilot语音与深度思考功能,同样免费!OpenAI也免费推出了GPT-4o mini高级语音模式。