OpenAI死里逃生?加州AI法案刚刚被毙,LeCun李飞飞吴恩达狂喜

OpenAI死里逃生?加州AI法案刚刚被毙,LeCun李飞飞吴恩达狂喜重磅! 今天凌晨,美加州州长Gavin Newsom正式宣告:否决SB-1047法案!

搜索

搜索

重磅! 今天凌晨,美加州州长Gavin Newsom正式宣告:否决SB-1047法案!

联合国《2030年可持续发展议程》强调“人类、地球、繁荣、和平与伙伴”,为全球提供了从传统发展模式向可持续发展模式转变的范式。2024年9月联合国未来峰会将进一步讨论人工智能、数字经济与可持续发展的关系。针对这样的背景,AI与全球可持续发展展望报告,将分析AI及大模型技术革新对对全球可持续发展的挑战与机遇。

近年来,科技公司不断推出更先进的 AI 模型,而监管机构屡屡措手不及。可以预见,实验室即将发布的新模型将带来新的监管挑战。这只是时间问题。例如,OpenAI 可能在几周内发布 ChatGPT-5,这款模型有望进一步提升 AI 的能力。目前来看,几乎没有任何力量能够延缓或阻止那些可能带来极大风险的模型的发布。

英伟达在2023年1月到2024年8月的不足两年时间里,向初创企业投资74笔,注资总额超过109亿美元的资金。这一规模与美国大型风投企业相当,超过了日本国内年度风投额的5倍。不过,对于在生成式AI领域的垄断行为,各国也在加大监管力度……

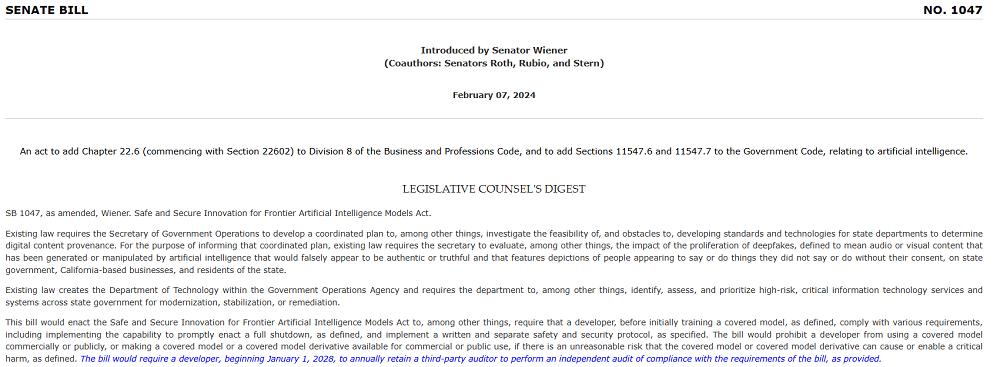

加州首创的AI法案SB-1047只差州长签字,然而吴恩达、a16z呼吁取消该法案,OpenAI、谷歌担心加州AI人才流失。

著作权争议,是AI公司目前面临的重要法律挑战,已经在全球范围内引发多个知名诉讼。

历时半年的 SB 1047法案投票将于近日迎来大结局。

是AI发展的绊脚石,还是安全笼?

在一众AI大佬、科技大厂、初创公司和风险投资人的强烈反对之下,加州的「AI限制法案」顺利地得到了初步通过。

批评与误解之外,加州最新AI安全法案究竟说了什么?