上交大等探索键值压缩的边界:MILLION开源框架定义模型量化推理新范式,入选顶会DAC 2025

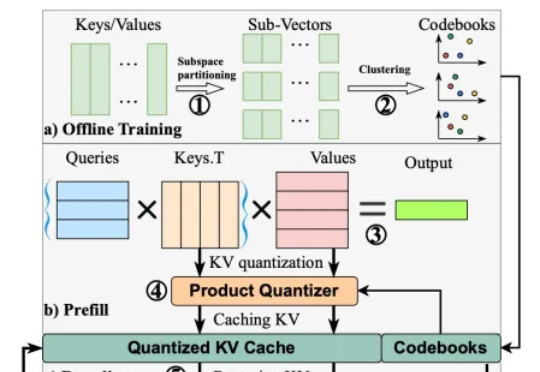

上交大等探索键值压缩的边界:MILLION开源框架定义模型量化推理新范式,入选顶会DAC 2025在以 transformer 模型为基础的大模型中,键值缓存虽然用以存代算的思想显著加速了推理速度,但在长上下文场景中成为了存储瓶颈。为此,本文的研究者提出了 MILLION,一种基于乘积量化的键值缓存压缩和推理加速设计。

在以 transformer 模型为基础的大模型中,键值缓存虽然用以存代算的思想显著加速了推理速度,但在长上下文场景中成为了存储瓶颈。为此,本文的研究者提出了 MILLION,一种基于乘积量化的键值缓存压缩和推理加速设计。

还在用AI改改小Bug?已经out了!最新研究发现,Claude Code上79%的任务直接由AI自动完成。从前端界面到自动化任务,AI正席卷编程。

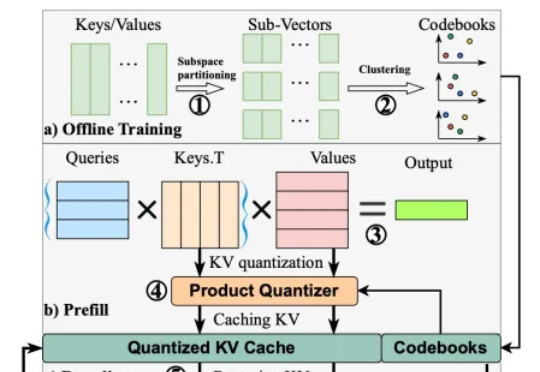

在全球 AI 人才争夺战愈演愈烈的今天,许多技术人却不得不面对一种无力的现实。最近,OpenAI 的一位核心研究员 Kai Chen,因绿卡申请被拒,不得不离开美国,这一消息在科技圈引发了广泛关注。

尽管LLM看似能够进行流畅推理和问题解答,但它们背后的思维链其实只是复杂的统计模式匹配,而非真正的推理能力。AI模型仅仅通过海量数据和经验法则来生成响应,而不是通过深刻的世界模型和逻辑推理来做决策。

今天,一张图在网上爆火:中国AI专利数量占全球70%,成TOP 1!不过,曾撰写「AI 2027」预测报告的研究员却发长篇博文表示,AI竞赛美国稳操胜券,原因就在算力上。

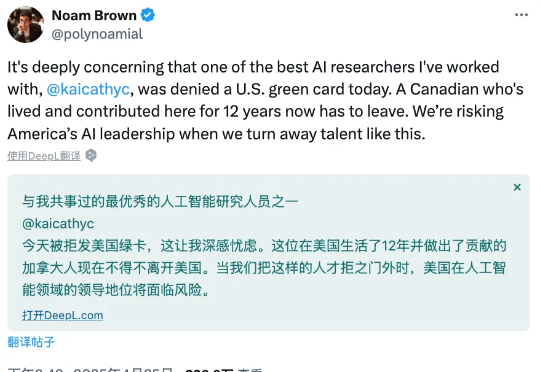

一项来自清华大学和上海交通大学的研究颠覆了对可验证奖励强化学习(RLVR)的认知。RLVR被认为是打造自我进化大模型的关键,但实验表明,它可能只是提高了采样效率,而非真正赋予模型全新推理能力。

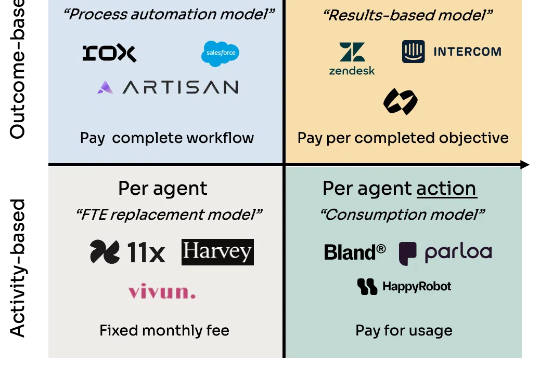

今年以来,AI代理开始彻底爆发,越来越多AI代理产品上线,并快速进入商业化阶段。

自回归模型,首次生成2048×2048分辨率图像!来自Meta、西北大学、新加坡国立大学等机构的研究人员,专门为多模态大语言模型(MLLMs)设计的TokenShuffle,显著减少了计算中的视觉Token数量,提升效率并支持高分辨率图像合成。

LLM的规模爆炸式增长,传统量化技术虽能压缩模型,却以牺牲精度为代价。莱斯大学团队的最新研究DFloat11打破这一僵局:它将模型压缩30%且输出与原始模型逐位一致!更惊艳的是,通过针对GPU的定制化解压缩内核,DFloat11使推理吞吐量提升最高38.8倍。

近日,微软发布了2025年度《工作趋势指数》报告,该研究调查了来自31个国家和地区的3.1万名受访者,并整合了LinkedIn就业市场数据,分析了AI和数字化转型对全球工作环境和组织结构的深刻影响,并预测了一个新的概念——“前沿企业”(Frontier Firms)。这些公司利用AI助手和人类智能的融合,推动了快速发展、灵活运营和价值创造。