对话AFFiNE贺嘉琛:开源软件不是xx的平替,它可以成为比闭源更成功的产品

对话AFFiNE贺嘉琛:开源软件不是xx的平替,它可以成为比闭源更成功的产品AFFiNE,一个开源的 AI 协作知识库,集成了完整文档、白板和数据库的工作空间。累计融资 1000 万美元,开源项目在 Github 上超过 4.5 万 stars。创始人、CEO 贺嘉琛,连续创业者。创业前研究天体物理,毕业于格拉斯哥与香港科技大学。

AFFiNE,一个开源的 AI 协作知识库,集成了完整文档、白板和数据库的工作空间。累计融资 1000 万美元,开源项目在 Github 上超过 4.5 万 stars。创始人、CEO 贺嘉琛,连续创业者。创业前研究天体物理,毕业于格拉斯哥与香港科技大学。

2025年2月27日,由前扩散模型领域顶尖研究者创立的Inception Labs正式发布了全球首个商业级扩散大语言模型(dLLM)——“Mercury”。这一里程碑式产品不仅在生成速度、硬件效率和成本控制上实现突破,更标志着自然语言处理技术从自回归(Autoregressive)范式向扩散(Diffusion)范式的重大跃迁。

谷歌Gemini 2.0不仅能深度剖析学术论文,还能预测职业轨迹?Jeff Dean和Yi Tay等AI大佬亲测,其精准的论文评价和职业规划预测令人惊叹。Gemini究竟是巧合还是AI进化的又一力证?它将如何改变学术研究的未来?

国际可重构计算领域顶级会议 ——FPGA 2025 在落幕之时传来消息,今年的最佳论文颁发给了无问芯穹和上交、清华共同提出的视频生成大模型推理 IP 工作 FlightVGM,这是 FPGA 会议首次将该奖项授予完全由中国大陆科研团队主导的研究工作,同时也是亚太国家团队首次获此殊荣。

从漫长等待到极速突破

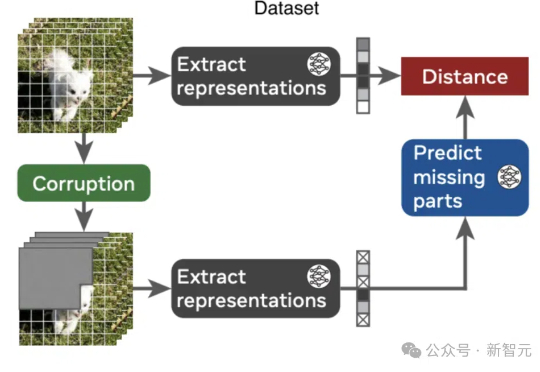

AI如何理解物理世界?视频联合嵌入预测架构V-JEPA带来新突破,无需硬编码核心知识,在自监督预训练中展现出对直观物理的理解,超越了基于像素的预测模型和多模态LLM。

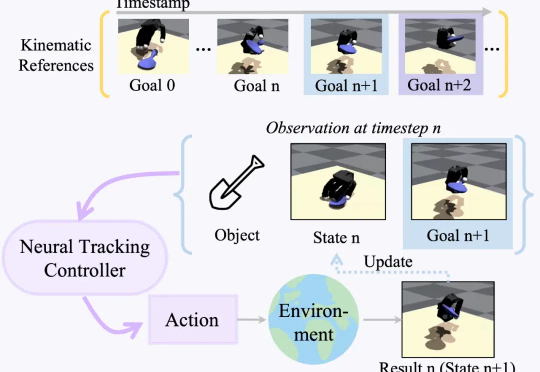

现实世界的机器人距离科幻小说里的机器人世界还有多远?通用灵巧操控何时才能实现?朝着这一伟大的目标,研究通用灵巧操控轨迹跟踪的 DexTrack 便应用而生。

在大语言模型 (LLM) 的研究中,与以 Chain-of-Thought 为代表的逻辑思维能力相比,LLM 中同等重要的 Leap-of-Thought 能力,也称为创造力,目前的讨论和分析仍然较少。这可能会严重阻碍 LLM 在创造力上的发展。造成这种困局的一个主要原因是,面对「创造力」,我们很难构建一个合适且自动化的评估流程。

近日,来自哥大的研究人员开发出了一种新AI系统,让机器人通过普通摄像头和深度神经网络实现自我建模、运动规划和自我修复,突破了传统机器人依赖工程师调整的局限,使机器人能像人类一样自主学习和适应环境变化,为具身智能发展带来新范式。

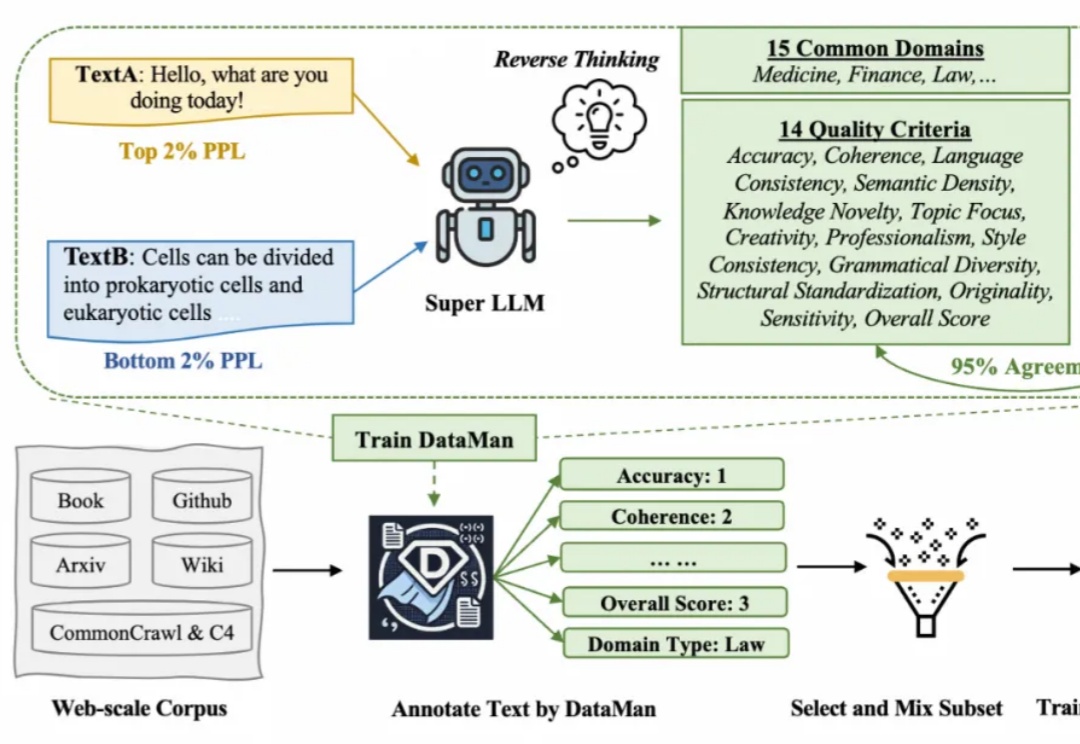

在 Scaling Law 背景下,预训练的数据选择变得越来越重要。然而现有的方法依赖于有限的启发式和人类的直觉,缺乏全面和明确的指导方针。在此背景下,该研究提出了一个数据管理器 DataMan,其可以从 14 个质量评估维度对 15 个常见应用领域的预训练数据进行全面质量评分和领域识别。