OpenAI研究员首次提出「AGI时间」进化论!o1数学已达「分钟级AGI」

OpenAI研究员首次提出「AGI时间」进化论!o1数学已达「分钟级AGI」本月,OpenAI科学家就当前LLM的scaling方法论能否实现AGI话题展开深入辩论,认为将来AI至少与人类平分秋色;LLM scaling目前的问题可以通过后训练、强化学习、合成数据、智能体协作等方法得到解决;按现在的趋势估计,明年LLM就能赢得IMO金牌。

本月,OpenAI科学家就当前LLM的scaling方法论能否实现AGI话题展开深入辩论,认为将来AI至少与人类平分秋色;LLM scaling目前的问题可以通过后训练、强化学习、合成数据、智能体协作等方法得到解决;按现在的趋势估计,明年LLM就能赢得IMO金牌。

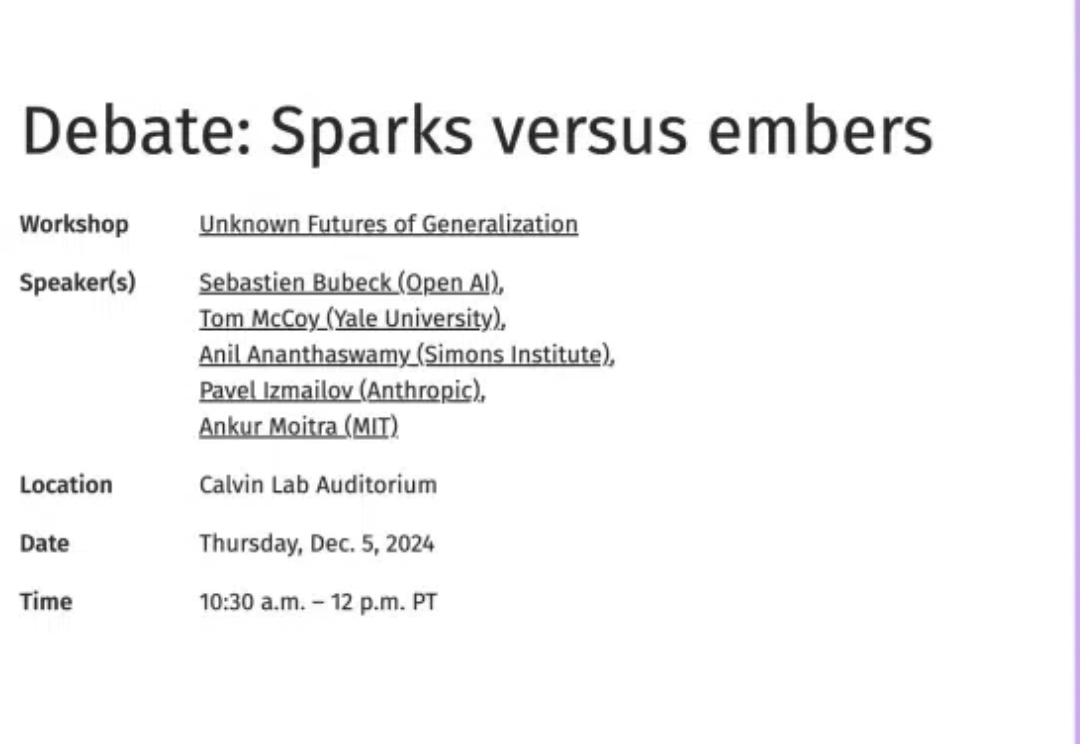

数字生命一直是人类几十年来的追求,反映了我们对技术与人类体验交汇的深层探索。近期,复旦大学发表了一篇综述论文,首次系统梳理了角色扮演AI(Role-Playing Language Agents,RPLAs)的研究现状,现已被机器学习顶级期刊TMLR接收。

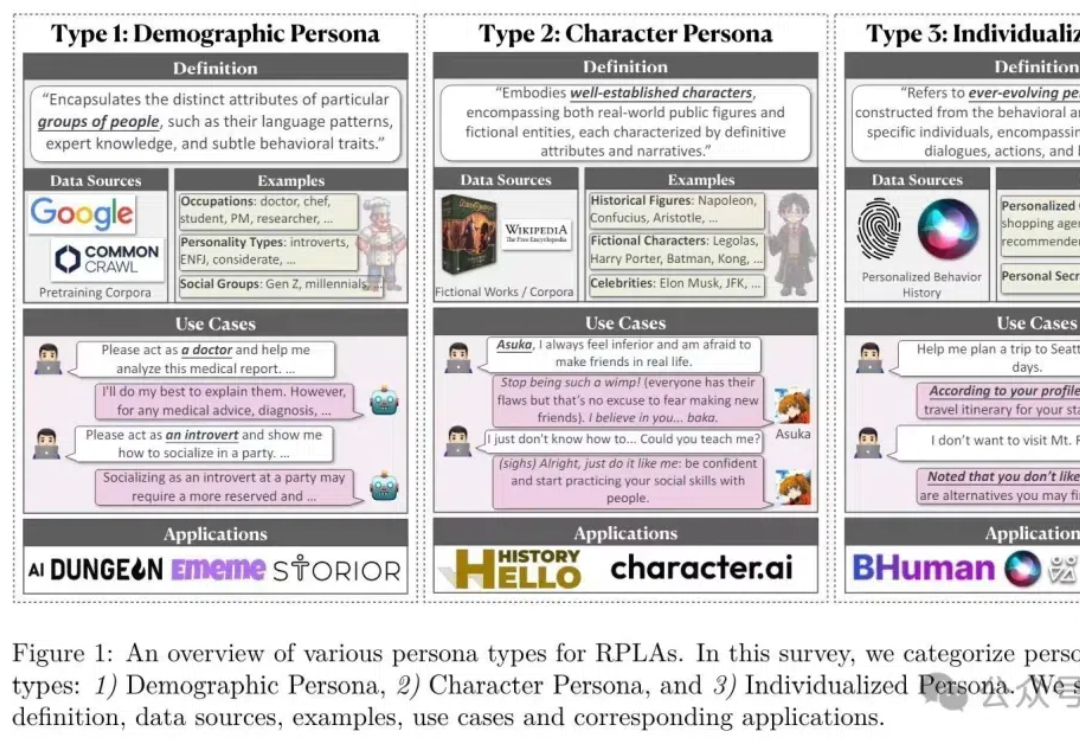

CPU+GPU,模型KV缓存压力被缓解了。 来自CMU、华盛顿大学、Meta AI的研究人员提出MagicPIG,通过在CPU上使用LSH(局部敏感哈希)采样技术,有效克服了GPU内存容量限制的问题。

1822 年,电学之父法拉第在日记中写到“既然通电能够产生磁力,为什么不能用磁铁产生电流呢?我一定要反过来试试!”。于是在 1831 年,第一台发电机被发明,推动了人类进入电气化时代。

最近,一篇研究文章从数学理论上证实了AI模型可以完全模拟神经元和突触的信号,在更强算法、更大算力的加持下,可以精确模拟大脑及其功能系统,在无约束的情况下未来AI百分之一百会超越人类智能,甚至发明创造能力也是如此。

《智能涌现》独家获悉,前微软亚洲研究院研究员、阿里达摩院资深技术专家、支付宝中国首席数据官胡云华加入大模型独角兽智谱,担任C端应用“智谱清言”负责人。

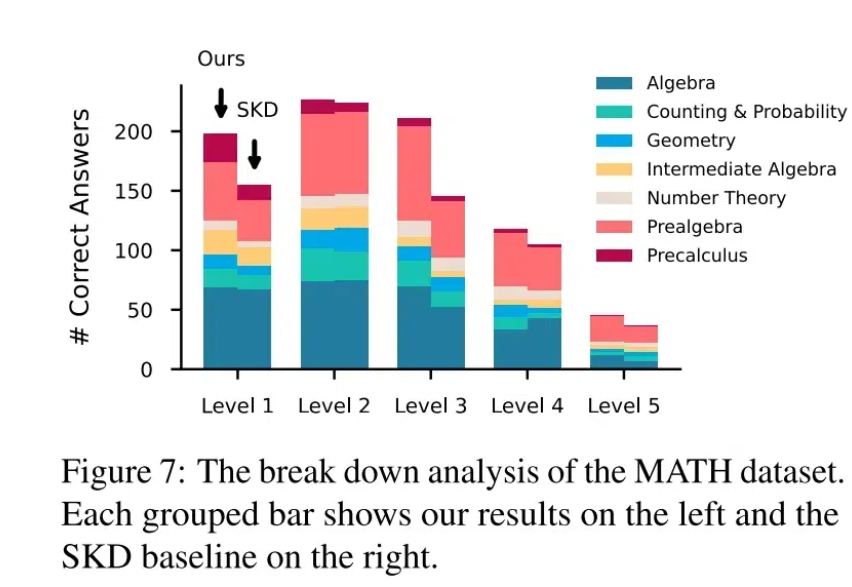

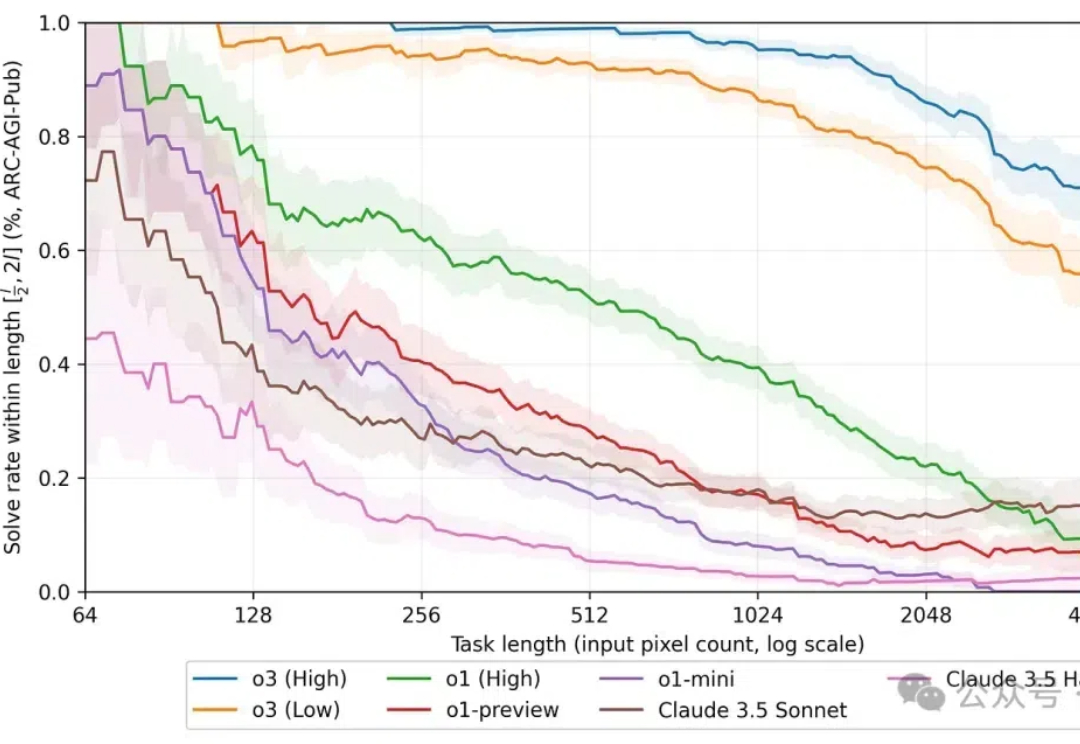

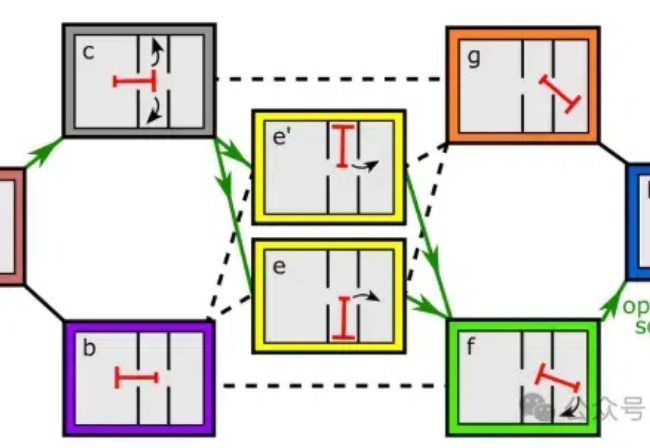

o3在超难推理任务ARC-AGI上的成绩,属实给人类带来了不少震撼。 但有人专门研究了它不会做的题之后,有了更有趣的发现—— o3之所以不会做这些题,原因可能不是因为太难,而是题目的规模太大了。

如何将这个应用到你的实际营销中可能成效并不明显,但一个值得注意的变化是模型成本的贬值。你可能没有意识到,AI是有史以来折旧速度最快的技术。

你听说过「通用蚂蚁智能」吗?今天,全网爆火一个视频充分展示了什么是AGI——蚂蚁群体智能的智慧。在解决钢琴搬运难题任务中,它们甚至超越了人类,最新研究登上PNAS。

在最新一期的《通讯-化学》杂志上,德国弗劳恩霍夫工艺工程与包装研究所的研究人员发表了一篇论文,介绍了他们开发的两种人工智能算法。这些算法能够识别16种威士忌中最突出的5种香气,与品酒师的评估结果高度一致。