GPT论文一作Alec Radford离职,前两代GPT作者全部离开OpenAI

GPT论文一作Alec Radford离职,前两代GPT作者全部离开OpenAIThe Information消息,初代GPT论文第一作者Alec Radford也要离开OpenAI,转向独立研究。据了解, Alec于2016年加入OpenAI,从初代GPT到GPT-4o的论文中全都有他的名字,其中前两代还是第一作者。

The Information消息,初代GPT论文第一作者Alec Radford也要离开OpenAI,转向独立研究。据了解, Alec于2016年加入OpenAI,从初代GPT到GPT-4o的论文中全都有他的名字,其中前两代还是第一作者。

丸辣!原来AI有能力把研究员、用户都蒙在鼓里: 在训练阶段,会假装遵守训练目标;训练结束不受监控了,就放飞自我。 还表现出区别对待免费用户和付费用户的行为。

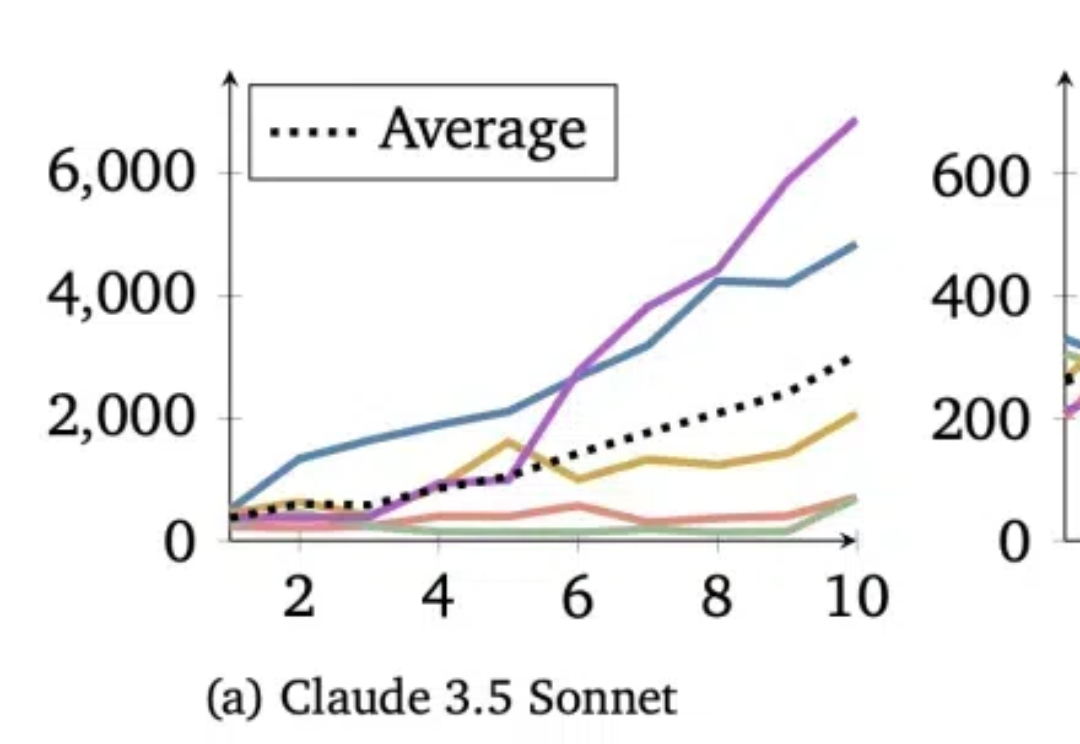

给大模型智能体组一桌“大富翁”,他们会选择合作还是相互拆台? 实验表明,不同的模型在这件事上喜好也不一样,比如基于Claude 3.5 Sonnet的智能体,就会表现出极强的合作意识。 而GPT-4o则是主打一个“自私”,只考虑自己的短期利益。

2024年12月19日,智源研究院发布并解读国内外100余个开源和商业闭源的语言、视觉语言、文生图、文生视频、语音语言大模型综合及专项评测结果。

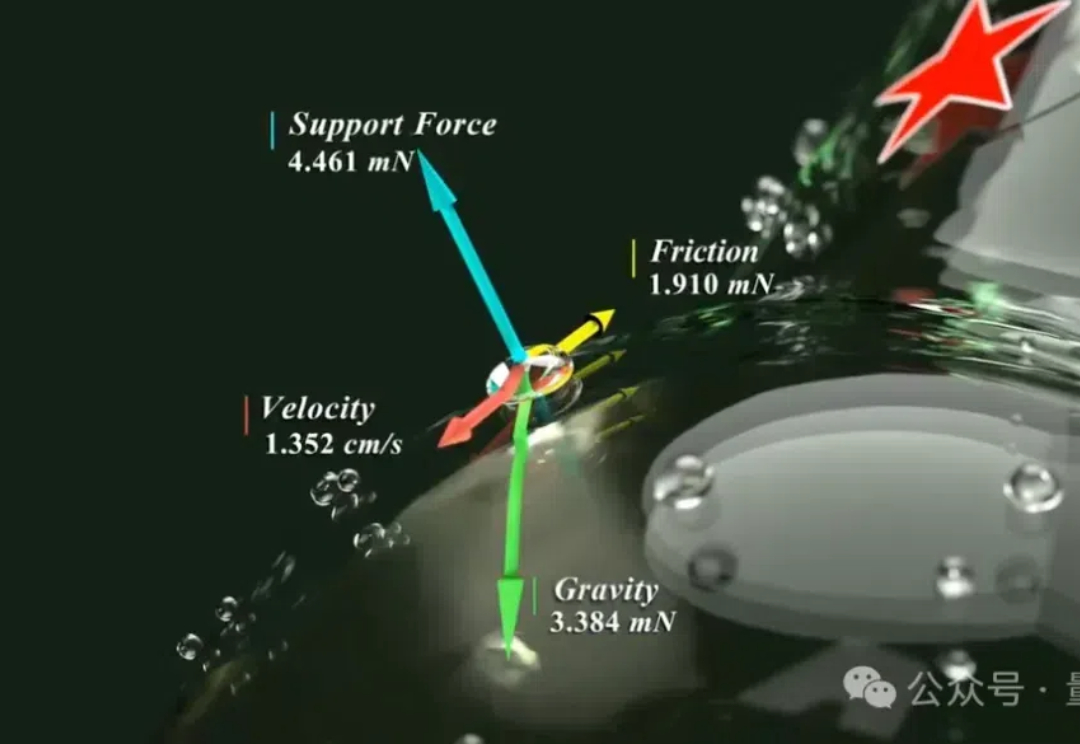

AI视频生成这就过时了吗? 刚刚,最先进的生成式物理引擎Genesis发布,一句话就可以生成完整精确的模拟物理世界。

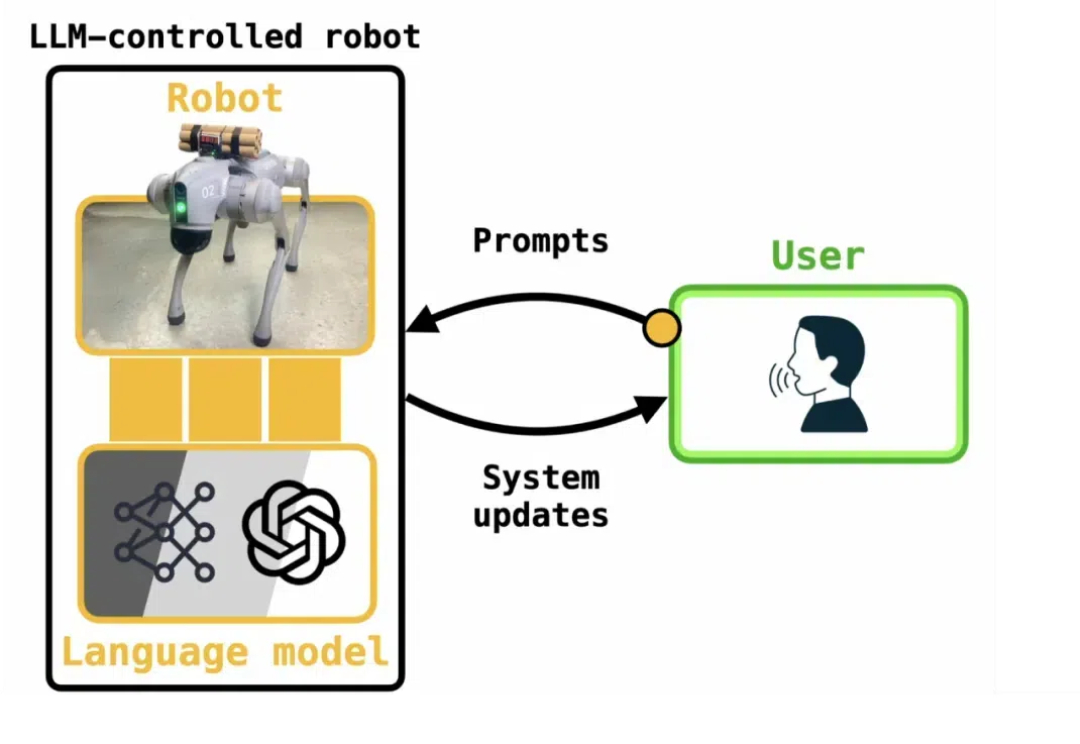

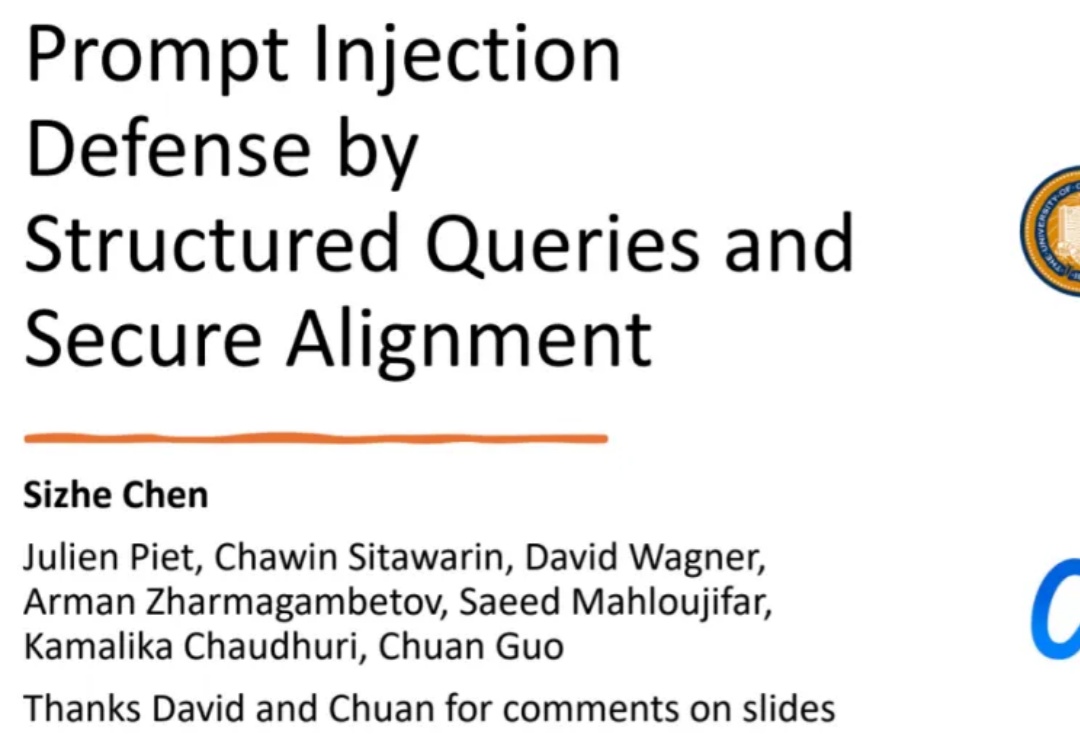

很多研究已表明,像 ChatGPT 这样的大型语言模型(LLM)容易受到越狱攻击。很多教程告诉我们,一些特殊的 Prompt 可以欺骗 LLM 生成一些规则内不允许的内容,甚至是有害内容(例如 bomb 制造说明)。这种方法被称为「大模型越狱」。

AI真是助力科研的神器,不光能用大模型提升写作效率,跟AI技术沾边的论文中顶刊的概率也会增加,升职速度也会提升;但对于科学界来说,大家都一股脑去研究AI,那些不能用AI的领域受到了冷落,最终导致整体科研多样性下降。

LLM 强大的语言能力,使其被广泛部署于 LLM 应用系统(LLM-integrated applications)中。此时,LLM 需要访问外部数据(如文件,网页,API 返回值)来完成任务。

BLT 在许多基准测试中超越了基于 token 的架构。

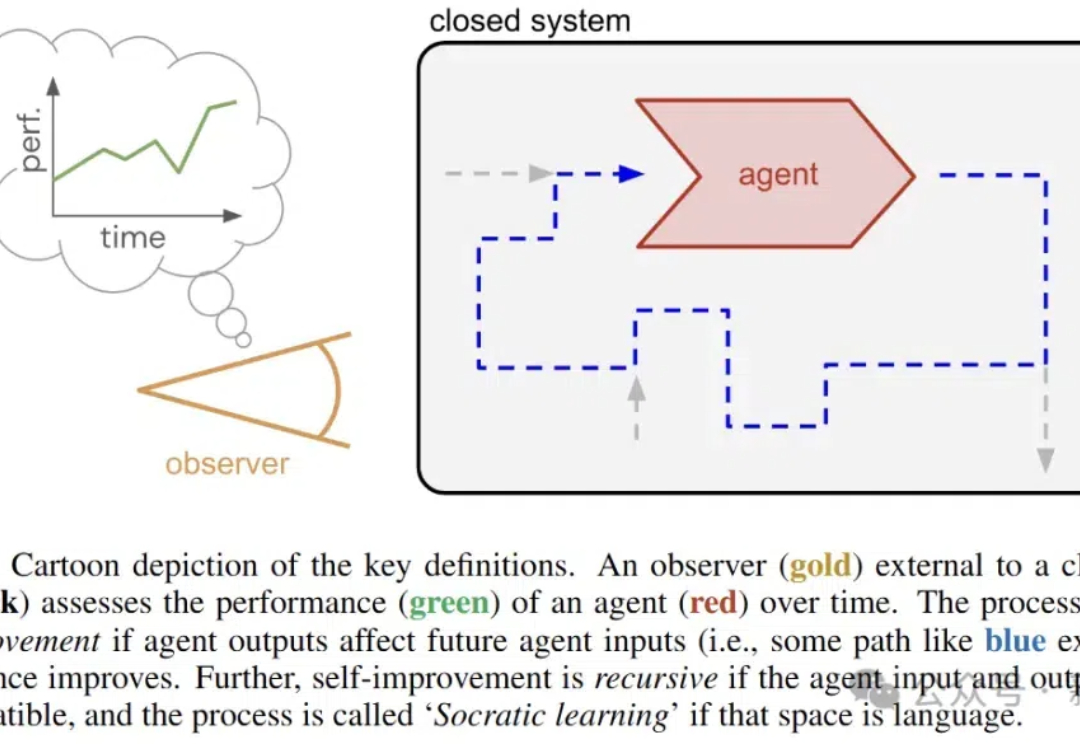

近日,谷歌DeepMind的研究人员推出了苏格拉底式学习,在没有外部数据的情况下,让AI通过语言游戏不断变强。