人类自身都对不齐,怎么对齐AI?新研究全面审视偏好在AI对齐中的作用

人类自身都对不齐,怎么对齐AI?新研究全面审视偏好在AI对齐中的作用让 AI 与人类价值观对齐一直都是 AI 领域的一大重要且热门的研究课题,甚至很可能是 OpenAI 高层分裂的一大重要原因 ——CEO 萨姆・奥特曼似乎更倾向于更快实现 AI 商业化,而以伊尔亚・苏茨克维(Ilya Sutskever)为代表的一些研究者则更倾向于先保证 AI 安全。

让 AI 与人类价值观对齐一直都是 AI 领域的一大重要且热门的研究课题,甚至很可能是 OpenAI 高层分裂的一大重要原因 ——CEO 萨姆・奥特曼似乎更倾向于更快实现 AI 商业化,而以伊尔亚・苏茨克维(Ilya Sutskever)为代表的一些研究者则更倾向于先保证 AI 安全。

最近,来自德国奥尔登堡大学计算智能实验室的研究人员Oliver Kramer和Jill Baumann提出了一种创新的方法——认知提示(Cognitive Prompting),通过模拟人类认知过程来提升LLM的问题解决能力。这项研究将在ICLR 2025会议上发表,本文将为各位读者朋友详细解读这一突破性的技术。

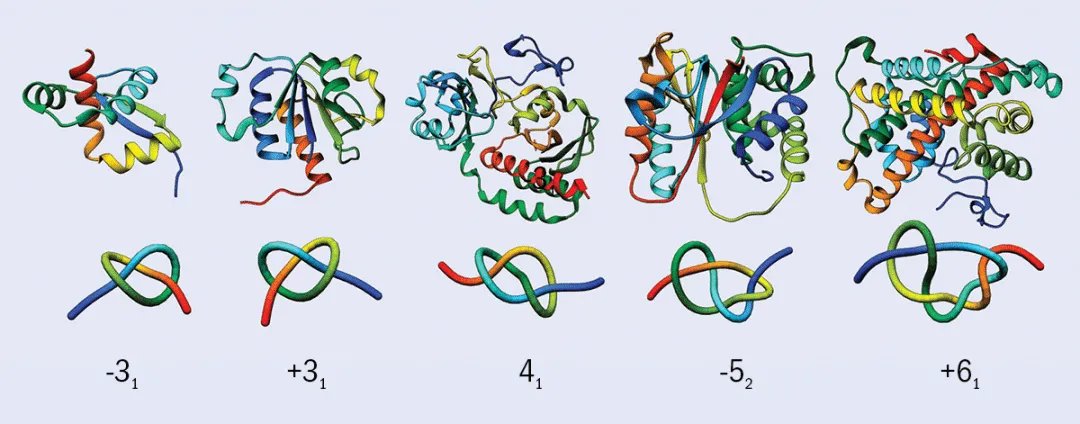

纽结理论长期困扰着数学家,但随着人工智能的进步,有研究者在生物学中找到了突破口,因为纽结结构存在于许多重要的生物分子中,例如蛋白质、DNA等。对于难以识别归类的复杂纽结结构,AI给出了令人惊讶的结果。

近日,来自乔治梅森大学和腾讯AI实验室的研究团队在这一领域取得了重大突破。他们提出了一种名为DOTS(Dynamic Optimal Trajectory Search)的创新方法,通过最佳推理轨迹搜索,显著提升LLMs的动态推理能力。

多年来,浙江大学周晟老师团队与阿里安全交互内容安全团队持续开展产学研合作。近日,双⽅针对标签噪声下图神经⽹络的联合研究成果《NoisyGL:标签噪声下图神经网络的综合基准》被 NeurIPS Datasets and Benchmarks Track 2024 收录。本次 NeurIPS D&B Track 共收到 1820 篇投稿,录⽤率为 25.3%。

前不久在人工智能的帮助下,两位科学家获得了诺贝尔物理学奖。可以说人工智能已经在很多领域被广泛应用了。随着大语言模型(LLM)和深度学习的广泛应用,GPU 也已成为机器学习工程师和研究人员最重要的计算资源之一。

比传统MoE推理速度更快、性能更高的新一代架构,来了! 这个通用架构叫做MoE++,由颜水成领衔的昆仑万维2050研究院与北大袁粒团队联合提出。

内存占用小,训练表现也要好……大模型训练成功实现二者兼得。 来自北理、北大和港中文MMLab的研究团队提出了一种满足低秩约束的大模型全秩训练框架——Fira,成功打破了传统低秩方法中内存占用与训练表现的“非此即彼”僵局。

2024年诺贝尔物理学奖的结果引发了广泛的讨论,原因是其中一位获奖者Geoffrey Hinton(杰弗里·辛顿),并非是传统意义上的物理学家,而是一位极具声望的人工智能研究科学家,被誉为深度神经网络的奠基人和人工智能“教父”。

简单高效的大模型检索增强系统LightRAG,香港大学黄超团队最新研究成果。 开源两周时间在GitHub上获得将近5k标星,并登上趋势榜。