3天把Llama训成Mamba,性能不降,推理更快!

3天把Llama训成Mamba,性能不降,推理更快!近日,Mamba方面又搞出了有意思的研究:来自康奈尔、普林斯顿等机构的研究人员成功将Llama提炼成了Mamba模型,并且设计了新的推测解码算法,加速了模型的推理。

近日,Mamba方面又搞出了有意思的研究:来自康奈尔、普林斯顿等机构的研究人员成功将Llama提炼成了Mamba模型,并且设计了新的推测解码算法,加速了模型的推理。

近日,清华大学电子系城市科学与计算研究中心的研究论文《EconAgent: Large Language Model-Empowered Agents for Simulating Macroeconomic Activities》获得自然语言处理顶会 ACL 2024杰出论文奖(Outstanding Paper Award)。

之前一直在社区分享零代码&低代码的技术实践,也陆陆续续设计并开发了多款可视化搭建产品,最近研究D2C方案的时候发现一款非常有意思的AI生成代码的工具——Kombai.

有助于解决阻碍材料开发的化学难题。

沿着 Scaling Law、卷模型性能,可能会走到「死胡同」。 谁在影响、定义我们的时代?他们做了什么,如何思考?对话关键人物,记录历史底稿。 我们被倡导要想明白自己的目标是什么、并做出计划。然而,两位人工智能研究者却认为,这只适用于普通的小愿望。

MIT研究发现:在AI的操纵下,人类会被植入虚假记忆!36.4%的参与者会被聊天机器人误导,形成「现场有枪」的错误记忆。有趣的是,AI的阿谀奉承,会产生「回音室效应」,让偏见更加强化。

不知不觉之中,我们身边已经充斥着 AI 了。

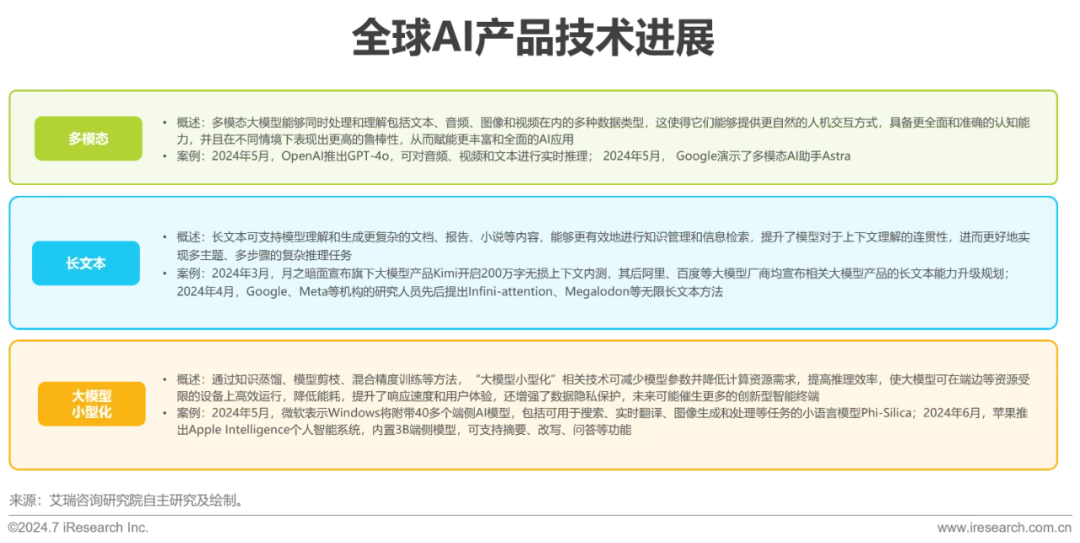

近年来,Transformer等预训练大模型在语言理解及生成等领域表现出色,大模型背后的Scaling Law(规模定律)进一步揭示了模型性能与数据量、算力之间的关系,强化了数据在提升AI表现中的关键作用。

吴甘沙校友本硕毕业于复旦大学计算机科学技术学院,于2000年加入英特尔中国研究院,2010年成为英特尔中国研究院首席工程师,2014年晋升成为英特尔中国研究院院长。2016年,他创立驭势科技,踏上创业之路已有8年时光。

该论文作者均来自于华南理工大学马千里教授团队,所在实验室为机器学习与数据挖掘实验室。论文的三位共同第一作者为博士生郑俊豪、硕士生邱圣洁、硕士生施成明,主要研究方向包括大模型和终生学习等,通讯作者为马千里教授(IEEE/ACM TASLP 副主编)。