程序员为何容易爱上AI?MIT学者诊断:「智性恋」浓度过高!

程序员为何容易爱上AI?MIT学者诊断:「智性恋」浓度过高!OpenAI警告说,跟人工智能语音聊天可能会产生「情感依赖」。这种情感依赖是怎么产生的呢?MIT的一项研究指出,这可能是「求仁得仁」的结果,无怪乎连软件工程师也会对AI着迷。

OpenAI警告说,跟人工智能语音聊天可能会产生「情感依赖」。这种情感依赖是怎么产生的呢?MIT的一项研究指出,这可能是「求仁得仁」的结果,无怪乎连软件工程师也会对AI着迷。

Jamba是第一个基于 Mamba 架构的生产级模型。Mamba 是由卡内基梅隆大学和普林斯顿大学的研究人员提出的新架构,被视为 Transformer 架构的有力挑战者。

Emory大学的研究团队提出了一种创新的方法,将大语言模型(LLM)在文本图(Text-Attributed Graph, 缩写为TAG)学习中的强大能力蒸馏到本地模型中,以应对文本图学习中的数据稀缺、隐私保护和成本问题。通过训练一个解释器模型来理解LLM的推理过程,并对学生模型进行对齐优化,在多个数据集上实现了显著的性能提升,平均提高了6.2%。

随着大模型研究的深入,如何将其推广到更多的模态上已经成为了学术界和产业界的热点。最近发布的闭源大模型如 GPT-4o、Claude 3.5 等都已经具备了超强的图像理解能力,LLaVA-NeXT、MiniCPM、InternVL 等开源领域模型也展现出了越来越接近闭源的性能。

近日,天桥脑科学研究院(Tianqiao & Chrissy Chen Institute,简称研究院)与《科学》杂志联合宣布,推出一项 AI 驱动科学大奖,表彰全球范围内用人工智能技术推动各个领域科学研究并取得突破性进展的青年科学家。

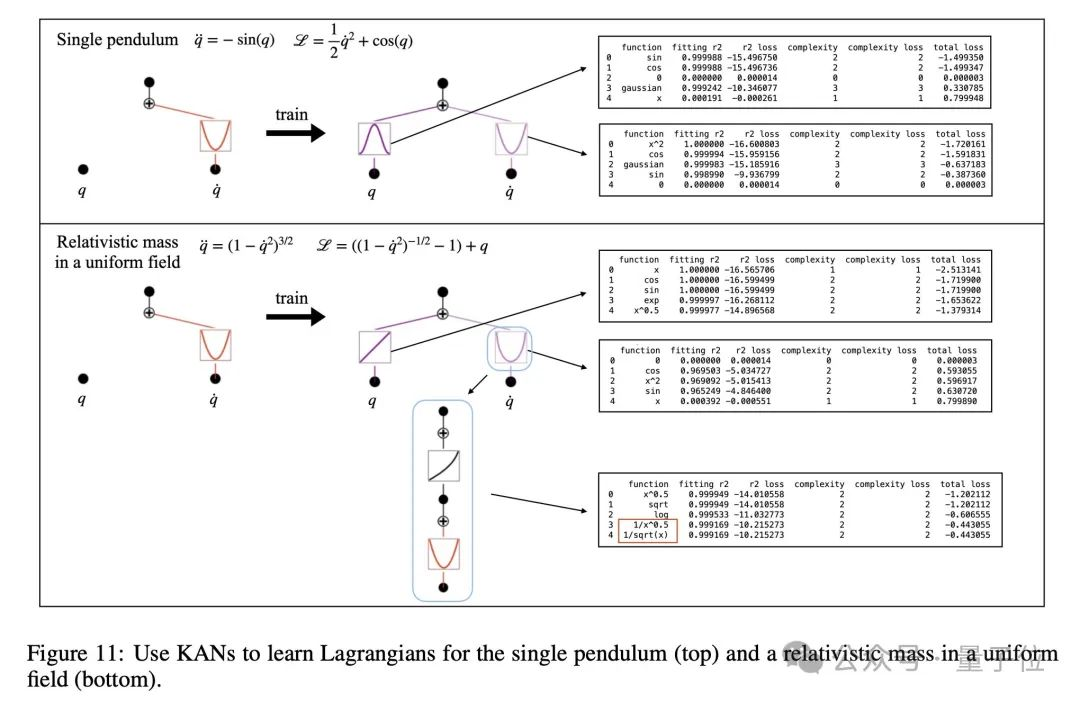

爆火神经网络架构KAN,上新了!

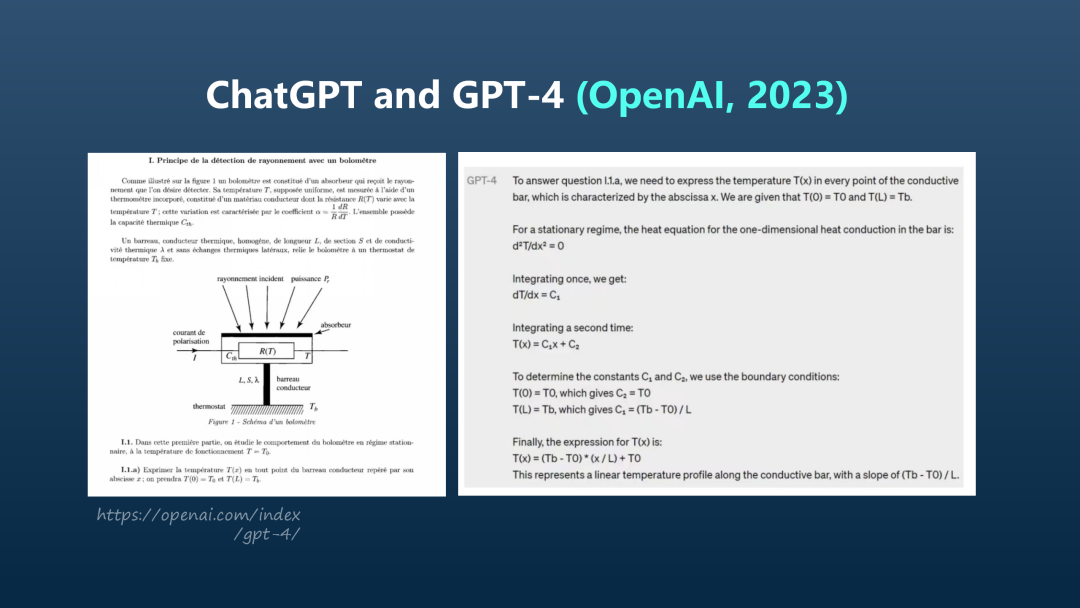

人工智能是一个快速发展的领域,每个人都在以自己的方式体验它,每个人都有不同的感受和对未来的预见。

上周,我和一个做电商朋友聊天,他正研究干果品类市场趋势。聊着聊着,他说,现在AI 搜索不太好用。我问为什么,他说:

虽然大语言模型(LLM)的能力不断突破,但在长文生成方面却一直存在瓶颈。近日,清华大学和智谱AI联合发布的最新研究成果,为解决这一难题提供了创新方案。这项名为"LongWriter"的技术,成功将AI模型的长文生成能力从约2000字提升至10000字以上,同时保持了高质量输出。这一成果通过创新的数据构建方法、模型训练策略和评估基准,为AI长文创作开辟了新天地。

AI掌握自我设计的权力,将会怎样?最近,来自UBC等机构研究人员提出了「智能体自动化设计」系统,让元智能体使用搜索算法,自动构建强大的同类。